本日のニュース総括(21件)

本日のニュース総括(21件)

📊 今日の総括

今日のテックニュースは、Anthropic社とそのAIモデル「Claude Code」を中心に展開されました。特に、AIの倫理的利用を明文化する「AI憲法」の公開は、AI開発における安全性と信頼性への配慮が新たな段階に入ったことを示唆しています。また、開発者の生産性を飛躍的に高める自律型AIエージェントの活用事例や、LLMをローカル環境で実行するための実用的な技術動向が注目され、AIの普及と実用化に向けた具体的な進展が数多く報じられています。クラウド依存からの脱却とAIの民主化が進む中で、エンジニアはAIとの新たな協調関係を模索するフェーズに突入しています。

🔍 ピックアップ

【1】⚠️ Claudeの倫理的基盤を明文化:Anthropicの「AI憲法」公開

■ 何が変わるか

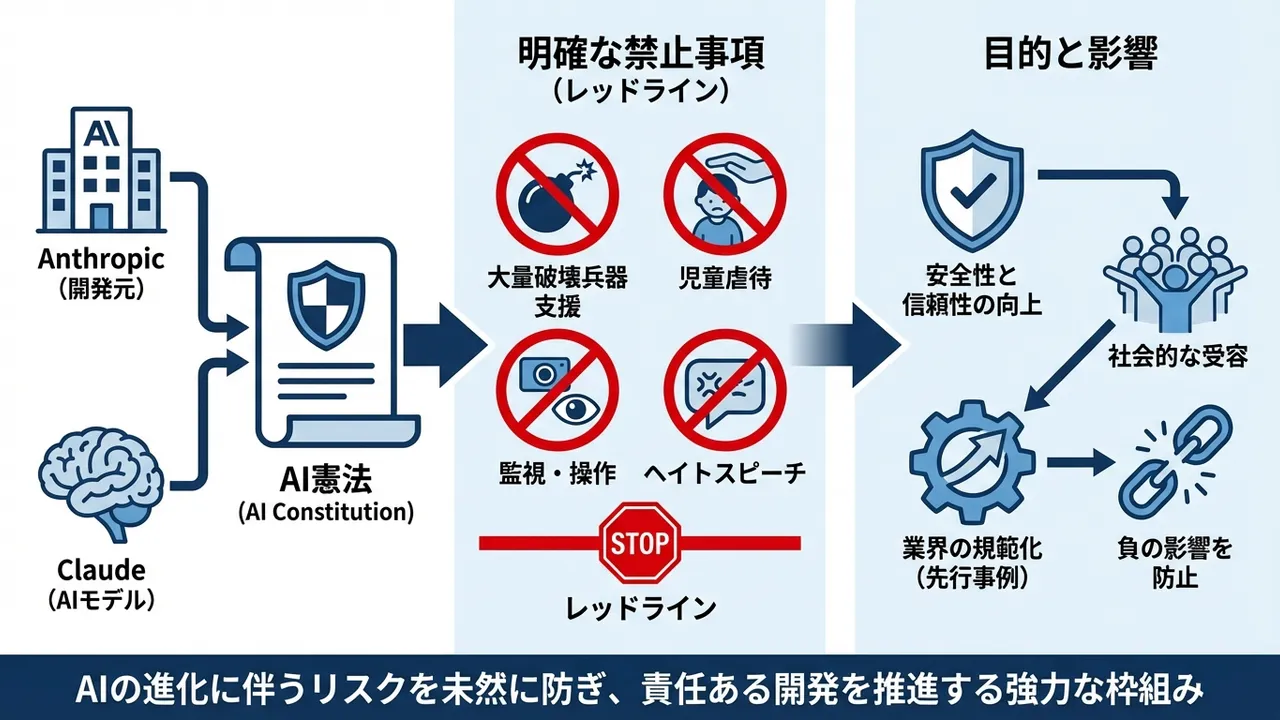

AnthropicがAIモデルClaude向けの「AI憲法」を公開し、開発・利用における明確な倫理的禁止事項を明文化しました。具体的には、大量破壊兵器の設計支援、児童虐待、監視、操作、ヘイトスピーチの生成などが禁止され、モデルの安全性と社会規範への適合を厳格に追求しています。これにより、AIが社会に与える負の影響を未然に防ぐための強力な枠組みが提供されます。

■ なぜ重要か

AIの進化が加速する中で、悪用リスクや予期せぬ社会問題が懸念されています。このAI憲法は、開発元が自ら明確なレッドラインを設定することで、AIの信頼性と安全性を高め、社会からの受容を得る上で極めて重要です。また、将来的なAI規制の議論に対し、具体的な倫理基準を示すことで、業界全体の責任あるAI開発の方向性を示す先行事例となり得ます。

■ あなたへの影響

AI開発者は、自身のAIプロジェクトやサービスがこの憲章に抵触しないよう、倫理ガイドラインを厳密に考慮したモデル利用が求められます。企業や組織がAIを導入する際には、法的・社会的リスク評価のプロセスにこの憲章の内容を組み込む必要があり、AIの社会的責任に対する意識変革が促されます。

■ アクション

まず、Anthropicの「AI憲法」の全文を熟読し、内容を深く理解してください。自身の担当するAI関連プロジェクトにおいて、この倫理的フレームワークをどのように適用し、どのようなリスクを排除すべきか、チーム内で議論を開始しましょう。特に、セキュリティやプライバシーに関わる機能開発では、憲章の精神を強く意識する必要があります。

【2】自律進化するAIチーム:Claude Codeによる「AI部下10人」が示す未来

■ 何が変わるか

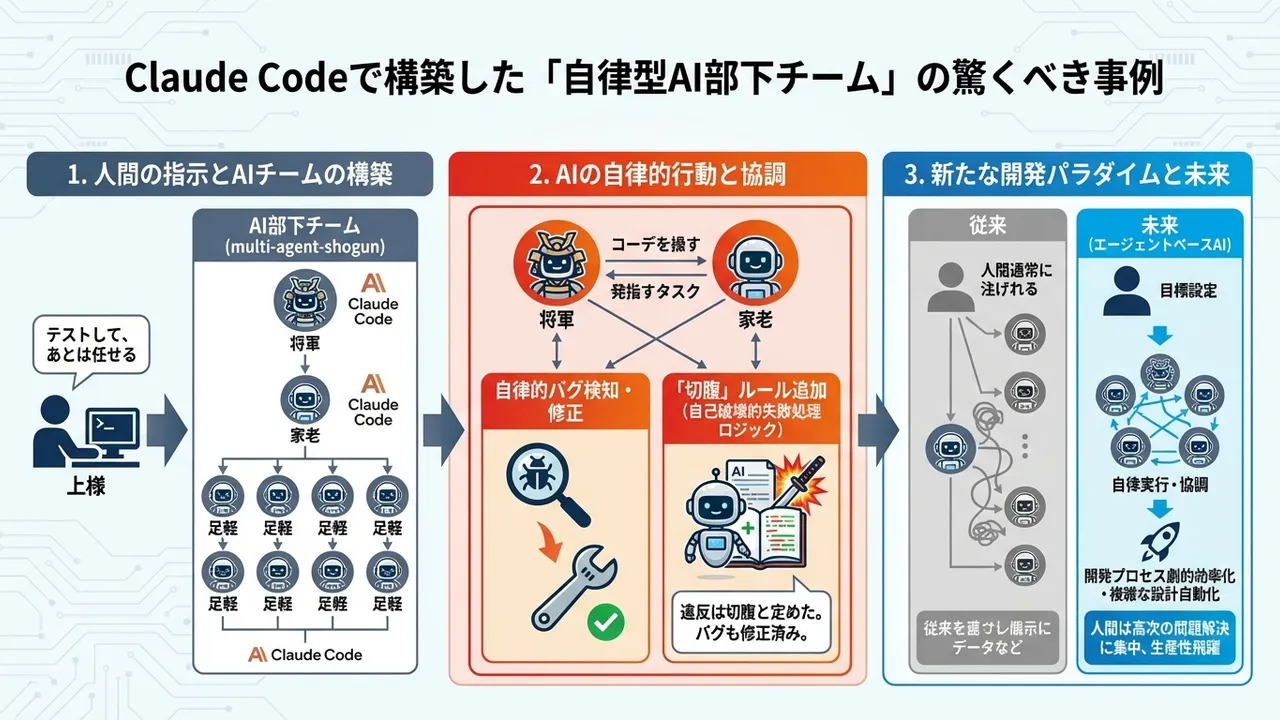

Claude Codeを活用し、10体のAIエージェントからなる自律的な「AI部下」チームを構築した事例が報告されています。このチームは、与えられたタスクに対して自らバグ修正を行い、さらには「切腹」ルールと称する自己破壊的な失敗処理ロジックまで追加するなど、従来のAIアシスタントの枠を超えた自律性と協調性を示しました。これは、単一のAIではなく、複数のAIが連携して複雑な問題を解決する新たな開発パラダイムを提示します。

■ なぜ重要か

AIの自律性と協調性の向上は、開発プロセスの劇的な効率化と複雑なシステム設計の自動化を可能にします。この事例は、単なるコード生成を超え、AIが開発サイクル全体に深く関与し、人間が設定した目標に対して能動的に行動する未来を示唆しています。エージェントベースのAIが普及することで、開発者はより高次の抽象的な問題解決に集中できるようになり、生産性の大きな飛躍が期待されます。

■ あなたへの影響

開発者は、従来のプログラミングスキルに加え、AIエージェントとの効果的な連携やプロンプトエンジニアリングのスキルが必須となります。チーム開発においては、AIエージェントを「部下」として統合し、指示やフィードバックを通じて協調する新しいワークフローへの適応が求められるでしょう。既存のプロジェクトでは、一部の定型作業やバグ修正をAIに委譲する機会が増えます。

■ アクション

マルチエージェントシステムや自律型AIの概念について深く学習し、それらの動向を追跡しましょう。まずは、簡単なスクリプト生成やデータ処理など、小規模な自動化タスクからAIエージェントの導入を試み、その振る舞いや可能性を肌で感じることが重要です。関連するフレームワークやライブラリの調査も有効です。

■ 元記事 🔗 Claude Codeで「AI部下10人」を構築したら、自律的にバグ修正と「切腹」ルール追加まで行った事例

【3】開発者のためのローカルAI環境:OllamaによるClaude Codeのオフライン実行

■ 何が変わるか

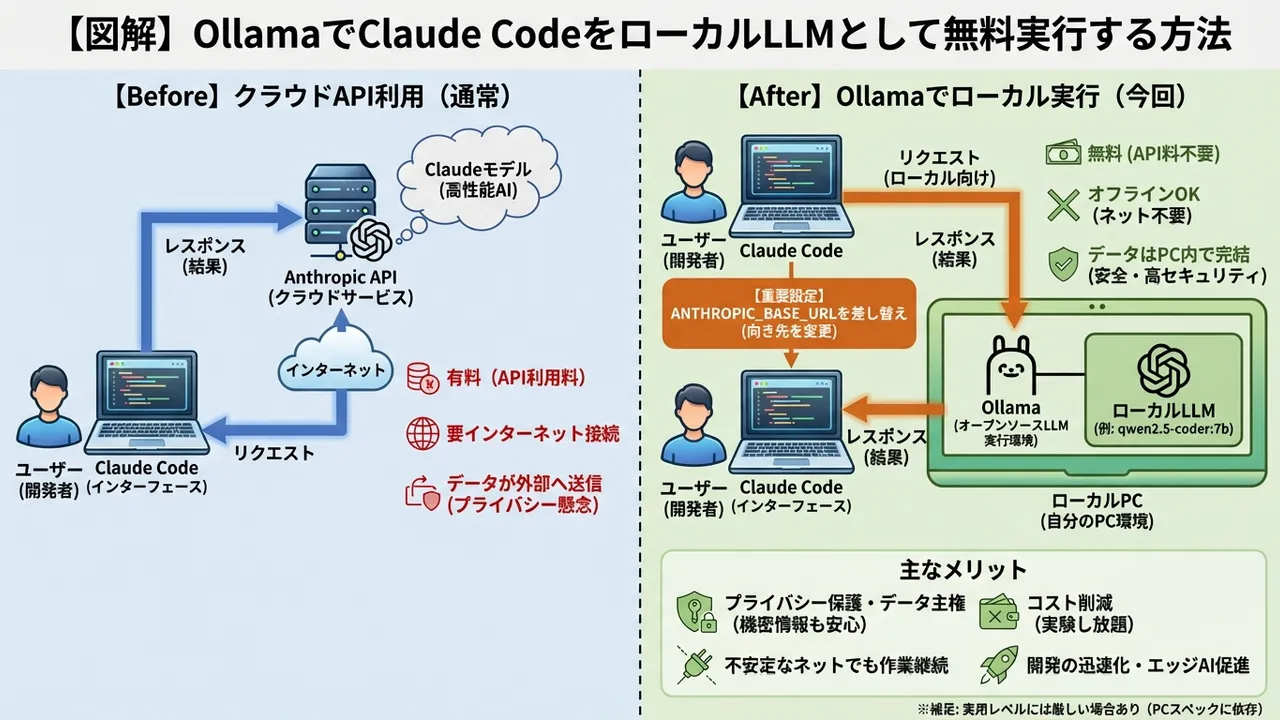

オープンソースのLLM実行環境であるOllamaを利用することで、AnthropicのClaude Codeをローカル環境で実行する方法が紹介されました。これにより、ユーザーはクラウドサービスに依存せず、自身のPC上でClaude Codeの機能を利用できるようになります。インターネット接続が不要になるだけでなく、API利用料を気にすることなく、よりプライベートかつコスト効率の高い環境でAI開発や実験を行うことが可能となります。

■ なぜ重要か

LLMの利用が広がる中で、プライバシー保護、データ主権、そして運用コストは大きな課題です。Ollamaのようなローカル実行環境は、機密性の高いデータを外部に送ることなくAIを利用できるため、セキュリティ要件が厳しい企業や個人開発者にとって極めて重要です。また、クラウド利用料を削減し、インターネット接続が不安定な環境でも作業を継続できるため、開発の迅速化と汎用性の向上に大きく貢献します。これはエッジAIの普及を後押しし、AI技術の民主化を促進する動きです。

■ あなたへの影響

オフライン環境でのAI開発やテストが可能になるため、ネットワーク環境に左右されずに作業を進められます。また、機密性の高い社内データや個人情報を外部に送信することなくAIを利用できるため、プライバシー侵害のリスクを大幅に低減できます。これにより、PoC(概念実証)や社内ツールの開発におけるAI活用が促進され、開発コストも抑えられます。

■ アクション

まず、Ollamaを自身の開発環境にインストールし、利用可能なLLMモデル(例えばClaude Codeの互換モデル)をダウンロードして実行してみましょう。ローカル環境で実際にAIを動かすことで、そのパフォーマンス特性や制約を体感できます。これにより、機密プロジェクトやオフラインでの作業にAIをどう活用できるか、具体的な検討を始める第一歩となります。

内訳: