本日のニュース総括(14件)

本日のニュース総括(14件)

📊 今日の総括

今日のテックニュースは、Anthropic社に焦点を当て、その動向がAI業界全体、ひいてはエンジニアのキャリアと開発プラクティスに与える影響を色濃く示しています。特に注目すべきは、AIの安全性と倫理、AI時代のエンジニアの役割変革、そして大規模言語モデル(LLM)の効果的な活用術という三つの大きなテーマです。倫理的なAI開発の最前線でAnthropicが示す「Claude憲法」は、AIガバナンスの新たな規範を提示し、セキュリティと信頼性への高い意識が窺えます。同時に、社内調査からはAIがエンジニアの技能・評価に与える構造的な変化が浮き彫りになり、開発現場ではClaude Codeの活用における具体的な課題解決策が提示されました。これらの記事群は、AI技術の進化が単なる機能拡張に留まらず、社会基盤、職業構造、開発手法といった多岐にわたる側面で変革を迫っていることを示唆しています。

🔍 ピックアップ

【1】⚠️ Anthropic、「Claude憲法」でAIアライメントフレームワークを大幅強化

■ 何が変わるか

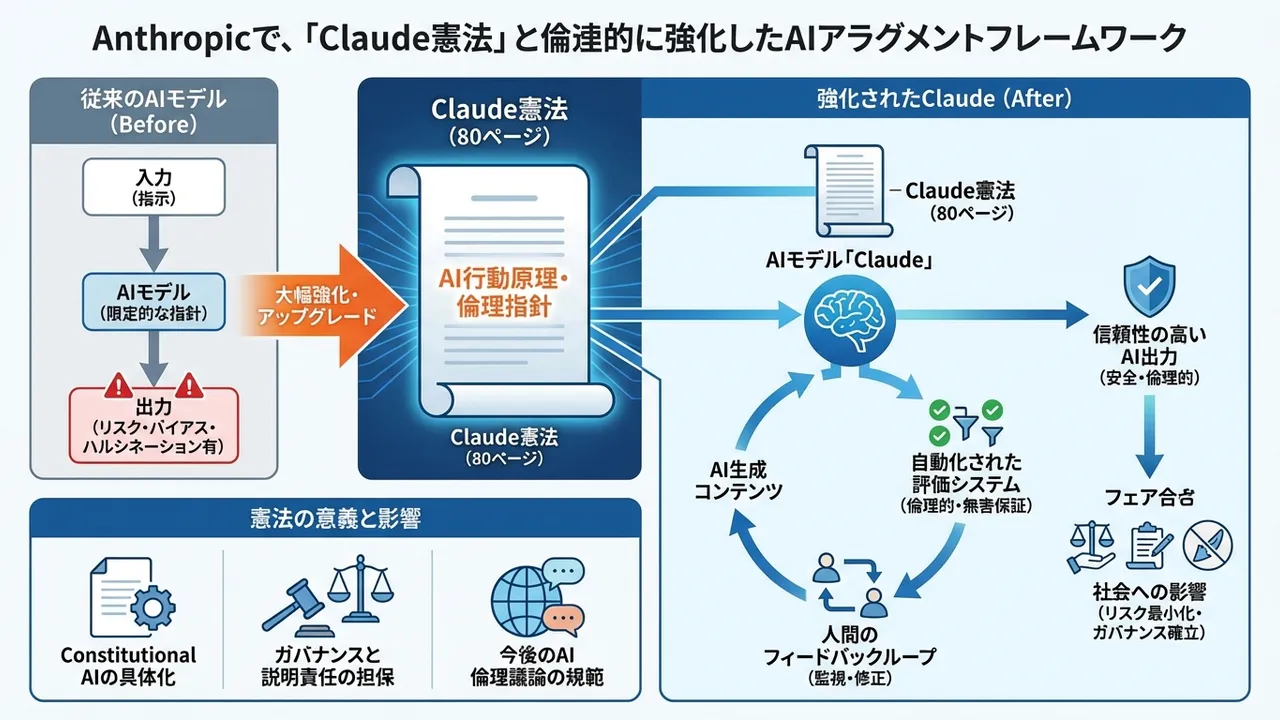

Anthropicは、自社のAIモデル「Claude」の安全性を確保するための倫理指針「Claude憲法」を大幅に強化しました。これはAIの行動原理を定義し、内部での監視・評価プロセスを通じてリスクを最小限に抑えることを目的としています。具体的には、AIが生成するコンテンツが倫理的で有害でないことを保証するための自動化された評価システムや、人間のフィードバックループが組み込まれています。これにより、AIが社会に与える負の影響を未然に防ぐための強力な枠組みが確立され、信頼性の高いAIモデルの提供を目指します。

■ なぜ重要か

AIが社会に深く浸透する中で、その安全性と倫理性は最も喫緊の課題の一つです。大規模AIモデルの誤用や意図せぬバイアス、ハルシネーションは、社会的な混乱や不公平を招く可能性があります。Anthropicが提唱する「Constitutional AI」の概念を具体化したこの憲法は、AIのガバナンスと説明責任を担保する上で極めて重要な一歩です。他のAI開発企業や規制当局にとっても、AIの安全な開発と運用に向けた具体的な規範となる可能性を秘めており、今後のAI倫理議論に大きな影響を与えるでしょう。

■ あなたへの影響

あなたがAIを開発・利用するエンジニアであれば、AIの安全基準や倫理的ガイドラインが今後の開発プロセスに一層深く組み込まれることを意味します。安全なAIの設計原則、リスク評価、モデルの監査といったスキルがより重視されるようになるでしょう。また、AIが提供する情報の信頼性や公平性に対する社会的な期待が高まるため、AIシステムの設計段階から倫理的な側面を考慮する必要性が増します。これは、より責任感のあるAI開発が求められる時代の到来を告げています。

■ アクション

まず、「Claude憲法」の公開された詳細(利用可能であれば)に目を通し、AI倫理と安全性の最新動向を把握してください。次に、自身のAI開発プロジェクトにおいて、どのようなリスク評価や倫理的レビューのプロセスを導入できるか具体的に検討してみましょう。可能であれば、AI倫理に関する専門知識を持つメンバーとの議論を深め、より安全で信頼性の高いAIシステム構築に向けた知見を共有することが推奨されます。

■ 元記事

【2】Anthropic社内調査が暴露:AI時代のエンジニアリング変革と技能・雇用・評価の最新動向

■ 何が変わるか

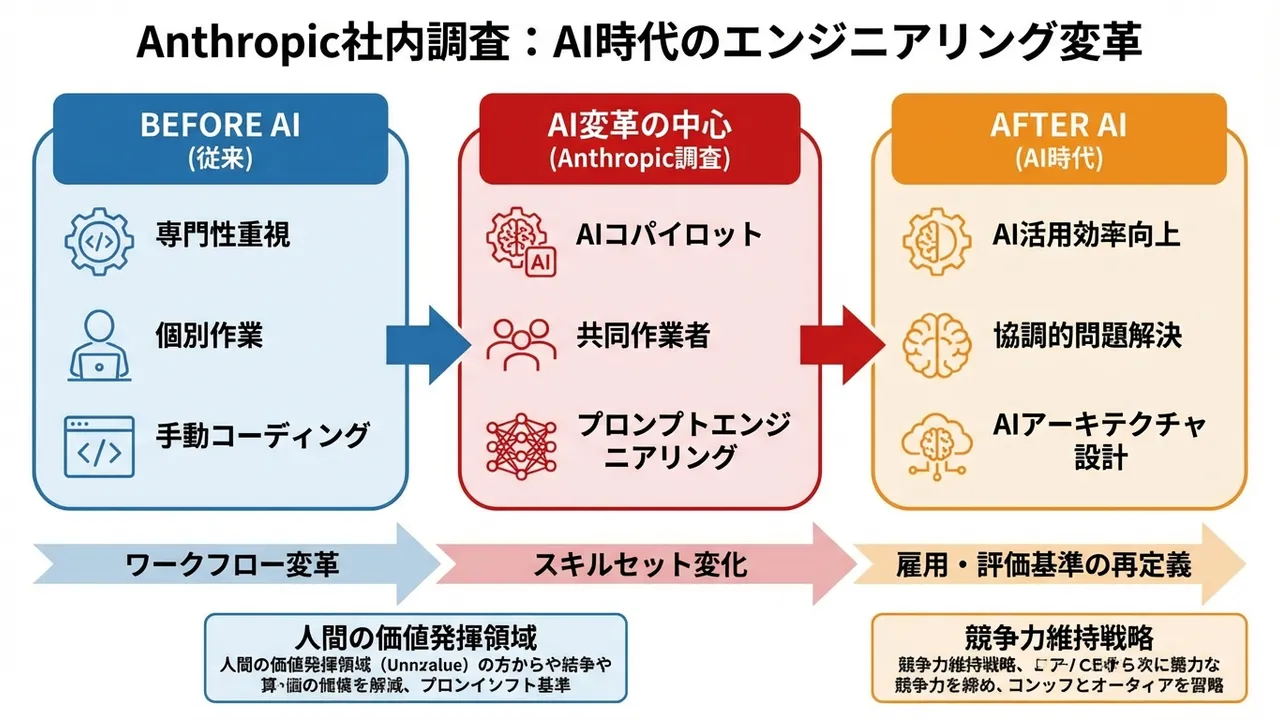

Anthropic社内で実施された調査によると、AIの進化がエンジニアリングのワークフロー、求められるスキルセット、さらには雇用形態や評価基準にまで深刻な影響を与えていることが明らかになりました。特に、AIツールを活用した開発効率の向上や、AIと協調する形での問題解決能力が重視されつつあります。従来の専門性だけでなく、AIを「コパイロット」として使いこなし、プロンプトエンジニアリングやAIシステム全体のアーキテクチャ設計能力が新たな評価軸として浮上しており、エンジニアの役割そのものが再定義されつつあります。

■ なぜ重要か

AIが単なるツールではなく、共同作業者として開発現場に深く入り込むことで、エンジニアの役割そのものが再定義されつつあります。この変化を正確に理解することは、将来のキャリアプランニング、技術スキルの習得、そして企業がエンジニアを育成・評価する上で極めて重要となるからです。AIが代替する業務と、人間がより価値を発揮できる領域を見極めることで、AI時代の競争力を維持・向上させるための戦略を立てることが可能になります。この調査結果は、我々エンジニアの未来を考える上で不可欠な視点を提供しています。

■ あなたへの影響

AIツールを効果的に活用する能力が、あなたの市場価値を大きく左右する時代が到来しています。単にコードを書くだけでなく、AIに的確な指示を出し、その結果を評価・修正する「プロンプトエンジニアリング」や、AIが生成したコードの品質を保証する能力が求められるでしょう。また、AIに置き換わる可能性のある定型業務から、より創造的で複雑な問題解決へとスキルをシフトさせる必要性を認識し、継続的な学習と自己変革が不可欠となります。これは、エンジニアとしてのスキルセットを常に更新し続けることの重要性を強調しています。

■ アクション

まず、自身が日常的に使用している開発ツールにAI機能を積極的に取り入れ、その効果を肌で感じてみてください。ChatGPTやClaude CodeのようなAIアシスタントを使ったプログラミング支援やドキュメント生成を実践し、プロンプトエンジニアリングのスキルを磨くことが推奨されます。さらに、AIを活用した新しい開発パラダイムに関する情報収集を怠らず、自身のキャリアパスと照らし合わせて必要なスキルセットを洗い出し、計画的に学習を進めることが、これからのエンジニアにとって極めて重要です。

■ 元記事

【3】Claude Codeのコンテキスト無視問題を解決:公式ベストプラクティスによる改善ガイド

■ 何が変わるか

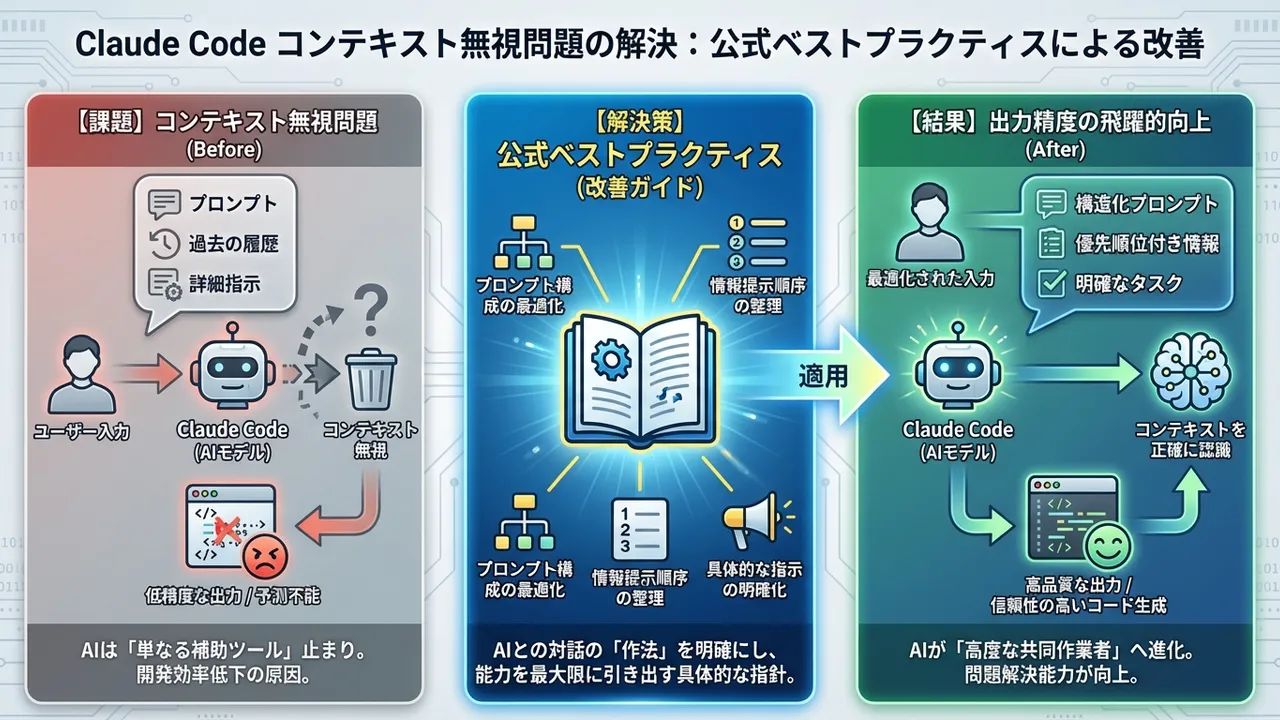

AnthropicのAIモデル「Claude Code」を使用する際によく発生する「コンテキスト無視問題」、つまりモデルが与えられたプロンプトの一部や過去の会話履歴を適切に考慮しないという課題に対し、公式のベストプラクティスが提供されました。このガイドでは、プロンプトの構成、情報の提示順序、具体的な指示の与え方など、コンテキストを正確に認識させるための具体的なテクニックが詳細に解説されています。これにより、Claude Codeの出力精度が飛躍的に向上し、より信頼性の高いコード生成や問題解決が可能になります。

■ なぜ重要か

大規模言語モデルは強力なツールである一方で、その性能はプロンプトの質に大きく依存します。コンテキスト無視問題は、AIの出力を予測不能にし、開発効率を低下させる主要な原因の一つでした。このベストプラクティスは、AIとの対話の「作法」を明確にし、エンジニアがAIの能力を最大限に引き出すための具体的な指針を提供します。これにより、AIを単なる補助ツールとしてではなく、より高度な共同作業者として活用するための道筋が示されたことになり、AIをより効果的にプロジェクトに組み込む上で不可欠な情報です。

■ あなたへの影響

Claude Codeや類似のLLMを開発や業務に利用しているエンジニアにとって、このガイドはまさに必読です。プロンプト作成の試行錯誤にかかる時間を大幅に削減し、AIからの出力品質を向上させることができます。特に、複雑な要件や多段階の処理をAIに依頼する際に、このベストプラクティスを適用することで、期待通りの結果を得やすくなるでしょう。結果として、開発サイクルが短縮され、より効率的なソフトウェア開発が可能になり、プロジェクトの成功に大きく貢献するはずです。

■ アクション

まず、提供された公式ベストプラクティスガイド(日本語要約も活用)を熟読し、コンテキスト無視問題の根本原因と推奨される解決策を深く理解してください。次に、自身のClaude Codeを用いたプロジェクトやタスクにおいて、このガイドラインを実際に適用し、プロンプトの構成や情報の与え方を改善しましょう。特に、複雑なプロンプトを作成する際は、分割や構造化を意識し、AIの応答をモニタリングしながら最適なプロンプトパターンを見つけ出す試みを続けることが、AI活用の鍵となります。

■ 元記事

内訳: