本日のニュース総括(26件)

本日のニュース総括(26件)

📊 今日の総括

今日のテックニュースは、AI技術の進化とその周辺で巻き起こる倫理的、セキュリティ的課題に焦点が当たっています。特に、生成AIモデルの機能拡張と、それを活用するための開発者向けツールが多数発表されており、AI開発の最前線が大きく動いています。一方で、AI学習データの取得方法や、AIシステム自体のセキュリティ脆弱性に関する議論が活発化しており、技術者にはより深い洞察と倫理的配慮が求められるフェーズに入っています。プロダクション環境でのAI運用を支えるオブザーバビリティツールも登場し、実用化に向けたインフラ整備も進んでいます。

🔍 ピックアップ

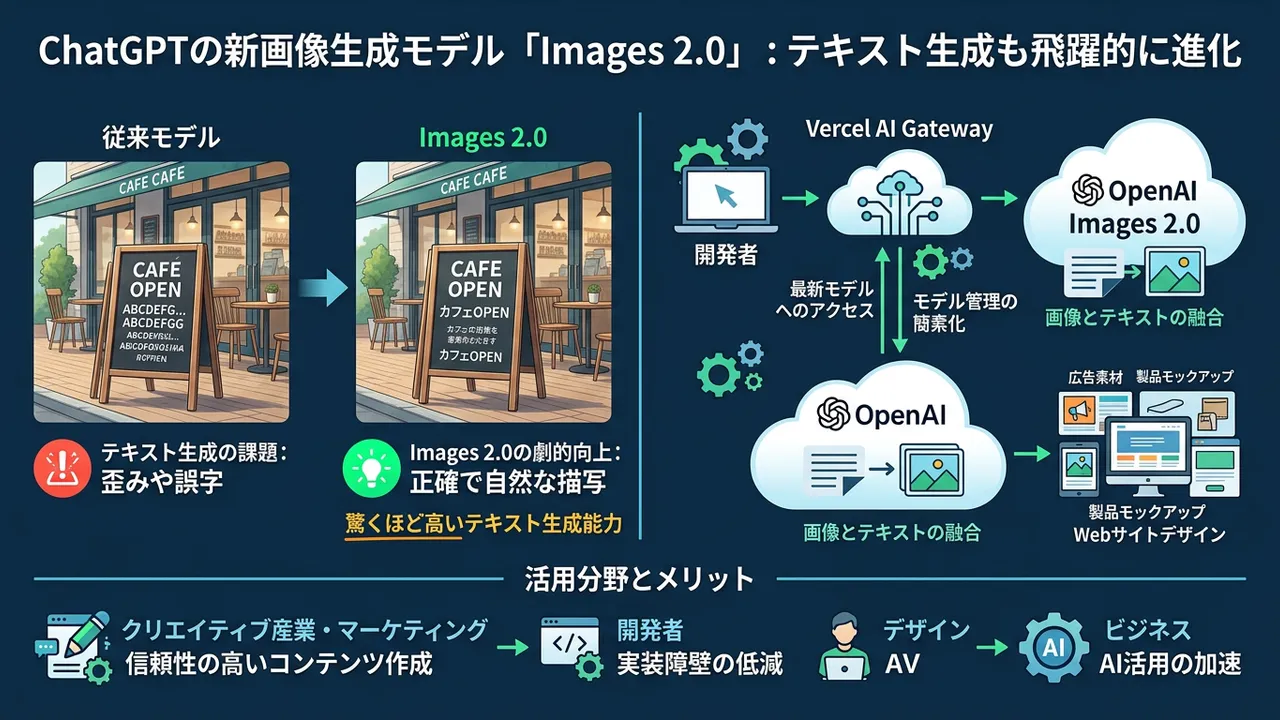

【1】ChatGPTの新画像生成モデル「Images 2.0」がテキスト生成能力を飛躍的に向上させ、Vercel AI Gatewayで利用可能に

■ 何が変わるか

OpenAIは、新しい画像生成モデル「Images 2.0」を発表しました。このモデルの最大の特長は、画像生成能力に加え、テキスト生成能力が大幅に強化された点にあります。特に、複雑な指示やロゴ、看板といった画像内のテキスト要素を、より正確かつ自然に表現できるようになりました。また、この高機能な新モデルがVercel AI Gatewayを通じて利用可能になり、開発者はVercelが提供するAPIエンドポイントを介して、容易にこの強力な画像生成機能を自身のアプリケーションに組み込めるようになりました。これにより、モデルのバージョン管理やレートリミット調整などのバックエンドの複雑な処理を意識することなく、最新のAIモデルを活用できます。

■ なぜ重要か

これまでの画像生成AIは視覚的なクオリティが先行していましたが、Images 2.0はテキスト要素の精度向上により、実用性が大きく高まります。例えば、広告キャンペーンのビジュアル素材作成、製品のモックアップデザイン、あるいはウェブサイトのファビコン生成など、テキストと画像を融合させたコンテンツ作成において、より信頼性の高い出力を期待できるようになります。Vercel AI Gatewayによる提供は、開発者が最先端のAIモデルに迅速かつ効率的にアクセスできるエコシステムが成熟していることを示し、AI機能実装の障壁を大幅に低減します。これは、特にクリエイティブ産業やマーケティング分野でのAI活用を加速させるでしょう。

■ あなたへの影響

フロントエンドおよびバックエンドの開発者にとって、Images 2.0の高精度な画像・テキスト生成能力は、ユーザーインターフェースやコンテンツ制作の強力なツールとなります。Vercel AI Gatewayの活用は、APIキーの管理やレートリミット調整、プロンプトの再試行などの煩雑な処理をGateway側で吸収してくれるため、開発効率が向上します。既存の画像生成パイプラインを持つプロジェクトでは、Images 2.0への切り替えで品質向上が期待できる一方、新しいプロンプトエンジニアリングのスキルセットや、生成されたテキストの最終確認プロセスがより重要になります。サービスにおける画像生成の幅が広がるため、UX設計においても新たな選択肢が生まれるでしょう。

■ アクション

まずVercel AI Gatewayの公式ドキュメントを確認し、GPT Image 2 APIの利用方法と提供されている機能の詳細を理解してください。次に、Vercel AI Gatewayを通じて簡単なWebアプリケーションやスクリプトを構築し、このAPIを呼び出して画像とテキストが混在するコンテンツを生成するテストを行ってみましょう。既存のプロジェクトで画像生成機能を利用している場合は、Images 2.0に切り替えた場合の品質改善効果と、プロンプト調整にかかるコストや工数を見積もり、移行計画を検討することをお勧めします。

■ 元記事

🔗 ChatGPTの新画像生成モデル「Images 2.0」、テキスト生成能力も驚くほど高い 🔗 Vercel AI GatewayでGPT Image 2が利用可能に:高精度な画像生成と多様なスタイルに対応

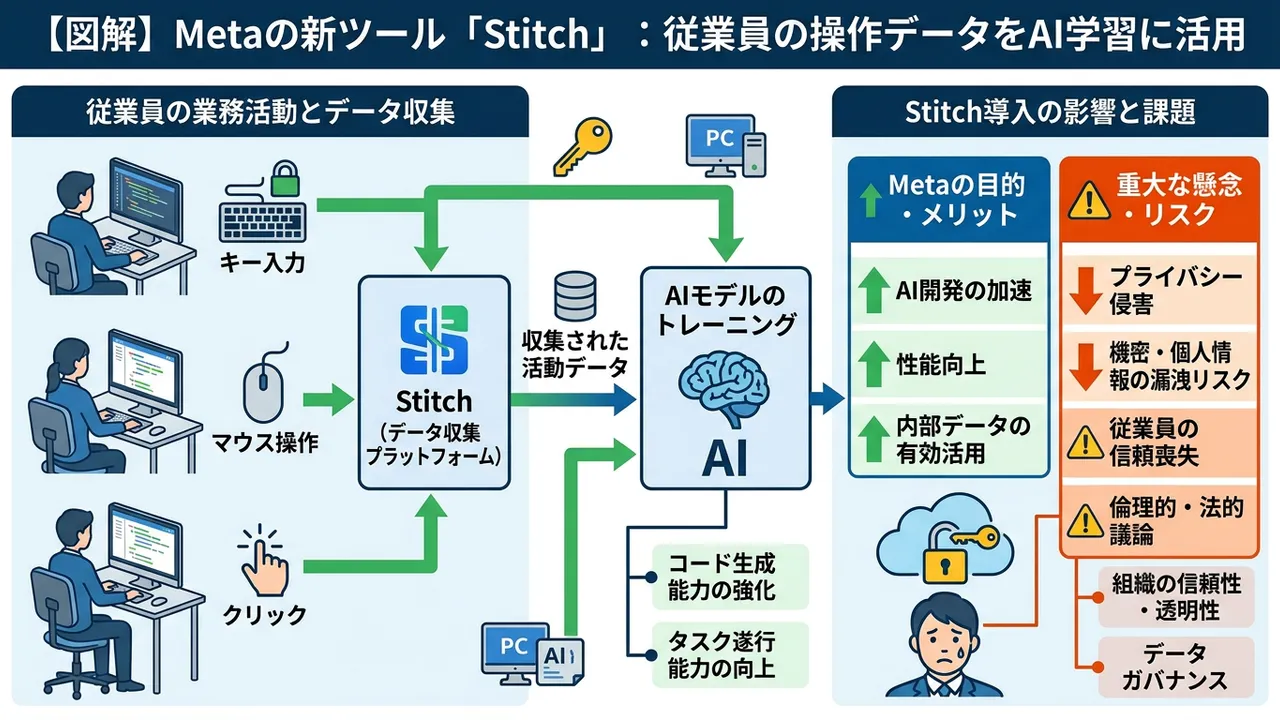

【2】Metaが従業員のキーストロークをAIモデル学習に活用する新ツールを導入、データプライバシーと倫理的AI開発に警鐘

■ 何が変わるか

Metaが、従業員のキーストロークやマウス操作などの活動データを収集し、これを自社のAIモデルのトレーニングに活用する新ツール「Stitch」を導入したと報じられました。表向きは従業員の生産性向上を目的としていますが、実態はAIモデルのコード生成能力やタスク遂行能力を強化するためのデータ収集と見られています。このデータはMetaが所有するハードウェア上で収集され、従業員の日常業務が直接的にAI学習のデータセットとなる仕組みです。

■ なぜ重要か

この動きは、企業がAI開発のために従業員のプライベートな作業データにどこまで踏み込むべきかという、倫理的かつ法的な議論を強く呼び起こします。特に、機密情報や個人情報が含まれる可能性のあるキーストロークデータがAIモデルに学習されることで、プライバシー侵害、情報漏洩、そして従業員の信頼喪失という重大なリスクが高まります。他社に先駆けて内部データをAI学習に活用しようとするMetaの姿勢は、AI開発における競争の激化と、そのために企業が採りうる手段の限界を問いかけています。エンジニアリング組織における信頼性、透明性、そしてデータガバナンスの重要性が再認識されるでしょう。

■ あなたへの影響

AIを開発・導入するエンジニアとして、企業がAI開発のためにどのようなデータを収集し、どのように利用しているか、それが倫理的・法的に許容される範囲内であるかについて、高い意識を持つ必要があります。自身が開発するAIシステムにおいても、データ収集の透明性、適切な同意の取得、そして個人情報保護への配慮が不可欠となります。また、もし自身の会社が同様のツール導入を検討した場合、プライバシーポリシーやデータ利用規約、従業員への影響について確認し、懸念がある場合は積極的に議論に参加することが求められます。AI倫理はもはや専門家だけの問題ではなく、全エンジニアが関わるべきテーマです。

■ アクション

自身の企業におけるAI倫理ガイドラインやデータプライバシーポリシーを改めて確認し、AIモデルのトレーニングデータ収集に関する規定に特に注目してください。もし規定が不明確な場合は、関係部署に問い合わせを行いましょう。チーム内でAI倫理やデータガバナンスに関する議論を促し、AI開発におけるベストプラクティスを共有する機会を設けることも重要です。また、Metaの動向については、今後の裁判動向や各国・地域の規制当局の反応を注視し、自身の開発や組織運営に活かせる教訓を学びましょう。データ収集の透明性確保は喫緊の課題です。

■ 元記事

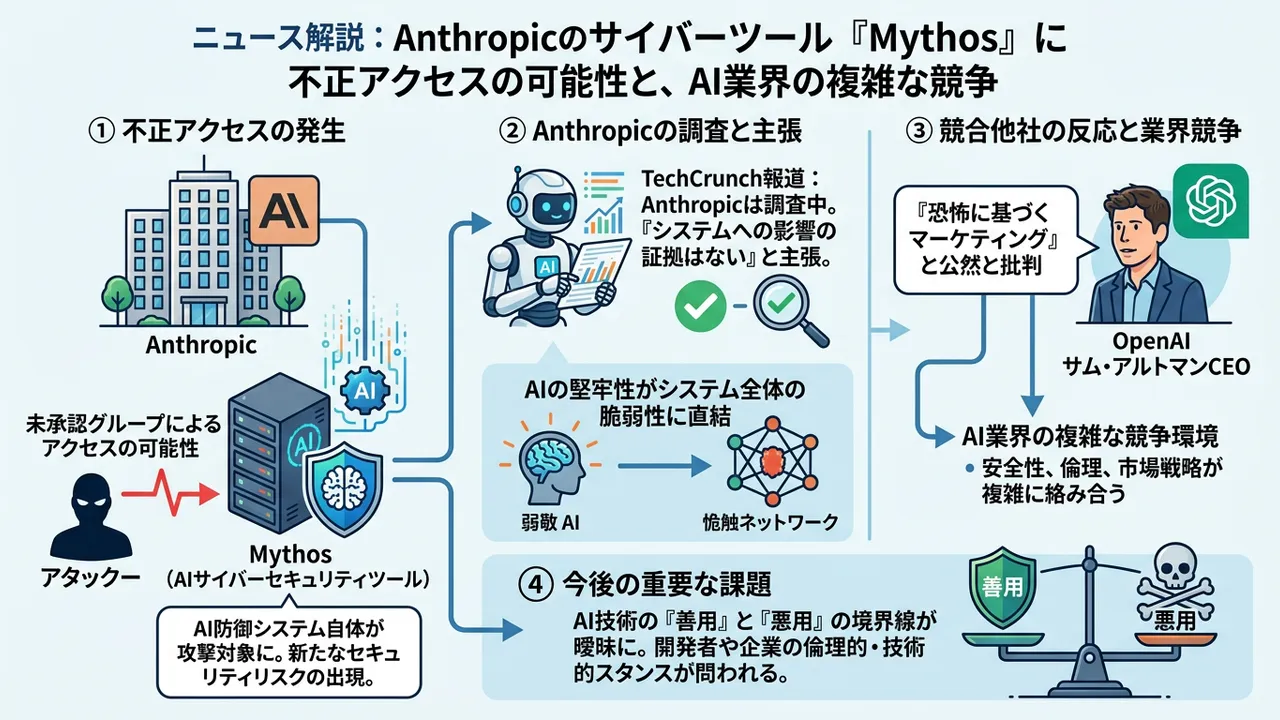

【3】Anthropicのサイバーツール「Mythos」に不正アクセス疑惑、OpenAIが批判しAIセキュリティと競争の複雑化が顕在化

■ 何が変わるか

Anthropicが開発中のAIを活用したサイバーセキュリティツール「Mythos」に対して、未承認のグループがアクセスした可能性があるとの報道がありました。これは、AIを活用した防御システムそのものが攻撃対象となりうる、新たな種類のセキュリティリスクの出現を示唆しています。さらに、この状況に対し、競合であるOpenAIのCEOサム・アルトマン氏が「恐怖に基づくマーケティング」と公然と批判したことで、AIの安全性と倫理、そして市場戦略が複雑に絡み合うAI業界の競争環境が鮮明になりました。

■ なぜ重要か

この事件は、最先端のAIツール、特にセキュリティ関連のものが、いかに高いリスクに晒されるかという現実を突きつけます。AIがセキュリティの要となるにつれて、そのAI自身の堅牢性や信頼性がシステム全体の脆弱性に直結するようになります。また、競合他社からの公然たる批判は、AI倫理、安全性、そして市場戦略が複雑に絡み合うAI業界の競争環境を如実に示しています。AI技術の「善用」と「悪用」の境界線が曖昧になる中で、開発者や企業がどのような倫理的・技術的スタンスを取るべきかという、極めて重要な問いを投げかけています。これは技術だけでなく、社会的な側面からも非常に重要な問題です。

■ あなたへの影響

AIを開発・導入するエンジニアは、AI自体のセキュリティ脆弱性とその悪用リスクについて、これまで以上に深く考慮する必要があるでしょう。特に、生成AIが出力するコードやコンテンツ、意思決定プロセスに対する信頼性を確保するための厳格なテストや検証の重要性が増します。また、AI業界のリーダーたちが互いに倫理観や安全性を巡って批判し合う状況は、AI技術の選定や導入において、単なる性能やコストだけでなく、その開発企業の倫理観、透明性、そしてセキュリティ体制も評価軸に入れるべきであることを示唆しています。サプライチェーン全体でのAIセキュリティ意識の向上が不可欠です。

■ アクション

自身が関わるAIプロジェクトにおいて、セキュリティ評価項目にAIモデル自体の脆弱性診断や敵対的攻撃に対する耐性テストを追加することを検討してください。また、AIモデルの出力や挙動を監査・監視するシステムの導入を強化し、予期せぬ異常を早期に検知できる能力を高めましょう。AI関連のサプライチェーン全体におけるセキュリティリスクを再評価し、信頼できるAIプロバイダー選定の基準を見直す必要があります。AnthropicやOpenAIのようなトップランナーの動向を継続的に追い、AIセキュリティの最新トレンドと課題を把握し続けることが重要です。

■ 元記事

🔗 Anthropicのサイバーツール「Mythos」に不正アクセスか、報道 🔗 OpenAIのサム・アルトマンCEO、競合Anthropicのサイバーセキュリティモデル「Mythos」を「恐怖に基づくマーケティング」と批判

【4】LLMアプリケーションの観測と評価をOpenTelemetryベースのArize Phoenixで実践

■ 何が変わるか

LLM(大規模言語モデル)を活用したアプリケーションの品質保証と運用監視は、従来のソフトウェア開発とは異なる特有の課題を抱えています。この課題に対し、Arize AIが提供する「Arize Phoenix」は、OpenTelemetry (OTel) を活用することで、LLMアプリケーションのプロンプト、応答、埋め込み、そして様々な評価指標を包括的に観測・評価するソリューションを提供します。具体的には、LLMへの入力(プロンプトやコンテキスト)、出力(応答)、内部の埋め込みベクトル、さらにはユーザーからのフィードバックなどを自動的に収集し、これらのデータを基にモデルの性能劣化や予期せぬ挙動を早期に検知できるようになります。これにより、LLMの挙動を詳細に可視化し、運用中のアプリケーションの健全性を保つことが可能になります。

■ なぜ重要か

LLMアプリケーションの運用において、プロンプトの僅かな変更や基盤モデルのアップデート、あるいは新しいデータが加わることで、ユーザー体験やビジネスロジックに予期せぬ大きな影響を与える可能性があります。しかし、LLM特有の非決定性や出力の評価の複雑さにより、従来の監視ツールだけではこれらの変化に十分に対応しきれませんでした。Arize PhoenixのようなLLM専門のオブザーバビリティツールは、LLMアプリケーションの「ブラックボックス」を可視化し、開発者が迅速に問題を特定・解決し、継続的にモデルの改善サイクルを回すことを可能にします。これは、LLMをプロダクション環境で安定稼働させ、そのビジネス価値を最大化するために不可欠な技術であり、信頼性の高いAIサービス提供の鍵となります。

■ あなたへの影響

LLMアプリケーションを開発・運用するエンジニアにとって、Arize Phoenixのようなオブザーバビリティツールは、デバッグ、パフォーマンスチューニング、そしてモデル改善のための強力な武器となります。プロンプトエンジニアリングの効果測定、RAG (Retrieval Augmented Generation) システムの精度向上、AIエージェントの挙動分析など、LLMアプリケーション特有の多岐にわたる課題解決に寄与するでしょう。導入にはOpenTelemetryに関する基本的な知識が必要となりますが、その学習コストを上回るメリットが期待できます。特に、モデルのドリフト監視や悪意あるプロンプト(プロンプトインジェクション)の検知など、セキュリティ面での活用も期待できます。

■ アクション

まずArize Phoenixの公式ドキュメントと提供されているデモを調査し、LLMアプリケーションにおける観測・評価の具体的なユースケースと、それがどのように実現されるかを理解しましょう。可能であれば、自身のLLMプロジェクトにOpenTelemetryを導入し、基本的なトレースやメトリクスデータを収集するパイプラインを構築してみるのが良いでしょう。その後、Arize Phoenixと連携させ、実際にプロンプトの変更やモデルのバージョンアップがアプリケーションのパフォーマンスや品質にどう影響するかを可視化し、適切な評価指標を定義してみることで、その効果を体感できます。これにより、LLMアプリケーションの運用における「勘」ではなく「データ」に基づいた意思決定が可能になります。

■ 元記事

内訳:

注目記事

ChatGPTの新画像生成モデル「Images 2.0」、テキスト生成能力も驚くほど高い

OpenAIの最新画像生成モデル「ChatGPT Images 2.0」が、画像生成だけでなくテキスト生成においても高い能力を示しています。これは、近年のAI技術の進化の速さを物語っており、マルチモーダルAIの可能性を広げるものです。このモデルは、AIが多様なタスクをこなせるようになる未来を示唆しています。

ChatGPTの最新画像生成モデル「Images 2.0」は、驚くほど高度なテキスト生成能力も備えており、AIのマルチモーダル化が進んでいることを示している。

2026-04-22

Vercel AI GatewayでGPT Image 2が利用可能に:高精度な画像生成と多様なスタイルに対応

Vercel AI Gatewayで、OpenAIの最新画像生成モデル「GPT Image 2」が利用可能になったことを発表します。このモデルは、詳細な指示への追従、オブジェクト間の正確な配置と関係性、複数アスペクト比での高密度テキストレンダリングなど、高度な生成能力を備えています。2K解像度で細かな要素(小文字テキスト、アイコン、UI要素など)を描画でき、非英語テキストも一貫してサポートします。写真、映画風、ピクセルアート、マンガなど多様なスタイルを生成し、ゲームプロトタイピングやマーケティングクリエイティブなど幅広い用途に対応します。

Vercel AI GatewayでGPT Image 2が利用可能になり、指示通りの高精度な画像生成と多様なスタイル表現を実現。

2026-04-22

Clarifai、顔認識AI訓練のためにOkCupidから提供された300万枚の写真を削除か

Clarifaiが、顔認識AIの訓練に使用されたOkCupid提供の約300万枚の写真を削除したと報じられています。これは、ClarifaiがFTC(連邦取引委員会)との和解に至ったことを受けての措置です。OkCupidの幹部がClarifaiに投資していたこともあり、データ提供の経緯が注目されています。

ClarifaiがFTC和解を受け、顔認識AI訓練のためにOkCupidから提供された大量の写真を削除したことが報じられた。

2026-04-22

記事一覧

26件

絞り込み

カテゴリー

タグ

画像なし

Scaling Codex to enterprises worldwide

2026-04-22

Vercel AI GatewayでGPT Image 2が利用可能に:高精度な画像生成と多様なスタイルに対応

Vercel AI Gatewayで、OpenAIの最新画像生成モデル「GPT Image 2」が利用可能になったことを発表します。このモデルは、詳細な指示への追従、オブジェクト間の正確な配置と関係性、複数アスペクト比での高密度テキストレンダリングなど、高度な生成能力を備えています。2K解像度で細かな要素(小文字テキスト、アイコン、UI要素など)を描画でき、非英語テキストも一貫してサポートします。写真、映画風、ピクセルアート、マンガなど多様なスタイルを生成し、ゲームプロトタイピングやマーケティングクリエイティブなど幅広い用途に対応します。

Vercel AI GatewayでGPT Image 2が利用可能になり、指示通りの高精度な画像生成と多様なスタイル表現を実現。

2026-04-22

GitHub Copilot CLIで画像添付・認識モデルの対応状況を確認:全モデルで利用可能

GitHub Copilot CLIの新機能として、画像添付および認識機能を持つモデルについて、その利用可能性を検証した結果を報告します。本稿では、現時点で提供されている全てのCopilot CLI対応モデルにおいて、画像を添付し、それをAIが認識・活用できることを確認しました。これにより、コード生成やデバッグ作業において、画像データを直接参照した対話が可能となり、開発効率の向上が期待されます。

GitHub Copilot CLIは、提供中の全モデルで画像添付・認識に対応し、開発ワークフローを拡張。

2026-04-22

ブラウザ制限時代のマーケティング計測課題を解決:サーバーサイド・タギング(SST)で「見えなくなったコンバージョン」を回復

本記事では、ブラウザのプライバシー強化やサードパーティCookieの廃止により、従来の手法では計測が困難になったマーケティングコンバージョン計測の課題について解説します。その解決策として、サーバーサイド・タギング(SST)に焦点を当て、その仕組みと導入メリットを詳述します。SSTを導入することで、消失しかけていたコンバージョンデータを正確に取得・分析し、効果的なマーケティング施策の継続を可能にする方法論を提示しています。

ブラウザ制限下でも正確なコンバージョン計測を可能にするサーバーサイド・タギング(SST)の解説。

2026-04-22

SNS「Bond」:AI活用で「Doomscrolling」習慣を脱却し、現実世界への回帰を促進

新SNSプラットフォーム「Bond」は、AIシステムを活用してユーザーの「Doomscrolling」(ネガティブなニュースを延々と見続ける行為)習慣を断ち切ることを目指しています。このプラットフォームは、アプリ外での活動を促し、ユーザーを現実世界へと戻すことを目的としています。AIがユーザーの行動を分析し、現実世界での体験を奨励するモチベーションを提供することで、より健康的でバランスの取れたデジタルライフスタイルを支援します。

AIが「Doomscrolling」を抑制し、ユーザーを現実世界での活動へと促す新しいSNS。

2026-04-22

AI RPGプラットフォーム「Voyage」登場:AI生成NPCとのインタラクションでカスタムゲームワールドを創造

Latitude社は、AIネイティブプラットフォーム「Voyage」を発表しました。このプラットフォームは、ユーザーが独自のロールプレイングゲーム(RPG)を簡単に作成できるように設計されています。特に、AIによって生成されるNPC(ノンプレイヤーキャラクター)とのインタラクションを強化し、より没入感のあるゲーム体験を提供することを目指しています。これにより、個々のプレイヤーの創造性を活かした、無限のゲームワールド構築が可能になります。

AIを活用し、誰でも簡単にカスタマイズ可能なRPGゲームワールドを創造できるプラットフォーム。

2026-04-22

NVIDIA認定試験、運転免許証での本人確認で手間取った体験談

NVIDIA認定試験の受験時、本人確認で運転免許証が利用できなかったという体験談です。Certiverseの登録名と本人確認書類の表記を一致させる必要があり、その点で手間取ったとのこと。これから同試験を受験する予定のある方への注意点や参考情報として共有されています。

NVIDIA認定試験で本人確認に運転免許証を使用する際、登録名と書類名の完全一致が必須であり、注意が必要であることが示された。

2026-04-22

Clarifai、顔認識AI訓練のためにOkCupidから提供された300万枚の写真を削除か

Clarifaiが、顔認識AIの訓練に使用されたOkCupid提供の約300万枚の写真を削除したと報じられています。これは、ClarifaiがFTC(連邦取引委員会)との和解に至ったことを受けての措置です。OkCupidの幹部がClarifaiに投資していたこともあり、データ提供の経緯が注目されています。

ClarifaiがFTC和解を受け、顔認識AI訓練のためにOkCupidから提供された大量の写真を削除したことが報じられた。

2026-04-22

OpenAIのサム・アルトマンCEO、競合Anthropicのサイバーセキュリティモデル「Mythos」を「恐怖に基づくマーケティング」と批判

OpenAIのサム・アルトマンCEOは、最近のポッドキャスト出演で競合Anthropicの新しいサイバーセキュリティモデル「Mythos」について言及しました。アルトマン氏は、Anthropicが製品を実際以上に印象的に見せるために、顧客の恐怖心を煽るマーケティング手法を用いていると批判しました。これは、AI業界における競争の激化と、各社のマーケティング戦略の一端を示しています。

OpenAI CEOが競合のサイバーセキュリティAIモデルを「恐怖に基づくマーケティング」と批判し、AI業界の健全な競争について疑問を呈した。

2026-04-22

OpenAIのサム・アルトマンCEO、競合Anthropicのサイバーセキュリティモデル「Mythos」を「恐怖に基づくマーケティング」と批判

OpenAIのサム・アルトマンCEOは、最近のポッドキャスト出演で競合Anthropicの新しいサイバーセキュリティモデル「Mythos」について言及しました。アルトマン氏は、Anthropicが製品を実際以上に印象的に見せるために、顧客の恐怖心を煽るマーケティング手法を用いていると批判しました。これは、AI業界における競争の激化と、各社のマーケティング戦略の一端を示しています。

OpenAI CEOが競合のサイバーセキュリティAIモデルを「恐怖に基づくマーケティング」と批判し、AI業界の健全な競争について疑問を呈した。

2026-04-22

ChatGPTの新画像生成モデル「Images 2.0」、テキスト生成能力も驚くほど高い

OpenAIの最新画像生成モデル「ChatGPT Images 2.0」が、画像生成だけでなくテキスト生成においても高い能力を示しています。これは、近年のAI技術の進化の速さを物語っており、マルチモーダルAIの可能性を広げるものです。このモデルは、AIが多様なタスクをこなせるようになる未来を示唆しています。

ChatGPTの最新画像生成モデル「Images 2.0」は、驚くほど高度なテキスト生成能力も備えており、AIのマルチモーダル化が進んでいることを示している。

2026-04-22

AI研究ラボ「NeoCognition」、人間のように学習するエージェント開発のため4000万ドルのシード資金を調達

オハイオ州立大学の研究者によって設立されたAIスタートアップNeoCognitionが、人間のようにあらゆる分野で専門知識を習得できるAIエージェントを開発するために、4000万ドルのシード資金を調達しました。この技術は、AIの学習能力と適応性を飛躍的に向上させる可能性を秘めています。

人間のように学習し、あらゆる分野で専門知識を獲得できるAIエージェントを開発するNeoCognitionが、大規模なシード資金を調達した。

2026-04-22

Amazon GuardDutyの抑制ルール、JSONキーで詳細な条件指定が可能に

Amazon GuardDutyの抑制ルールにおいて、JSONパスを使用して検出結果のほぼ全ての属性を条件に含めることが可能になりました。これにより、より細かく、かつ柔軟な検出結果のフィルタリングや抑制設定が行えるようになります。この機能拡張は、セキュリティ運用の効率化に大きく貢献します。

Amazon GuardDutyの抑制ルールがJSONキーによる詳細な条件指定に対応し、検出結果のフィルタリング精度が飛躍的に向上した。

2026-04-22

AWS CLI 2.34.34 リリース

AWS Command Line Interface (AWS CLI) のバージョン2.34.34がリリースされました。このアップデートは、AWS CLIの継続的な改善の一環であり、新機能の追加や既存機能の修正が含まれる可能性があります。ユーザーは最新の機能やセキュリティ修正を利用するために、このバージョンへの更新を検討することが推奨されます。

AWS CLI 2.34.34がリリースされ、AWSリソース管理のためのコマンドライン機能がさらに強化されました。

2026-04-22

AWS CLI 1.44.83 リリース

AWS Command Line Interface (AWS CLI) のバージョン1.44.83がリリースされました。このリリースは、特定のバージョンタグ付けを目的としており、通常は既存機能の安定化や軽微な更新を含みます。詳細な変更点はリリースノートで確認できます。

AWS CLIのバージョン1.44.83がリリースされ、コマンドライン操作の安定性が向上しました。

2026-04-22

Appleのジョン・ターナス氏、世界有数の巨大企業を率いる:その役職は地雷原

Appleのトップ人事としてジョン・ターナス氏が就任する。この役職は、比類なき権力と報酬をもたらす一方で、多くの困難や課題を伴う「地雷原」であると指摘されている。同氏が直面するであろう複雑な状況と、その重責について報じている。

Appleの次期トップ人事には、莫大な権力と同時に計り知れないほどの難題が伴う。

2026-04-22

CloudWatch Application Signals、API経由で推奨SLO作成が可能に

Amazon CloudWatch Application Signalsに新たなアップデートがありました。これにより、これまでコンソールからのみ可能だった推奨サービスレベル目標(SLO)の作成が、API経由でも行えるようになりました。この機能拡張は、SREや運用チームが自動化やIaC(Infrastructure as Code)を推進する上で、SLO管理の柔軟性を高めるものです。本稿では、このAPI対応のアップデート内容と、その活用方法について解説します。

CloudWatch Application Signalsで推奨SLOのAPI作成がサポートされ、SREプラクティスにおける自動化とIaC連携が容易になった。

2026-04-22

SpaceX、AI開発ツールCursorとの連携、買収オプション600億ドルか

SpaceXがAI開発プラットフォームCursorと連携しており、将来的には同社を600億ドルで買収するオプションを有している可能性が報じられています。Elon Musk氏によるIPO前のこのような動きは、業界の注目を集めています。記事では、この提携と買収オプションに関する背景や、その戦略的意味合いについて考察しています。

SpaceXがAI開発ツールCursorとの連携を深め、巨額の買収オプションを持つことで、AI開発エコシステムにおける新たな動きを示唆している。

2026-04-22

Amazon Connect AIエージェント:オーケストレーションとセルフサービス、無音時の挙動比較

本稿では、Amazon ConnectのAIエージェントにおける「オーケストレーション」と「セルフサービス」の2つのタイプについて、無音時の挙動の違いを比較検証しています。AIエージェントがユーザーからの応答がない状況(無音)にどのように対応するかは、ユーザー体験に大きく影響します。この記事では、それぞれのタイプの特徴と、具体的な挙動の違いを明らかにすることで、より適切なAIエージェントの設計・活用に役立つ情報を提供します。

Amazon Connect AIエージェントのオーケストレーションとセルフサービスタイプにおける無音時の挙動の違いを比較し、最適なエージェント設計のための知見を提供する。

2026-04-22

Anthropicのサイバーツール「Mythos」に不正アクセスか、報道

匿名の情報源からの報告として、Anthropicが開発したとされる排他的なサイバーセキュリティツール「Mythos」に、不正なグループがアクセスした可能性が報じられています。Anthropicはこの主張について調査中であるとしながらも、自社システムへの影響を示す証拠はないと述べています。記事は、この報道の信憑性とAnthropicの声明について伝えています。

Anthropicのサイバーセキュリティツール「Mythos」への不正アクセス疑惑が浮上し、業界のセキュリティ管理体制に懸念が示唆されている。

2026-04-22

Anthropicのサイバーツール「Mythos」に不正アクセスか、報道

匿名の情報源からの報告として、Anthropicが開発したとされる排他的なサイバーセキュリティツール「Mythos」に、不正なグループがアクセスした可能性が報じられています。Anthropicはこの主張について調査中であるとしながらも、自社システムへの影響を示す証拠はないと述べています。記事は、この報道の信憑性とAnthropicの声明について伝えています。

Anthropicのサイバーセキュリティツール「Mythos」への不正アクセス疑惑が浮上し、業界のセキュリティ管理体制に懸念が示唆されている。

2026-04-22

Meta、従業員のキーストロークをAIモデル学習に活用する新ツールを導入

Metaが、従業員のマウス操作やクリックなどのキーストロークデータを収集し、それをAIモデルの学習に利用する新しい社内ツールを導入したことが報じられています。このデータ収集とAI学習への活用は、プライバシーや倫理的な側面から注目を集める可能性があります。記事では、このツールの概要と、その導入背景について触れています。

Metaが従業員のキーストロークデータをAIモデル学習に活用する新ツールを導入し、AI開発におけるデータ収集手法に新たな側面を提示している。

2026-04-22

GuardDuty Malware Protection for S3、EventBridge通知にstatusReasonsフィールドが追加

Amazon GuardDuty Malware Protection for S3に関するアップデート情報です。今回の変更により、EventBridge通知に新たに`statusReasons`フィールドが追加されました。このフィールドは、マルウェア検出のステータスに関する詳細な理由を提供し、より精緻なアラート管理を可能にします。本稿では、このアップデートの概要と、それがセキュリティ運用に与える影響について解説します。

GuardDuty Malware Protection for S3のEventBridge通知に`statusReasons`フィールドが追加され、マルウェア検出の詳細な原因把握と迅速な対応が可能になった。

2026-04-22

Claude Codeの/tui fullscreenモードで実現するチラつきフリーなTUI体験

この記事では、AnthropicのClaude Codeに搭載されている「/tui fullscreen」コマンドの機能について詳細に検証します。この機能を利用することで、ターミナルユーザーインターフェース(TUI)アプリケーションにおいて、画面のチラつきを抑えたスムーズな表示体験が可能になることが示されています。筆者は実際にこのモードを試用し、その効果と実用性を評価しています。

Claude Codeの/tui fullscreen機能は、TUIアプリケーションにおける画面描画のチラつきを解消し、滑らかなユーザー体験を提供する。

2026-04-22

LLMアプリケーションの観測と評価をArize Phoenixで実践

本稿では、LLM(大規模言語モデル)アプリケーションの運用における観測性と評価の重要性に焦点を当て、Arize Phoenixを用いた実践的なハンズオンを紹介します。Arize Phoenixが提供する機能を用いて、LLMアプリケーションのパフォーマンスや挙動をどのようにモニタリングし、潜在的な問題を特定・改善していくかについて具体的に解説しています。これにより、開発者はLLMアプリケーションの信頼性と効果を向上させるための具体的な手法を学ぶことができます。

Arize Phoenixを活用することで、LLMアプリケーションの観測と評価を効率化し、品質向上に直結させることが可能になる。

2026-04-22

DevRev AIアシスタント「DevRev Computer」のWebSearch機能活用入門

本記事では、DevRevのAIアシスタント「DevRev Computer」の基本的な操作方法を解説します。特に、WebSearch機能を追加することで、AIが参照できる情報の範囲をどのように拡張できるかに焦点を当てています。実際に機能を試しながら、その設定手順と活用方法を具体的に紹介し、開発者がより広範な情報源を活用できるようになるための第一歩を示します。

DevRev ComputerにWebSearch機能を追加することで、AIによる情報検索の範囲を飛躍的に拡張できる。

2026-04-22