本日のニュース総括(38件)

本日のニュース総括(38件)

📊 今日の総括

今日のテックニュースは、AI技術の深層進化から実用化、そして倫理的議論に至るまで、その多岐にわたる側面を浮き彫りにしています。OpenAIがLLMの命令階層理解を改善し、より複雑なプロンプト対応を可能にした一方、Amazon BedrockはClaudeモデル向けに機密情報フィルタリング機能を提供し、安全なAI利用を推進しています。また、Adobe PhotoshopへのAIアシスタント統合は、クリエイティブワークフローに大きな変革をもたらすでしょう。さらに、Anthropicの米国防総省に対する訴訟は、AIの倫理的利用と規制に関する業界全体の議論を深める重要な契機となっています。

🔍 ピックアップ

【1】OpenAIのフロンティアLLMにおける命令階層の改善

■ 何が変わるか

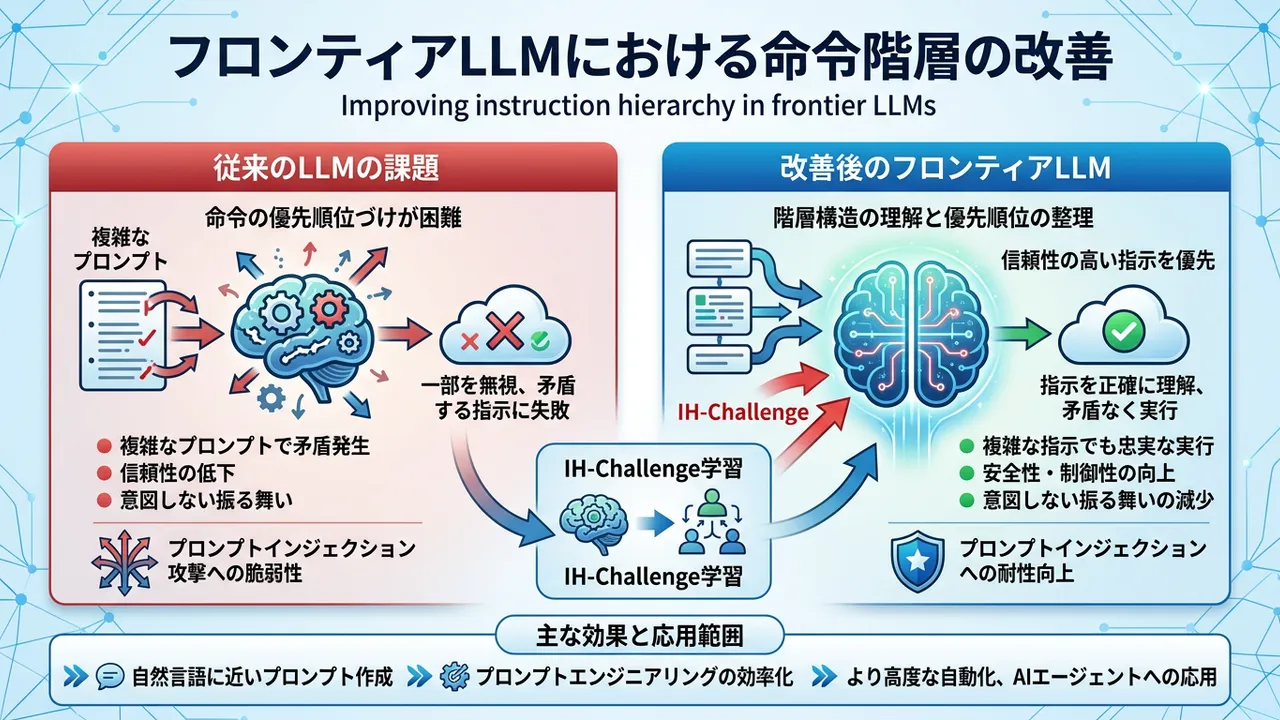

OpenAIは、フロンティアLLM(大規模言語モデル)における命令階層の理解能力を大幅に改善しました。これにより、複数の指示や制約が与えられた際でも、モデルがそれらの優先順位や相互関係をより正確に解釈し、矛盾なく実行できるようになります。ユーザーはこれまで以上に自然言語に近い形で複雑なプロンプトを作成することが可能となり、モデルは意図しない振る舞いを減少させ、タスクの忠実性が向上することが期待されます。

■ なぜ重要か

これまでのLLMは、命令が複雑化すると一部を無視したり、矛盾する指示に適切に対応できないという課題を抱えていました。今回の改善は、AIエージェントや自律型システムの実装において不可欠なブレークスルーであり、より信頼性の高いAIアプリケーション開発を可能にします。プロンプトエンジニアリングの効率化だけでなく、LLMの応用範囲を高度な自動化や意思決定支援システムへと大きく拡大させる鍵となるでしょう。

■ あなたへの影響

LLMを活用した開発者にとって、プロンプト設計の柔軟性が格段に向上します。より複雑な要件を持つタスクをAIに任せやすくなり、例えば、複数のステップを要するデータ処理やコンテンツ生成、自動コード生成などにおいて、より高度な制御が可能になります。これにより、開発者はより創造的な課題に集中でき、AIシステムの信頼性向上はデバッグや検証のコスト削減にも繋がる可能性があります。

■ アクション

まずはOpenAIの最新モデルで、複数の指示や制約を含むプロンプトを試行し、以前のモデルとの応答の違いを検証してください。既存のプロンプトで曖昧さや矛盾を抱えている部分がないか見直し、この新機能が解決策となるか評価しましょう。OpenAIのAPIドキュメントで関連する更新情報を確認し、実践的なプロンプトエンジニアリングのベストプラクティスを学ぶことを推奨します。

■ 元記事

【2】Amazon Bedrock GuardrailsでClaude Codeの機密情報フィルタリング

■ 何が変わるか

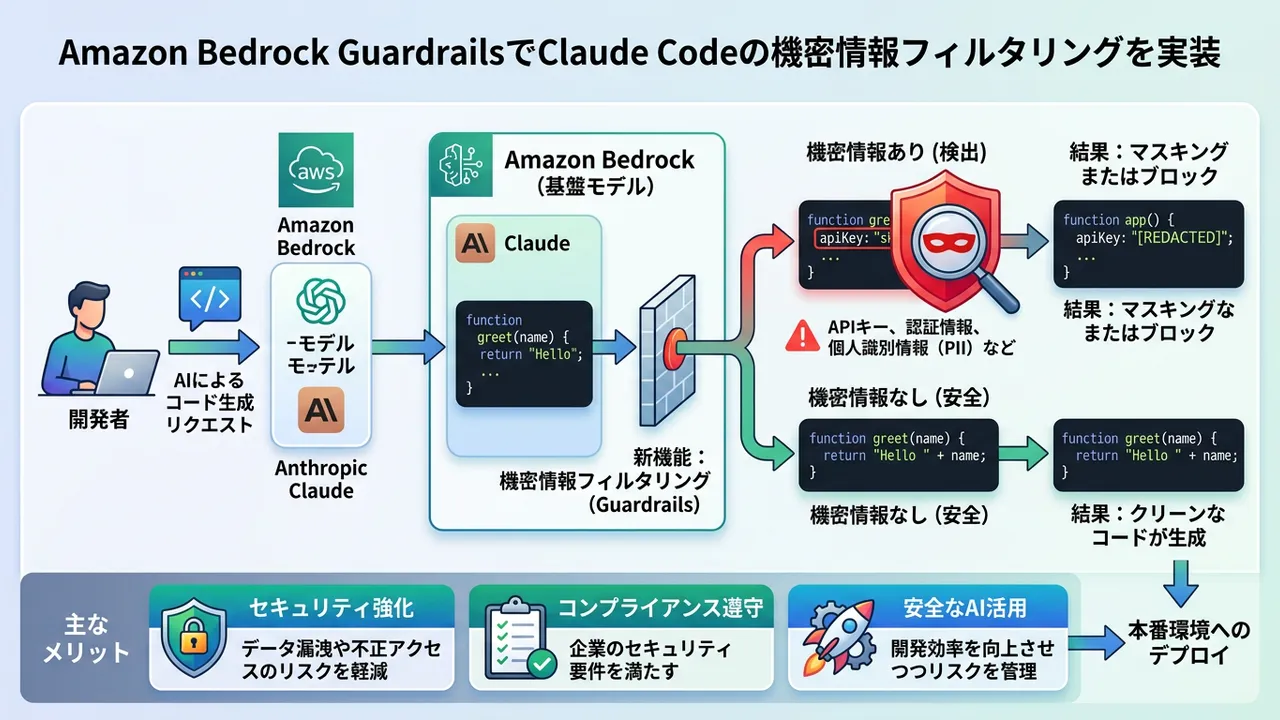

Amazon BedrockのGuardrails機能が強化され、AnthropicのClaudeなどの基盤モデル(FM)から生成されるコード内の機密情報をリアルタイムで検出・フィルタリングできるようになりました。この新機能により、APIキー、認証情報、個人識別情報(PII)などが含まれるコード片を特定し、マスキングまたはブロックすることが可能となります。AIが生成したコードを本番環境にデプロイする際のリスクを大幅に軽減し、セキュリティとコンプライアンスを強化します。

■ なぜ重要か

AIによるコード生成は開発効率を向上させますが、同時にセキュリティリスクも増大させます。特に、誤って機密情報が生成コードに埋め込まれてしまうと、データ漏洩や不正アクセスといった重大なインシデントにつながりかねません。Bedrock Guardrailsによるこの機能は、開発者がAIを活用した開発プロセスを安全に進める上で不可欠なセキュリティ層を提供し、企業のコンプライアンス要件を満たしつつ、AIの生産性向上を享受するための鍵となります。

■ あなたへの影響

AIを用いたコード生成や自動化を導入している、または検討している開発チームにとって、この機能はセキュリティとコンプライアンスの大きな助けとなります。特に、本番環境向けのコードを扱うバックエンドエンジニアやDevSecOpsエンジニアは、意図しない機密情報の漏洩リスクを自動的に低減できるようになるため、安心してAIツールを導入・運用できます。初期設定やポリシー定義の学習は必要ですが、長期的な運用コスト削減とリスク回避に貢献するでしょう。

■ アクション

Bedrockを利用している場合、Guardrailsの設定を見直し、ClaudeなどのFMからのコード生成時に機密情報フィルタリングポリシーを適用することを検討してください。特に、ソースコード管理システムへのAI生成コードのコミット前に、このフィルタリングが機能するか検証するためのテストシナリオを構築しましょう。公式ドキュメントで詳細な設定方法と、検出可能な機密情報の種類を確認し、自社のセキュリティポリシーに合わせたカスタマイズを計画することをお勧めします。

■ 元記事

【3】Adobe Photoshop向けAIアシスタント発表、Firefly新機能も

■ 何が変わるか

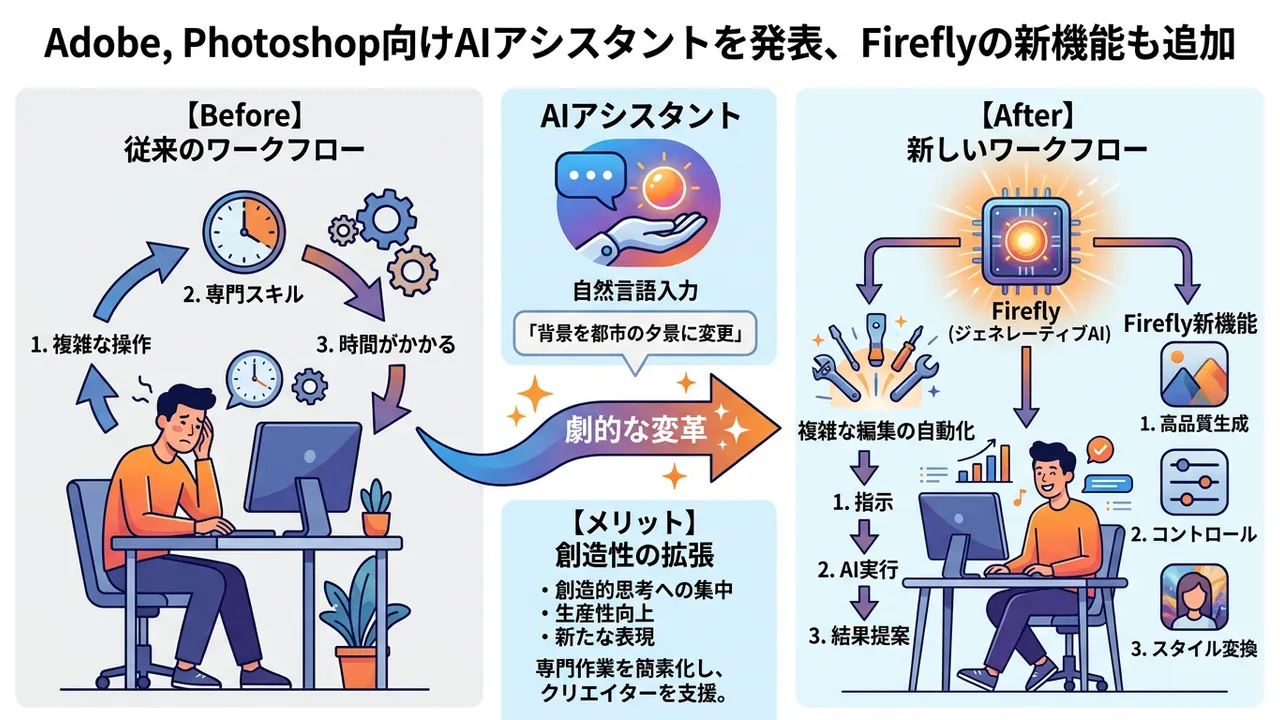

Adobeが主力製品であるPhotoshopにAIアシスタントを導入し、ジェネレーティブAI「Firefly」の新機能も追加しました。このAIアシスタントにより、ユーザーはより自然言語で複雑な画像編集タスクを指示できるようになります。例えば、「背景を削除して、都市の夕景に置き換える」といった指示で、AIが自動的に複数のステップを実行し、編集結果を提案します。Fireflyの新機能は、より高品質でコントロール可能な画像生成や、既存要素のスタイル変換などを可能にし、クリエイティブワークフローを大幅に効率化します。

■ なぜ重要か

Photoshopのようなプロフェッショナル向けツールへのAIの本格的な統合は、デザインワークフローを劇的に変革する可能性を秘めています。これまで専門的なスキルと時間を要した複雑な作業がAIによって簡素化され、クリエイターはより創造的な思考とアイデアの実現に集中できるようになります。これは単なる機能追加に留まらず、クリエイティブ業界全体の生産性向上と、新たな表現手法の創出を促す画期的な進展です。AIが人間の創造性を強力に拡張する具体的な事例として注目されます。

■ あなたへの影響

フロントエンド開発者やUI/UXデザイナーは、より迅速かつ効率的に高品質なデザインアセットを生成・編集できるようになります。デザインのプロトタイプ作成やイテレーションが加速し、開発サイクル全体の短縮に貢献するでしょう。また、AIを活用した新しいデザインワークフローへの適応が求められるようになります。既存のスキルセットに加えて、AIアシスタントへの効果的な指示出し(プロンプトエンジニアリング)のスキルが、デザインプロセスの中心的な能力となる可能性があります。

■ アクション

Photoshopのベータプログラムや先行アクセスプログラムに参加し、AIアシスタントやFireflyの新機能を実際に試すことを強く推奨します。特に、日常的に行っている画像編集作業をAIに任せてみて、どの程度の効率化が可能か、どのような指示で最適な結果が得られるかを検証してください。Adobeの公式チュートリアルやコミュニティフォーラムを参考に、新しいワークフローへの移行方法を学び、チーム内での知見共有を検討しましょう。

■ 元記事

【4】Anthropicの米国防総省訴訟:AI安全利用の「レッドライン」を巡る議論

■ 何が変わるか

AI開発企業Anthropicが米国防総省を相手取り訴訟を起こしたことは、AIの安全利用における「レッドライン」設定の重要性を浮き彫りにしています。Anthropicは、自社のAI技術が特定の軍事目的や監視、プロパガンダといった悪用を防ぐための使用制限を国防総省に要求しており、これが法的議論の的となっています。この訴訟にはOpenAIやGoogleの従業員もAnthropicを支持する意見書を提出しており、AI業界全体で倫理的かつ安全なAI開発・利用への意識が急速に高まっていることが示唆されます。

■ なぜ重要か

AI技術が軍事目的や監視、プロパガンダといった分野で悪用されるリスクは、倫理的AI開発者にとって最大の懸念事項の一つです。この訴訟は、AI開発企業が自社の技術の利用方法に対してどこまで責任を持つべきか、また政府機関がAI技術をどのように規制・利用すべきかという、根源的な問いを投げかけます。AIの「安全なフットプリント」を確保するための業界の取り組みや、将来的なAI規制の方向性を占う上で極めて重要な出来事であり、すべてのAIエンジニアが注目すべき動向です。

■ あなたへの影響

AI開発に携わるエンジニアとして、自身の開発するAIモデルやアプリケーションが意図しない形で利用される可能性、あるいは倫理的な問題を引き起こす可能性について、より深い考察と責任が求められるようになります。企業がAIの倫理ガイドラインや利用ポリシーを策定・強化する動きが加速する可能性があり、開発プロセスにおいても倫理的側面やリスク評価がこれまで以上に重視されるようになるでしょう。法的・倫理的リスクを低減するための知識と意識が、エンジニアの必須スキルとなりつつあります。

■ アクション

AIの倫理、責任あるAI(Responsible AI)に関する最新のガイドラインやフレームワーク(例: NIST AI RMF, EU AI Actなど)を学習し、理解を深めてください。自身の開発するAIプロジェクトにおいて、潜在的な悪用リスクや倫理的問題についてチームで議論する機会を積極的に設けることを推奨します。また、企業のAI利用ポリシーやセキュリティポリシーの策定に関与し、技術的な視点から実現可能性とリスクを提言できるよう、業界の動向やAnthropicの訴訟の進展を注視しましょう。

■ 元記事

内訳:

注目記事

画像なし

Improving instruction hierarchy in frontier LLMs

2026-03-11

Hono v4.12.6 リリース:React 19互換性向上とLambda Edge対応強化

Hono v4.12.6 のリリースノートでは、`accept` ヘッダー処理におけるReDoS脆弱性の修正、JSX処理のReact 19との互換性向上、およびTypeScriptプロジェクト設定の改善が含まれています。さらに、Lambda Edge環境での`NODEJS_24_X`ランタイムにおけるコールバックハンドラ非推奨への対応など、実用的な改善が施されています。これらの変更により、Honoの堅牢性と開発者体験が向上しました。

JSX処理のReact 19互換性向上と、Lambda Edge環境への対応強化という、開発者体験と堅牢性を向上させる実用的な変更が含まれた点です。

2026-03-11

Amazon Bedrock GuardrailsでClaude Codeの機密情報フィルタリングを実装

本記事では、Amazon Bedrock経由でClaude Codeを利用する際に、Amazon Bedrock Guardrailsを用いて機密情報をフィルタリングする具体的な方法を解説します。機密データがAIモデルへの入力や出力に含まれるリスクを軽減するため、Guardrailsの設定と動作確認について詳細に説明しています。これにより、安全かつセキュアなAI利用環境の構築に貢献します。

Amazon Bedrock Guardrailsを活用し、Claude Code利用時の機密情報漏洩リスクを効果的に軽減する実装方法を示した点です。

2026-03-11

記事一覧

38件

絞り込み

カテゴリー

タグ

Anthropic、米国防総省を相手取り訴訟:AIの安全利用に関する「レッドライン」設定が理由

Anthropicは、米国防総省が同社をサプライチェーンリスクに指定したことを不当として、連邦政府を提訴しました。訴状によると、この指定はAnthropicが大量の国内監視や自律型兵器に関する「レッドライン」を設定したことへの報復であると主張しています。同社は、AIの安全性とモデルの限界に関する「保護された見解」を遵守したことが、憲法違反の懲罰につながったと訴えています。

AI企業Anthropicが、AIの安全利用に関する倫理的・技術的制約(レッドライン)を設定したことへの報復として、米国防総省を相手取り訴訟を起こしたことです。

2026-03-11

OpenAI・Google従業員、Anthropicの国防総省訴訟を支持する意見書を提出

OpenAIとGoogleの従業員数十名が、Anthropicが米国防総省を相手取って起こした訴訟を支持する意見書(amicus brief)を提出しました。この意見書は、トランプ政権によるAnthropicのサプライチェーンリスク指定に懸念を示し、AIの安全保障と倫理的利用に関する重要性を強調しています。GoogleのチーフサイエンティストであるJeff Dean氏も署名しており、AI分野における倫理的課題への大手企業間の関心の高まりを示唆しています。

OpenAIやGoogleのトップクラスの研究者たちが、AI倫理を巡るAnthropicの訴訟を支持する形で、AIの安全保障と利用に関する懸念を表明したことです。

2026-03-11

Hono v4.12.6 リリース:React 19互換性向上とLambda Edge対応強化

Hono v4.12.6 のリリースノートでは、`accept` ヘッダー処理におけるReDoS脆弱性の修正、JSX処理のReact 19との互換性向上、およびTypeScriptプロジェクト設定の改善が含まれています。さらに、Lambda Edge環境での`NODEJS_24_X`ランタイムにおけるコールバックハンドラ非推奨への対応など、実用的な改善が施されています。これらの変更により、Honoの堅牢性と開発者体験が向上しました。

JSX処理のReact 19互換性向上と、Lambda Edge環境への対応強化という、開発者体験と堅牢性を向上させる実用的な変更が含まれた点です。

2026-03-11

Amazon Bedrock GuardrailsでClaude Codeの機密情報フィルタリングを実装

本記事では、Amazon Bedrock経由でClaude Codeを利用する際に、Amazon Bedrock Guardrailsを用いて機密情報をフィルタリングする具体的な方法を解説します。機密データがAIモデルへの入力や出力に含まれるリスクを軽減するため、Guardrailsの設定と動作確認について詳細に説明しています。これにより、安全かつセキュアなAI利用環境の構築に貢献します。

Amazon Bedrock Guardrailsを活用し、Claude Code利用時の機密情報漏洩リスクを効果的に軽減する実装方法を示した点です。

2026-03-11

運用初心者のためのAI活用術:opsmethod #1での登壇資料

本記事は、opsmethod #1にて登壇された「運用初心者がAIと頑張るために、やってみたこと」というテーマの発表資料を共有するものです。AIを運用業務に活用しようとする初心者が直面する課題や、それらを克服するために試行錯誤した具体的なアプローチについて解説しています。AIツールの選定、導入、そして効果的な活用方法に至るまでの実践的なノウハウが、事例を交えて紹介されています。

AI活用に不慣れな運用担当者が、試行錯誤を経てAIを現場で効果的に活用するための実践的なステップを共有した点です。

2026-03-11

CloudWatch Synthetics Canaryで作成されたLambda関数のランタイムを更新する方法

本記事は、AWS CloudWatch Synthetics Canaryによって自動生成されたLambda関数のランタイムを更新する具体的な手順を解説します。通常、Canaryで生成されたLambda関数は直接編集が困難ですが、本記事ではその制限を回避し、ランタイムを安全かつ効果的にアップデートする方法を提供します。これにより、最新のランタイムを利用してCanaryの実行環境を最新の状態に保つことが可能になります。

CloudWatch Synthetics Canaryで生成されたLambda関数のランタイムを、制限を回避して安全に更新する具体的な手順を示した点です。

2026-03-11

OpenAI・Google従業員、Anthropicの訴訟を支持する意見書を提出

OpenAIとGoogleの従業員らが、Anthropicが米国防総省を相手取って起こした訴訟を支持する意見書を提出しました。この意見書は、トランプ政権によるAnthropicのサプライチェーンリスク指定に対する懸念を表明しており、AIの安全保障と倫理的な利用に関する重要性を示唆しています。この動きは、大手AI企業間の連携と、AI開発における倫理的課題への意識の高まりを浮き彫りにしています。

主要AI企業従業員が、AI倫理と安全保障を巡る法的争訟で連携を示したことです。

2026-03-11

VSS Event Reviewer を用いた映像リアルタイム監視の実践ガイド

本記事では、DGX Spark の Event Reviewer を使用して、映像データをリアルタイムで監視する具体的な手順を解説します。Event Reviewer の導入から設定、そして実際の監視画面での操作方法までを網羅しており、映像分析システムにおけるリアルタイム監視の実現可能性を示しています。これにより、セキュリティ監視や品質管理など、様々な分野での活用が期待できます。

DGX Spark の Event Reviewer を使えば、映像データをリアルタイムで効率的に監視できることを実証した点です。

2026-03-11

NRI、Anthropic Japanとのパートナーシップを拡大し、日本市場向けClaude導入支援とAI技術者育成を促進

野村総合研究所(NRI)は、Anthropic Japanとのパートナーシップを拡大することを発表しました。この提携により、日本市場向けにAnthropicのAIモデル「Claude」の導入支援体制を整備し、自社での導入も進めることで、AI技術者の育成を促進します。これは、日本企業における先進AI技術の活用を推進し、国内のAI人材不足解消に貢献することを目指す取り組みです。

NRIがAnthropic Japanとの提携を拡大し、日本市場でのClaude導入支援とAI技術者育成を強化します。

2026-03-11

画像なし

New ways to learn math and science in ChatGPT

2026-03-11

画像なし

Improving instruction hierarchy in frontier LLMs

2026-03-11

Hono v4.12.7リリース:セキュリティ強化のため__proto__パスセグメントの無視を追加

WebフレームワークHonoの最新リリースv4.12.7では、セキュリティ強化策として、parseBody関数におけるdotオプション有効時の__proto__パスセグメントの無視が実装されました。これにより、不審なパターンとの結合によるプロトタイプ汚染の潜在的なリスクが軽減されます。このアップデートは、Honoのセキュリティ堅牢性を高め、より安全な開発環境を提供することを目的としています。

Hono v4.12.7リリースにより、プロトタイプ汚染のリスクを軽減するセキュリティ強化が行われました。

2026-03-11

【入門】MCP Appsとは?公式サンプルで概要と内部構造を理解する

本記事は、MCP Appsの入門ガイドとして、その概要と内部的な仕組みを公式サンプルを試しながら解説します。MCP Appsがどのような機能を提供し、どのように動作するのかを具体的に理解することを目指します。開発者やIT担当者にとって、MCP Appsの基本的な知識を習得し、その活用方法を学ぶための有益な情報源となるでしょう。

MCP Appsの入門ガイドとして、公式サンプルを通じてその概要と内部構造を分かりやすく解説しています。

2026-03-11

Adobe、Photoshop向けAIアシスタントを発表、Fireflyの新機能も追加

Adobeは、クリエイティブワークフローを革新するPhotoshop向けのAIアシスタントを発表しました。このAIアシスタントは、ユーザーの画像編集作業を支援し、効率化を図ります。さらに、Adobe Fireflyにも新しいAI搭載の画像編集機能が追加されます。これらの新機能は、AdobeのクリエイティブツールにおけるAIの活用をさらに深め、ユーザーに先進的な編集体験を提供することを目指しています。

AdobeがPhotoshopにAIアシスタントを導入し、FireflyにもAI画像編集機能を拡充することで、クリエイティブ作業の効率化を推進します。

2026-03-11

YouTube、AIによるディープフェイク検出機能を政治家、政府関係者、ジャーナリストにも拡大

YouTubeは、AIを活用したディープフェイク検出ツールの提供範囲を、政治家、政府関係者、ジャーナリストにまで拡大します。このツールにより、これらの関係者は不正に生成された自身の肖像(ディープフェイク)をフラグ付けし、削除を要請できるようになります。これは、オンラインでの偽情報対策を強化し、公人や情報発信者の信頼性を保護するための重要な措置です。YouTubeは、AI技術を用いてプラットフォームの健全性を維持することを目指しています。

YouTubeがAIディープフェイク検出機能を政治家、政府関係者、ジャーナリストに提供開始し、偽情報対策と信頼性保護を強化しました。

2026-03-11

MetaがAIエージェント型SNS「Moltbook」を買収、フェイク投稿でバイラル化

Metaは、AIエージェントを基盤としたソーシャルネットワーク「Moltbook」を買収しました。Moltbookは、フェイク投稿によってバイラル化し、注目を集めました。Metaは、Moltbookの「常時接続ディレクトリを通じてエージェントを接続する」アプローチを革新的だと評価しています。この買収は、MetaのAIエージェント分野への投資を強化し、ソーシャルメディアの将来におけるAIの役割を探求する戦略の一環と考えられます。

MetaがAIエージェント型SNS「Moltbook」を買収し、AIエージェント間の連携を軸とした革新的なアプローチを取り込みました。

2026-03-11

AIリーガルテックの隆盛続く、Legoraが55.5億ドルの評価額に到達

弁護士向けAIプラットフォームであるLegoraは、Accel主導の5.5億ドルシリーズD資金調達を経て、評価額55.5億ドルを達成しました。この資金調達は、米国内での事業拡大を加速させるために活用されます。AIがリーガルテック分野に革命をもたらす中、Legoraは法律業務の効率化と高度化に貢献しています。同社の成長は、AI技術が専門職分野で成功を収める事例として注目されています。

AIリーガルテックプラットフォームLegoraが55.5億ドルの評価額を達成し、AI技術の専門職分野での成功を証明しました。

2026-03-11

Google、AI搭載「Ask Photos」検索機能へのユーザーの不満に対応し、機能選択肢を提供

Googleは、AIを活用した「Ask Photos」検索機能に関するユーザーからの不満を受け、この機能への対応を変更しました。写真検索画面に、ユーザーがAIによる検索体験を選択できるオプションが表示されるようになります。これにより、ユーザーは従来の検索方法とAIを活用した高度な検索方法を自由に選択できるようになります。この変更は、ユーザーエクスペリエンスの向上と、AI機能への過度な依存に対する懸念への対応を目的としています。

Google PhotosがAI検索機能へのユーザーの不満に対応し、機能選択肢を提供することで、ユーザーエクスペリエンスを向上させました。

2026-03-11

Thinking Machines Lab、NVIDIAと大規模コンピューティングリソース契約を締結

AI開発を手がけるThinking Machines Labは、NVIDIAと大規模なコンピューティングリソースに関する複数年契約を締結しました。この契約には、少なくとも1ギガワットのコンピューティングパワーが含まれており、NVIDIAからの戦略的投資も含まれています。これにより、同社はAIモデルの開発とトレーニングを加速するための強力なインフラを確保しました。

Thinking Machines LabがNVIDIAと1ギガワット規模のコンピューティングリソースを含む大規模契約を締結し、AI開発を加速させます。

2026-03-11

AIエージェント向けメールサービス開発のAgentMail、600万ドル調達

AgentMailは、AIエージェント専用のメールサービスを開発するため、600万ドルの資金調達を発表しました。同社はAPIプラットフォームを提供し、AIエージェントが独自のメール受信トレイを持つことを可能にします。双方向の会話、メールの解析、スレッド管理、ラベリング、検索、返信といった機能をサポートし、AIエージェント間のコミュニケーションを効率化します。

AIエージェントが独自のメール送受信や高度な管理を行えるサービスを開発するAgentMailが、600万ドルの資金調達に成功しました。

2026-03-11

Anthropic CEO、AIの「意識」や「ペルソナ」の可能性に言及

AnthropicのCEOであるアモデイ氏は、AIに意識がないとは断言できないという見解を示しました。AIの中に芽生える可能性のある「意識」や「ペルソナ」との向き合い方について、倫理的・哲学的な課題を提示しています。この発言は、AIの進化に伴う人間との関係性や、AIの自律性に関する議論を深めるものとして注目されます。

Anthropic CEOが、AIに意識がないとは断言できず、AIの中に芽生える「意識」や「ペルソナ」との向き合い方を問うています。

2026-03-11

米国防総省、Anthropicをサプライチェーンリスクとして正式指定

米国防総省は、AI企業Anthropicをサプライチェーンリスクとして正式に指定しました。この指定は、国家安全保障上の観点から、Anthropicの技術やサービスがもたらす潜在的なリスクを評価した結果と考えられます。具体的な影響については更なる情報が待たれますが、AI企業のサプライチェーンにおけるセキュリティ懸念が浮き彫りになりました。

米国防総省がAI企業Anthropicをサプライチェーンリスクとして正式に指定しました。

2026-03-11

スカイアーチネットワークス、Amazon BedrockでAnthropicのAIモデル利用へ提携

スカイアーチネットワークスは、Amazon Bedrock上でAnthropic社のAIモデルを利用可能にするための提携を発表しました。これにより、同社は顧客に対して、より高度で多様なAIソリューションを提供できるようになります。Amazon Bedrockというクラウド基盤を活用することで、スケーラビリティと信頼性の高いAIサービス提供が期待されます。

スカイアーチネットワークスがAmazon Bedrock上でAnthropicのAIモデルを利用可能にする提携を発表しました。

2026-03-11

ChatGPT、数学・科学概念理解のためのインタラクティブビジュアル生成機能を追加

ChatGPTは、数学や科学の概念を理解するのに役立つインタラクティブなビジュアルを生成する新機能を追加しました。これにより、ユーザーは単なる説明や静的な図を見るだけでなく、直接操作できるビジュアルを通じて学習できるようになります。この機能は、複雑な概念の理解を深め、教育体験をより豊かにすることを目的としています。

ChatGPTが、数学や科学の概念理解を助けるインタラクティブなビジュアル生成機能を提供開始しました。

2026-03-11

AWS CLI リリースノート: 2.34.6

AWS Command Line Interface (CLI) のバージョン2.34.6がリリースされました。このリリースは、AWS CLIの安定版リリースとしてタグ付けされており、具体的な変更内容はリリースノートに詳細が記載されていると推測されます。ユーザーは、このアップデートにより、AWS CLIの機能改善やバグ修正の恩恵を受けることができます。

AWS CLIの最新安定版であるバージョン2.34.6がリリースされました。

2026-03-11

AWS CLI リリースノート: 1.44.55

AWS Command Line Interface (CLI) のバージョン1.44.55がリリースされました。このリリースは、AWS CLIの安定版リリースとしてタグ付けされており、特に注目すべき新機能や破壊的変更については明記されていません。ユーザーは、このアップデートを適用することで、AWS CLIの最新の安定した状態を利用できます。

AWS CLIの最新安定版であるバージョン1.44.55がリリースされました。

2026-03-11

AI搭載アプリは長期的なユーザー維持に課題、新レポートが示す

RevenueCatの最新レポートによると、AI搭載アプリは初期の収益化を強化する可能性があるものの、長期的なユーザー維持には課題を抱えていることが明らかになりました。AIはユーザーエンゲージメントの初期段階で強力な効果を発揮しますが、継続的な価値提供が難しさとなっています。この課題を克服するには、AIの活用方法の進化や、ユーザー体験の継続的な改善が求められます。

AI搭載アプリは初期収益化を強化する一方、長期的なユーザー維持には継続的な価値提供という大きな課題に直面しています。

2026-03-11

Amazon、ウェブサイトとアプリでヘルスケアAIアシスタントを提供開始

Amazonは、ウェブサイトとアプリを通じて、ユーザーの健康に関する質問に回答し、健康記録の説明、処方箋更新の管理、予約の調整などを行うAIアシスタントの提供を開始しました。このAIは、健康管理の利便性を向上させ、ユーザーが自身の健康情報にアクセスしやすくなることを目指しています。これにより、Amazonはヘルスケア分野でのサービスを拡充します。

Amazonがウェブサイトとアプリで、健康記録の説明や予約管理まで可能なヘルスケアAIアシスタントの提供を開始しました。

2026-03-11

AIネイティブ企業の条件:SaaS is Dead時代の生き残り戦略

「SaaS is Dead」とも言われる現代において、AIネイティブ企業が生き残るための条件と、上場企業が直面するジレンマについて分析しています。AIを前提としたビジネスモデルの構築や、変化に迅速に対応できる柔軟性が、今後の企業成長の鍵となります。従来のSaaSモデルとの比較や、AI時代における新たなビジネス戦略の方向性を示唆する記事です。

SaaSの限界が指摘される中、AIネイティブ企業が「SaaS is Dead」時代を生き抜くための戦略と、上場企業が抱えるジレンマを考察しています。

2026-03-11

GASとOpenAIで「自分AI」を作成し自己紹介を自動化

本記事では、自己紹介が苦手な筆者がGAS(Google Apps Script)とOpenAI APIを活用して、自身のX(旧Twitter)投稿50件から「自分AI」を作成した体験談を共有しています。このAIは、投稿内容を学習し、自己紹介文を生成する能力を持ちます。GASとOpenAIの連携により、パーソナライズされたAIを比較的容易に構築できる可能性を示唆しています。

GASとOpenAI APIを連携させ、個人のSNS投稿から「自分AI」を生成して自己紹介を自動化するユニークな試みを紹介しています。

2026-03-11

OpenAI・Google従業員ら、Anthropic支持の意見書を提出

OpenAIとGoogleの従業員らが、Anthropicを支持する意見書を提出したことが報じられました。この動きは、AI業界における協力や競争の複雑な関係性を示すものです。彼らは、AnthropicのAI開発や倫理的な取り組みを支持する姿勢を示し、業界全体の健全な発展に貢献することを目指しています。

OpenAIとGoogleの従業員がAnthropicを支持する意見書を提出し、AI業界における協力と競争の新しい側面を示しました。

2026-03-11

Amazon Quickでのユーザー削除時のアセット挙動確認

Amazon Quick でユーザーを API 経由で削除した際に、そのユーザーが所有していたアセット(データやリソース)がどのように扱われるのかを検証した記事です。削除処理の挙動を理解することは、データ管理やコンプライアンスの観点から重要です。本記事では、具体的なAPI操作と、それに伴うアセットの状態変化について詳細に解説しています。

Amazon QuickでAPI経由のユーザー削除時に、ユーザー所有アセットがどのように処理されるかを詳細に検証・解説しています。

2026-03-11

暗号資産企業イオレ、Anthropicへ500万ドル出資

暗号資産トレジャリー事業を手掛けるイオレが、生成AI大手のAnthropicにSPV(特別目的会社)経由で500万ドルを出資したことが報じられました。この出資は、AI技術の将来性に対する暗号資産業界からの期待を示すものと考えられます。AnthropicのAI技術と、イオレの暗号資産事業とのシナジー効果が期待されます。

暗号資産企業イオレが生成AI大手Anthropicに500万ドルを出資し、AI分野への投資が暗号資産業界でも活発化していることを示唆しています。

2026-03-11

Amazon Quick SpaceとGoogle Drive連携による自然言語での議事録検索

本記事では、Amazon Quick の Space に Google Drive を連携し、Chat Agent を用いて商談議事録を自然言語で検索する手法を解説しています。これにより、大量の議事録データから必要な情報を迅速かつ容易に抽出することが可能になります。Google Drive に保存されたドキュメントを Chat Agent が解析し、ユーザーの質問に対して関連性の高い議事録を提示する仕組みを検証しています。

Amazon Quick SpaceとGoogle Driveを連携させ、Chat Agentで議事録を自然言語検索する実用的な活用事例を紹介しています。

2026-03-11

AnthropicのClaudeを活用したガバナンス対応型AI開発推進に関するプレスリリース

Anthropicは、同社のAIモデル「Claude」を活用した、ガバナンス対応型のAI駆動開発を推進するプレスリリースを発表しました。これにより、企業はコンプライアンスやセキュリティ要件を満たしながら、AIを活用した効率的な開発プロセスを構築することが可能になります。Claudeの高度な言語理解能力と生成能力が、ガバナンス強化に貢献する点が強調されています。

AnthropicがClaudeを活用し、ガバナンス要件を満たしつつAI駆動開発を推進するソリューションを発表しました。

2026-03-11

Microsoft、Anthropicを支持するアミカスブリーフをDoW訴訟で提出

Microsoftは、DoW(Disinformation on the Web)に関する訴訟において、AI企業Anthropicを支持するアミカスブリーフを提出しました。この動きは、AI開発におけるオープンな環境と倫理的な利用を促進するMicrosoftの姿勢を示すものです。MicrosoftはAnthropicとのパートナーシップを強化しており、AI技術の進歩と安全な社会実装の両立を目指しています。

MicrosoftがDoW訴訟でAnthropicを支持するアミカスブリーフを提出し、AI開発におけるオープン性と倫理的利用へのコミットメントを示しました。

2026-03-11

Google Workspaceのゼロからの初期設定ガイド

本記事では、Google Workspaceを新規に導入する際の初期設定プロセスを詳細に解説しています。ドメイン設定からユーザーアカウントの作成、基本的なサービス(Gmail, Drive, Calendarなど)の設定方法までを網羅しています。各ステップにおける注意点や推奨設定も示されており、管理者がスムーズに環境を構築できるようサポートします。導入時の設定ミスを防ぎ、効率的な運用を開始するための実践的なガイドです。

Google Workspaceの初期設定をゼロから行うための、ドメイン設定から基本サービス構成までを網羅した実践的なガイドです。

2026-03-11

【GA】Google Cloud Compute Engine向け組織ポリシーのマネージド制約が一般提供開始

Google Cloud Compute Engineにおいて、組織ポリシーのマネージド制約機能が一般提供(GA)されました。これにより、組織全体のCompute Engineリソース構成を統一的に管理・強制することが可能になります。本機能は、コンプライアンス遵守やセキュリティ強化、運用効率の向上に貢献します。これまでプレビュー版で提供されていた機能が正式リリースされ、より多くのユーザーが利用できるようになりました。

Google Cloud Compute Engineの組織ポリシーにおけるマネージド制約がGAとなり、組織全体のリソース構成管理とセキュリティ強化が容易になりました。

2026-03-11