本日のニュース総括(31件)

本日のニュース総括(31件)

📊 今日の総括

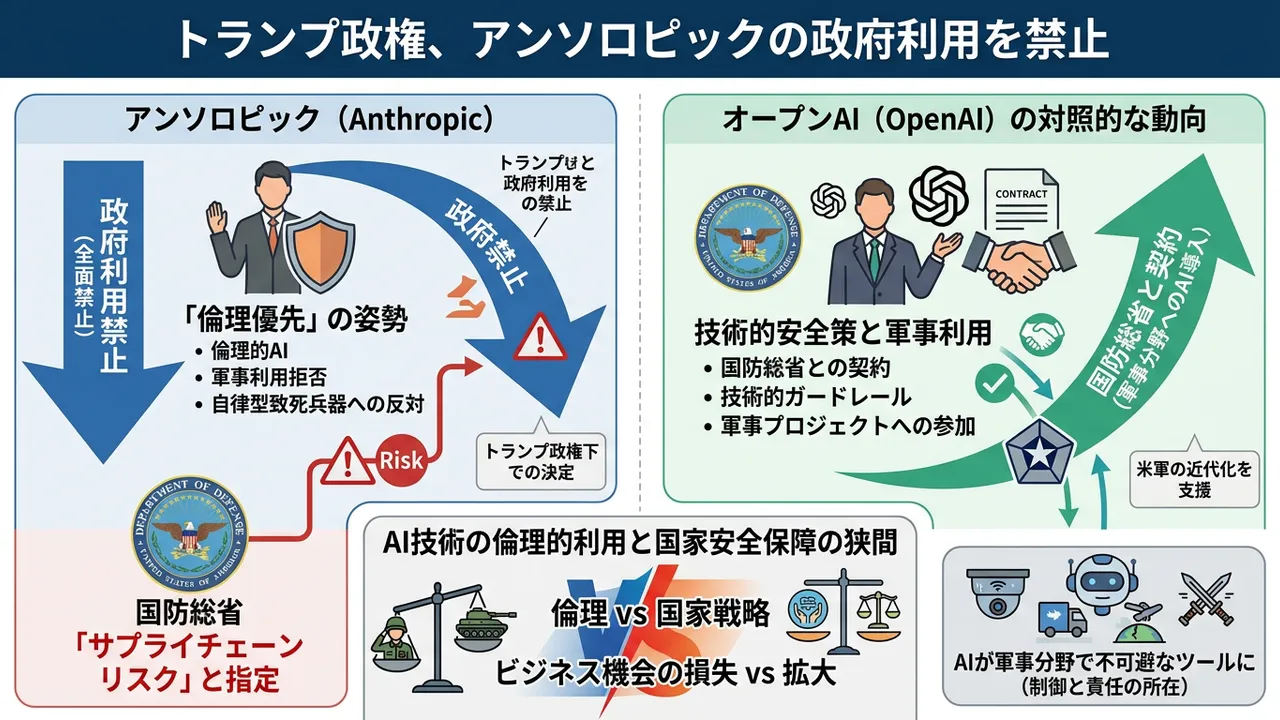

今日のテックニュースは、AI業界を巡る政治的・倫理的な緊張が顕著でした。特に、主要AI企業AnthropicとOpenAIが米国政府、特に国防総省との関係において異なるアプローチを示し、その動向が注目されています。Anthropicが軍事利用に関する厳しい安全指針を巡って政府から「サプライチェーンリスク」と指定され、政府機関での使用禁止という異例の事態に直面する一方、OpenAIは国防総省との契約締結を発表し、技術的安全策を強調しました。これらの動きは、AIの倫理的開発と国家安全保障のバランスという、現代社会における最も重要な課題の一つを浮き彫りにしています。同時に、エンジニアにとって実務に直結するAI活用のヒントも提供されています。

🔍 ピックアップ

【1】AI企業と米国防総省の軍事利用を巡る対立とOpenAIの動向

■ 何が変わるか

Anthropicは米国防総省によって「サプライチェーンリスク」と指定され、トランプ政権下では政府機関での利用が全面的に禁止される可能性があります。これは、AnthropicがAIの軍事利用、特に自律型致死兵器への関与に厳しい姿勢を示しているためです。対照的に、OpenAIは国防総省との契約を発表し、技術的安全策を講じることで軍事分野へのAI導入を進めると表明しており、二社のスタンスが明確に分かれました。

■ なぜ重要か

この対立は、AI技術の倫理的利用と国家安全保障の狭間で揺れるAI開発の最前線を示しています。Anthropicの「倫理優先」の姿勢が政府利用禁止という形で報われたことは、技術の倫理的側面を巡る議論が単なる理想論ではなく、具体的なビジネス機会や国家戦略にまで影響を及ぼすことを明確に示しました。OpenAIの国防総省との連携は、AIが軍事分野で不可避なツールとなりつつある現実を浮き彫りにし、その制御と責任の所在について改めて問いを投げかけています。

■ あなたへの影響

AI倫理や利用ガイドラインが、プロジェクトの採用技術や投資判断に直接影響を与える可能性が高まります。企業がAIツールを選定する際、その開発企業の倫理的スタンスや政府との関係性も考慮に入れる必要が出てくるかもしれません。また、AI技術の軍事転用に関する議論は、AI開発者自身が向き合うべき倫理的課題として、今後のキャリアパスや研究テーマにも影響を与える可能性があります。

■ アクション

AIツールの導入を検討する際は、そのベンダーの倫理ガイドラインや政府との連携方針を確認し、自社のポリシーと整合するかを検討しましょう。AIの安全保障利用に関する最新の動向を定期的にチェックし、技術者として倫理的議論に参加する意識を持つことが重要です。OpenAIやAnthropicが提供するAPIやモデルの利用規約において、軍事利用に関する条項がどのように規定されているかを再確認することも有益です。

■ 元記事

🔗 トランプ政権がアンソロピックの政府利用を全面禁止、国防総省は「サプライチェーンリスク」に指定 - Forbes JAPAN

【2】AnthropicのAI安全性ポリシーと市場への意外な影響

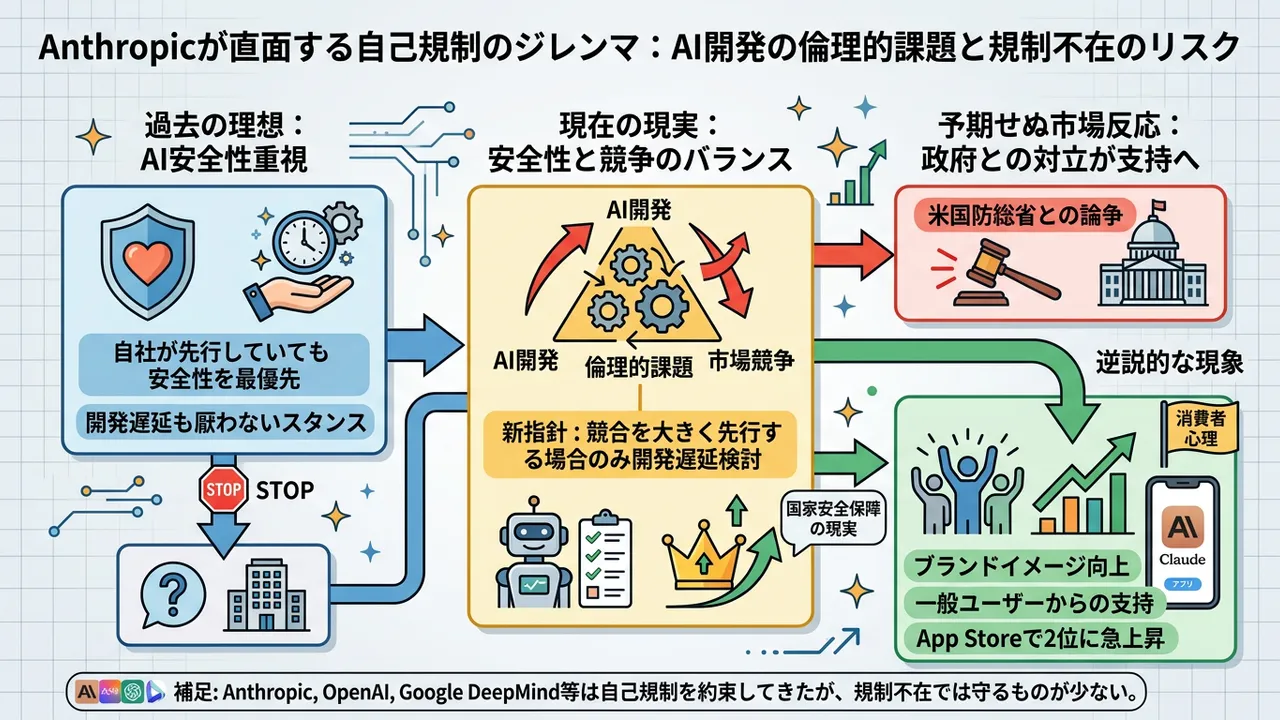

■ 何が変わるか

Anthropicは、フロンティアAI開発の安全指針を改定し、「自社が競合を大きく先行する場合のみ開発遅延を検討する」という現実的な方針を打ち出しました。これは、以前の「安全性を最優先」という理想主義的なスタンスからの変化を示唆しています。一方で、米国防総省との論争後、同社のAIアシスタント「Claude」がApp Storeで2位に急上昇するなど、世間の関心と支持を集める結果となりました。

■ なぜ重要か

AI企業の倫理的理想と、激化する市場競争や国家安全保障の現実との間で、どのようにバランスを取るべきかというジレンマが浮き彫りになっています。Anthropicの改定された安全指針は、AIの安全性と開発競争の速度という二律背反する目標を両立させる難しさを示しています。また、政府との対立が、かえって同社のブランドイメージを高め、一般ユーザーからの支持を得るという予想外の結果につながったことは、AI倫理が消費者心理に与える影響の大きさを物語っています。

■ あなたへの影響

AIモデル選定において、その開発企業の安全性に関するコミットメントと、それが市場競争の中でどのように変化していくかを見極める必要があります。また、倫理的な課題や政府との関係性が、製品のブランド力や普及に影響を与える事例として、今後のAIサービス開発のマーケティング戦略や広報活動の参考になるでしょう。ユーザーからの支持は、必ずしも技術的な優位性だけでなく、企業の姿勢に共感するかどうかにかかっていることを示唆しています。

■ アクション

Anthropicのような企業が安全指針をどのように進化させていくか、その発表に注目し、AI開発の最前線における倫理と実益のバランスについて学びを深めましょう。新規AIサービスのローンチや既存サービスの改善において、技術的な優位性だけでなく、ユーザーが共感する倫理的アピールポイントを検討する良い機会です。AI規制に関する議論が今後も活発化する中で、AI企業の自己規制の限界と可能性について洞察を深め、自身の開発するシステムへの応用を考察しましょう。

■ 元記事

【3】AWSとClaudeを活用した実用的なAI開発テクニック

■ 何が変わるか

AIアシスタント「Claude」を活用して、効果的な学習スタイルを実践する方法や、構成図を生成する新たなアプローチが紹介されました。特に「Excalidraw MCPでClaude Codeに描かせる、親しみやすい構成図作成術」では、自然言語で指示するだけでClaudeがコードを生成し、それを視覚的な図に変換する具体的な手法が示されており、開発者のワークフローが大きく効率化される可能性を秘めています。

■ なぜ重要か

これまで手動で行っていた設計図作成や学習計画の策定といった、時間がかかりがちなタスクにAIを導入することで、開発者はより創造的で価値の高い業務に集中できるようになります。Claudeのような強力なAIを単なるチャットボットとしてではなく、プログラミングや設計の強力なアシスタントとして活用する具体的なユースケースが広がることは、開発現場の生産性向上に直結します。これは、AIがエンジニアの仕事を奪うのではなく、増幅させる存在であることを示す好例です。

■ あなたへの影響

開発初期段階での設計やドキュメント作成の負担を大幅に軽減できる可能性があります。Claudeを利用してプロトタイプコードや構成図の素案を迅速に生成し、その後の手作業による調整に集中することで、開発速度を向上させることが期待できます。新しい技術やフレームワークを学ぶ際にも、Claudeを個人教師のように活用することで、理解を深め、実践的なスキルを効率良く習得できるようになります。既存のワークフローにAIアシスタントを組み込むことで、チーム全体の生産性向上や標準化に貢献できるチャンスが生まれます。

■ アクション

まずは、自身が日頃行っているドキュメント作成やコーディングの定型的なタスクで、Claudeに代行できる部分がないか検討してみましょう。紹介された「Excalidraw MCPでClaude Codeに描かせる」手法を実際に試し、その効果を体験してください。ClaudeをはじめとするAIアシスタントを、学習や情報収集のパートナーとして積極的に活用し、自身のスキルアップに繋げましょう。

■ 元記事

内訳:

注目記事

トランプ政権がアンソロピックの政府利用を全面禁止、国防総省は「サプライチェーンリスク」に指定 - Forbes JAPAN

2026-03-01

OpenAIのサム・アルトマンCEO、国防総省との契約に「技術的安全策」を導入したと発表

OpenAIのCEOであるサム・アルトマン氏が、米国国防総省との新たな契約について発表しました。この契約には、Anthropic社との交渉で問題となった同様の懸念に対処するための「技術的安全策」が含まれていると主張しています。この安全策の具体的な内容は不明ですが、AIの軍事利用における倫理的・安全保障上の課題に対するOpenAIの取り組みを示唆しています。これにより、OpenAIは国防総省との連携を強化しつつ、AIの安全性を確保しようとしています。

OpenAIが国防総省との契約に「技術的安全策」を導入したと発表し、AIの軍事利用における安全性と倫理的懸念への対応を強化しています。

2026-03-01

OpenAIのサム・アルトマンCEO、国防総省との契約に「技術的安全策」を導入したと発表

OpenAIのCEOであるサム・アルトマン氏が、米国国防総省との新たな契約について発表しました。この契約には、Anthropic社との交渉で問題となった同様の懸念に対処するための「技術的安全策」が含まれていると主張しています。この安全策の具体的な内容は不明ですが、AIの軍事利用における倫理的・安全保障上の課題に対するOpenAIの取り組みを示唆しています。これにより、OpenAIは国防総省との連携を強化しつつ、AIの安全性を確保しようとしています。

OpenAIが国防総省との契約に「技術的安全策」を導入したと発表し、AIの軍事利用における安全性と倫理的懸念への対応を強化しています。

2026-03-01

記事一覧

31件

絞り込み

カテゴリー

タグ

AI企業Anthropic、軍事利用の「自律型致死兵器」開発への関与を巡る国防総省との交渉

AI企業Anthropicは、米国国防総省から、自社技術の軍事利用(監視や自律型致死兵器への応用を含む)について、制限のないアクセスを要求されています。この要求は、Anthropicが「サプライチェーンリスク」とみなされ、巨額の契約を失う可能性を示唆しています。業界全体で、企業がどのような未来を支援しているのか、技術者たちは自社の政府・軍事契約を見直しています。国防総省は、AIの倫理的ガードレール撤廃を求めてAnthropicと交渉を重ねています。

Anthropicが国防総省の要求により、AIの軍事利用(自律型致死兵器への応用)における倫理的ガードレール撤廃の岐路に立たされている。

2026-03-01

AI vs. the Pentagon: killer robots, mass surveillance, and red lines

2026-03-01

Trump orders federal agencies to drop Anthropic’s AI

2026-03-01

Defense secretary Pete Hegseth designates Anthropic a supply chain risk

2026-03-01

画像なし

Our agreement with the Department of War

2026-03-01

Unreal Engine 5プロジェクトをGit LFSで管理する実践ガイド

本記事は、大規模なアセットを扱うUnreal Engine 5プロジェクトにおいて、Git Large File Storage (LFS) を使用してバージョン管理を行う方法について解説しています。Git LFSは、バイナリファイルなどの巨大なファイルを効率的に管理するためのソリューションであり、UE5プロジェクトのようなリソース集約型の開発環境で特に有効です。記事では、具体的な導入手順や運用上の注意点を含め、プロジェクトのバージョン管理をスムーズに行うための実践的なノウハウを提供しています。

Git LFSをUnreal Engine 5プロジェクトで活用することで、巨大なアセットファイルのバージョン管理を効率化できる。

2026-03-01

「セクションをまたぐコピー」をSelectionとRange APIで実現する実装手法

本記事では、テキスト編集やドキュメント操作において、異なるセクションをまたぐコピー操作をどのように実現するかについて、SelectionとRangeというAPIを用いて具体的な実装方法を解説しています。これらのAPIを駆使することで、ユーザーが直感的に行いたいコピー&ペースト操作を、プログラム側で正確に処理できるようになります。高度なテキスト操作やドキュメント編集機能を持つアプリケーション開発において、重要な技術的アプローチを示す内容となっています。

SelectionとRange APIを活用することで、プログラム上で「セクションをまたぐコピー」という複雑な操作を正確に実現できる。

2026-03-01

AWSリソースのメンテナンスウィンドウ設定:開始時間のみが対象であり、終了時間までを保証しない注意点

本記事は、RDSやFSxなどのAWSリソースで設定されるメンテナンスウィンドウの性質について解説しています。メンテナンスウィンドウは、あくまでメンテナンスが「開始される」時間枠を指定するものであり、メンテナンスの「終了」までを保証するものではないことを強調しています。この性質を理解せずに、IO負荷の高い処理やミッションクリティカルな処理の直前にメンテナンスウィンドウを設定してしまうと、予期せぬ影響を受けるリスクがあることを指摘しています。運用管理者は、この点を考慮して、より安全なメンテナンス計画を立案する必要があります。

AWSリソースのメンテナンスウィンドウは開始時間のみ指定され、終了時間までは含まれないため、高負荷処理との競合に注意が必要。

2026-03-01

FSx for Windows File Serverにおけるストレージ最適化中のスループット変更可能性の検証

本記事では、Amazon FSx for Windows File Serverにおいて、ストレージ最適化処理の実行中にスループット設定を変更できるかどうかを検証した結果を報告しています。通常、最適化中は変更が制限されることが多いですが、その挙動を詳細に調査しています。検証を通じて、特定の条件下でのスループット変更の可否や、それに伴う影響について具体的な洞察を提供しています。これにより、FSx for Windows File Serverの運用管理者は、より柔軟なリソース管理戦略を立てることが可能になります。

FSx for Windows File Serverのストレージ最適化中にスループット設定を変更できるかどうかの実証検証結果を提示。

2026-03-01

Excalidraw MCPでClaude Codeに描かせる、親しみやすい構成図作成術

本記事では、Excalidraw MCPというツールを活用し、AIコーディングアシスタントであるClaude Codeに、親しみやすく視覚的な構成図を描かせる方法を紹介しています。Claude Codeのコード生成能力を、図解作成という新たな領域に応用する試みです。これにより、複雑なシステム構成を直感的に理解しやすい形で可視化することが可能になります。技術文書やプレゼンテーション資料作成において、開発効率と理解度向上に貢献する手法として注目されます。

Excalidraw MCPとClaude Codeを連携させることで、AIによる直感的で分かりやすい構成図の自動生成が可能になる。

2026-03-01

【2026年版】AWS Step FunctionsとAmazon Rekognitionによるローコード画像分類ワークフロー構築ガイド

本記事は、AWS Step FunctionsとAmazon Rekognitionを活用して、ローコードで画像分類ワークフローを構築するハンズオンチュートリアルです。AWSの各種サービスをStep Functionsで連携させることで、複雑な処理も低コードで実現可能であることを示しています。具体的には、犬と猫の画像を例に、画像認識から分類までのワークフローを構築する手順を解説しています。これにより、開発者は効率的に画像処理パイプラインを設計・実装できるようになります。

AWS Step FunctionsとAmazon Rekognitionを組み合わせることで、ローコードで強力な画像分類ワークフローを容易に構築できる。

2026-03-01

RHUIアクセス不可環境下で特定のパッケージのみをインストールする手法

本記事では、Red Hat Update Infrastructure (RHUI) にアクセスできない環境において、特定のパッケージのみを選択的にインストールする方法を解説しています。通常、パッケージのインストールやアップデートはRHUIを介して行われますが、ネットワーク制限などの理由でアクセスできない場合があります。この記事では、代替手段として、必要なパッケージとその依存関係を手動で取得・管理する具体的な手順や注意点を示しています。システム管理者が直面する可能性のある、制約の多い環境でのソフトウェア管理に役立つ情報を提供します。

RHUIにアクセスできない制約下でも、特定のパッケージとその依存関係を特定し、手動でインストールする実践的な方法を解説しています。

2026-03-01

OpenAIのサム・アルトマンCEO、国防総省との契約に「技術的安全策」を導入したと発表

OpenAIのCEOであるサム・アルトマン氏が、米国国防総省との新たな契約について発表しました。この契約には、Anthropic社との交渉で問題となった同様の懸念に対処するための「技術的安全策」が含まれていると主張しています。この安全策の具体的な内容は不明ですが、AIの軍事利用における倫理的・安全保障上の課題に対するOpenAIの取り組みを示唆しています。これにより、OpenAIは国防総省との連携を強化しつつ、AIの安全性を確保しようとしています。

OpenAIが国防総省との契約に「技術的安全策」を導入したと発表し、AIの軍事利用における安全性と倫理的懸念への対応を強化しています。

2026-03-01

OpenAIのサム・アルトマンCEO、国防総省との契約に「技術的安全策」を導入したと発表

OpenAIのCEOであるサム・アルトマン氏が、米国国防総省との新たな契約について発表しました。この契約には、Anthropic社との交渉で問題となった同様の懸念に対処するための「技術的安全策」が含まれていると主張しています。この安全策の具体的な内容は不明ですが、AIの軍事利用における倫理的・安全保障上の課題に対するOpenAIの取り組みを示唆しています。これにより、OpenAIは国防総省との連携を強化しつつ、AIの安全性を確保しようとしています。

OpenAIが国防総省との契約に「技術的安全策」を導入したと発表し、AIの軍事利用における安全性と倫理的懸念への対応を強化しています。

2026-03-01

トランプ政権がアンソロピックを安保リスク指定、OpenAIは国防総省と合意 - tech-noisy.com

2026-03-01

米国、AI企業Anthropicに「国防生産法」を適用し、制御下に置く

米国政府が、AI企業Anthropicに対し「国防生産法(Defense Production Act)」を適用したという記事です。これは、AIの安全性や国家安全保障上のリスクを懸念した政府が、AnthropicのAI開発・運用に介入し、制御下に置こうとする試みと見られます。AI企業が政府の国家安全保障政策の対象となる事例として注目されており、AIの規制と開発のバランスに関する議論を深めるものです。この措置は、AIスタートアップが直面する政治的・規制的課題の重大さを示しています。

米国政府が「国防生産法」を発動し、AI企業Anthropicを国家安全保障上のリスクとみなし、そのAI開発・運用を制御下に置こうとしています。

2026-03-01

EC2上でOpenClawとBedrockを利用し、Kiro CLIをエージェントとして動作させる方法

本記事は、Amazon EC2インスタンス上にOpenClawの評価環境を構築し、Amazon Bedrock経由でKiro CLIをエージェントとして動作させる手順を解説したチュートリアルです。CloudFormationテンプレートを用いることで、環境構築が容易に行えることを示しています。CLIおよびWeb UIからの動作確認結果もまとめられており、開発者が実際にKiro CLIをエージェントとして活用するための実践的なガイドとなっています。AIエージェントのローカル環境での実行に関心のある読者にとって有用です。

EC2、OpenClaw、Bedrockを連携させ、Kiro CLIをAIエージェントとして容易にデプロイ・実行できる環境構築手法を解説しています。

2026-03-01

AIブームを支える数十億ドル規模のインフラ投資:主要プレイヤーとその戦略

この記事では、AIブームを牽引する数十億ドル規模のインフラ投資に焦点を当てています。Meta、Oracle、Microsoft、Google、OpenAIといった主要企業が、データセンターやAIチップなどの分野で巨額の投資を行っている実態を解説しています。これらの投資は、AIモデルの開発・運用に不可欠な計算能力とストレージ能力を確保するための戦略的な動きです。AI技術の進化と普及を支える基盤インフラの重要性が浮き彫りになっています。

AIブームの裏側で、主要テック企業がデータセンターやAIチップに数十億ドル規模のインフラ投資を行い、AIの計算能力を爆発的に増強しています。

2026-03-01

国防総省との論争後、AnthropicのClaudeがApp Storeで2位に急上昇

Anthropic社のチャットボットClaudeが、米国国防総省との交渉を巡る注目の高まりを受けて、App Storeのランキングで2位に急上昇したことが報じられています。この出来事は、公的な注目が消費者へのリーチやサービス利用に直接影響を与える可能性を示唆しています。契約交渉の混乱が、皮肉にも同社のAI製品への関心を高める結果となったようです。この急上昇は、AI企業のPR戦略や一般への認知度向上において、予期せぬ要因が影響することを示しています。

国防総省との論争が注目を集めた結果、AnthropicのAIチャットボットClaudeがApp Storeで驚異的な人気を獲得し、ランキング2位に浮上しました。

2026-03-01

Anthropic、「運命の24時間」を巡る一連の出来事を詳細解説

この記事は、AI企業Anthropicが直面した「運命の24時間」と称される一連の出来事を詳細に振り返っています。国防総省との交渉における緊張、OpenAIとの関係、そしてそれらがAnthropicの事業やAI業界全体に与えた影響について掘り下げています。この出来事は、AIスタートアップが直面する規制や政府との関係構築の難しさを示唆しています。Anthropicの今後の戦略やAI倫理に関する議論に焦点が当てられています。

Anthropicが国防総省との交渉で直面した一連の危機的状況を分析し、AIスタートアップの政府との関係構築の難しさとその影響を明らかにしています。

2026-03-01

OpenAI、米国防総省とAI導入で合意し、Anthropicへの懸念沈静化を要請

OpenAIが米国防総省とAI導入に関する合意に至ったことが報じられています。この合意は、Anthropic社に対する強硬措置の沈静化を求める動きと関連している可能性があります。詳細な条件やAIの具体的な用途については不明な点も多いですが、両者の連携強化が示唆されています。この動きは、AI技術の軍事利用における倫理的・政治的側面を浮き彫りにするものです。

OpenAIが米国防総省とAI導入で合意し、Anthropicへの強硬措置緩和を求めたことで、AIの軍事利用における地政学的な動きが加速しました。

2026-03-01

![[アップデート] Amazon Cognito ユーザープールでカスタムシークレットとローテーションがサポートされ、アプリケーションクライアントのセキュリティが強化](https://images.ctfassets.net/ct0aopd36mqt/wp-thumbnail-a818da17018141da489a79231ff888af/262f4f06026559b98b1fdec52f1a2176/amazon-cognito)

[アップデート] Amazon Cognito ユーザープールでカスタムシークレットとローテーションがサポートされ、アプリケーションクライアントのセキュリティが強化

Amazon Cognito ユーザープールにおいて、アプリケーションクライアントのシークレット管理に関する重要なアップデートが行われました。新たにカスタムシークレットとシークレットローテーション機能がサポートされ、セキュリティが大幅に強化されました。これにより、ユーザー認証におけるセキュリティリスクを低減し、より安全なアプリケーション開発が可能になります。本アップデートは、既存のCognitoユーザープールの運用者にとって重要な情報です。

Amazon Cognitoがアプリケーションクライアントシークレットのカスタム化とローテーションをサポートしたことで、ユーザー認証のセキュリティが大幅に向上した。

2026-03-01

米国防長官、Anthropicを「サプライチェーンリスク」に指定、同社は法廷闘争を宣言し対立深刻化

米国防長官は、AI企業Anthropicを「サプライチェーンリスク」に指定する方針を明らかにしました。これに対し、Anthropicは法廷闘争も辞さないと表明しており、両者の対立は一層深刻化しています。この一件は、AI技術の安全性、政府による調達、そして国際的な安全保障におけるAIの役割について、重要な議論を提起しています。AI企業と政府機関との間の法的・政策的な駆け引きが注目されます。

米国防長官がAnthropicを「サプライチェーンリスク」と指定し、同社が法廷闘争を宣言したことは、AIの政府利用における安全保障上の懸念と法的対立の激化を示唆する。

2026-03-01

Anthropicとトランプ政権の全面対立:「AIの安全装置」を巡る攻防とその影響

AI企業Anthropicとトランプ政権との間で、AIの利用と規制を巡る全面対立が発生しています。この対立は、「AIの安全装置」とも言える倫理的・技術的なガードレールを維持するか否かという根源的な問題を提起しています。政権による利用禁止措置は、AI開発における安全保障上の懸念と、政治的影響力の行使という複雑な様相を呈しており、社会全体に大きな波紋を広げています。

Anthropicとトランプ政権の全面対立は、AIの安全基準と政府の規制要求との間の緊張関係を示し、AI開発の方向性に重大な影響を与える。

2026-03-01

OpenAI、国防省との契約で「越えない一線」を越えたとして批判、ChatGPT解約運動も勃発

OpenAIが米国防総省との契約を締結したことで、一部のユーザーから「越えない一線」を越えたとして強い反発が起きています。この契約は、AIの倫理的な利用や、軍事分野への応用に関する議論を再燃させており、ChatGPTの利用停止を求める運動にも繋がっています。OpenAIが掲げるAIの安全性や倫理観と、実際の事業展開との乖離が指摘されています。

OpenAIが米国防総省と契約したことは、AIの倫理的利用に関するコミュニティの強い反発を招き、AI開発企業が直面する倫理的ジレンマを浮き彫りにした。

2026-03-01

米国防総省がAnthropicをサプライチェーンリスクに指定、法廷闘争に発展か - ライブドアニュース

2026-03-01

Anthropic、フロンティアAI開発の安全指針を改定:自社が競合を大きく先行する場合のみ開発遅延を検討

AI開発企業Anthropicは、フロンティアAI開発に関する安全指針を見直しました。新たな指針では、自社が競合他社を大きくリードしている場合にのみ、開発の遅延を検討するとしています。競合が同水準の技術力を持つ場合には、開発を遅らせることなく進める方針です。この変更は、AI開発のスピードと安全性、そして市場競争とのバランスをどのように取るかという、業界全体の課題を反映しています。

AnthropicがフロンティアAI開発の安全指針を、自社の進捗状況のみを基準に改定したことは、AI開発競争と安全性の両立における企業の戦略的判断を示す。

2026-03-01

Anthropicが直面する自己規制のジレンマ:AI開発の倫理的課題と規制不在のリスク

Anthropicをはじめとする主要AI企業は、責任あるAI開発と自己規制を約束してきましたが、規制の不在が彼らを窮地に追いやっています。自社で設けた倫理的基準や安全策が、急速な技術進歩や競争環境の中で、かえって開発の足かせとなる可能性が指摘されています。本記事では、AI企業が抱える倫理的・事業的ジレンマと、外部からの規制がない状況下での脆弱性について論じています。

AI企業が掲げる自己規制という名の「罠」は、規制不在の現代において、むしろ企業を脆弱にし、責任あるAI開発の実現を阻害する可能性がある。

2026-03-01

Anthropicが直面する自己規制のジレンマ:AI開発の倫理的課題と規制不在のリスク

Anthropicをはじめとする主要AI企業は、責任あるAI開発と自己規制を約束してきましたが、規制の不在が彼らを窮地に追いやっています。自社で設けた倫理的基準や安全策が、急速な技術進歩や競争環境の中で、かえって開発の足かせとなる可能性が指摘されています。本記事では、AI企業が抱える倫理的・事業的ジレンマと、外部からの規制がない状況下での脆弱性について論じています。

AI企業が掲げる自己規制という名の「罠」は、規制不在の現代において、むしろ企業を脆弱にし、責任あるAI開発の実現を阻害する可能性がある。

2026-03-01

AIアシスタントClaudeを活用した効果的な学習スタイルの実践ガイド

本記事では、AIアシスタントClaudeの特性を活かし、学習内容の定着を促進する具体的な方法を解説しています。Claudeとの対話を通じて、理解度を深め、記憶を強化するためのプロンプトエンジニアリングのコツや、学習プロセスにおけるAIの活用法を紹介しています。これにより、ユーザーはより効率的かつ効果的な学習体験を得ることができます。

AIアシスタントClaudeの対話能力を活用することで、能動的かつ深い理解を伴う学習スタイルを確立できる。

2026-03-01

トランプ政権がアンソロピックの政府利用を全面禁止、国防総省は「サプライチェーンリスク」に指定 - Forbes JAPAN

2026-03-01