本日のニュース総括(18件)

本日のニュース総括(18件)

📊 今日の総括

今日のテックニュースは、AI分野における進化と課題、そしてクラウドインフラの最適化に焦点を当てています。AnthropicのClaude Sonnet 4.6発表は、LLMの推論能力と多言語対応のさらなる向上を示し、AIアプリケーションの可能性を広げました。一方で、Google VPからのAIスタートアップへの警告は、LLM市場における競争激化とビジネスモデルの変革を予感させます。また、AWS関連では、セキュリティを重視したAIモデルのデプロイ方法や、マルチアカウント環境構築のベストプラクティス、さらにはGravitonプロセッサの最新性能比較が注目を集めています。エンジニアはこれらの動向を理解し、自身の技術スタックやプロジェクト戦略にどのように活かすかを考えることが重要です。

🔍 ピックアップ

【1】Anthropic Claude Sonnet 4.6発表:新モデルの特徴、料金、活用事例

■ 何が変わるか

Anthropicが最新の言語モデル「Claude Sonnet 4.6」を発表しました。この新バージョンは、以前のモデルと比較して推論能力と多言語対応が大幅に向上しており、特に複雑な指示の理解やコード生成において精度が高まっています。料金体系も既存のClaudeモデルと同程度に設定されており、開発者はより高性能なAIをコスト効率良く利用できるようになります。具体的な利用事例として、カスタマーサポートの自動化やコンテンツ生成、データ分析支援などが挙げられており、多岐にわたるビジネスシーンでの活用が期待されます。

■ なぜ重要か

競合が激化するLLM市場において、Anthropicが提供するモデルの性能向上は、AIアプリケーション開発者にとって選択肢の幅を広げ、より高度な機能の実装を可能にします。特に、推論能力の強化は、ビジネスロジックへのAI組み込みやRAG(Retrieval Augmented Generation)における精度向上に直結し、実用的なAIソリューション構築の基盤となります。他社モデルとの比較検討を通じて、プロジェクトに最適なAIモデルを選定する上での重要な判断材料となります。

■ あなたへの影響

AIを利用したサービス開発に携わるエンジニアにとって、Claude Sonnet 4.6は強力なツールとなり得ます。既存のアプリケーションの精度向上や、新たなAI機能の企画・実装において、このモデルの能力を最大限に活用する方法を検討する価値があります。特に、多言語対応の強化はグローバル展開を視野に入れたサービス開発において有利に働くでしょう。APIの利用方法やモデルの特性を理解し、現在のシステムへの統合可能性を評価することが求められます。

■ アクション

Anthropicの公式ドキュメントでClaude Sonnet 4.6の詳細な仕様とAPIリファレンスを確認し、提供されているSDKやライブラリを用いてプロトタイピングを開始しましょう。特に、自社のユースケースにおけるモデルの性能評価(例えば、特定のタスクでの精度や応答速度)を行うことで、導入の是非を判断できます。競合モデルとの比較ベンチマークを実施することも有効です。

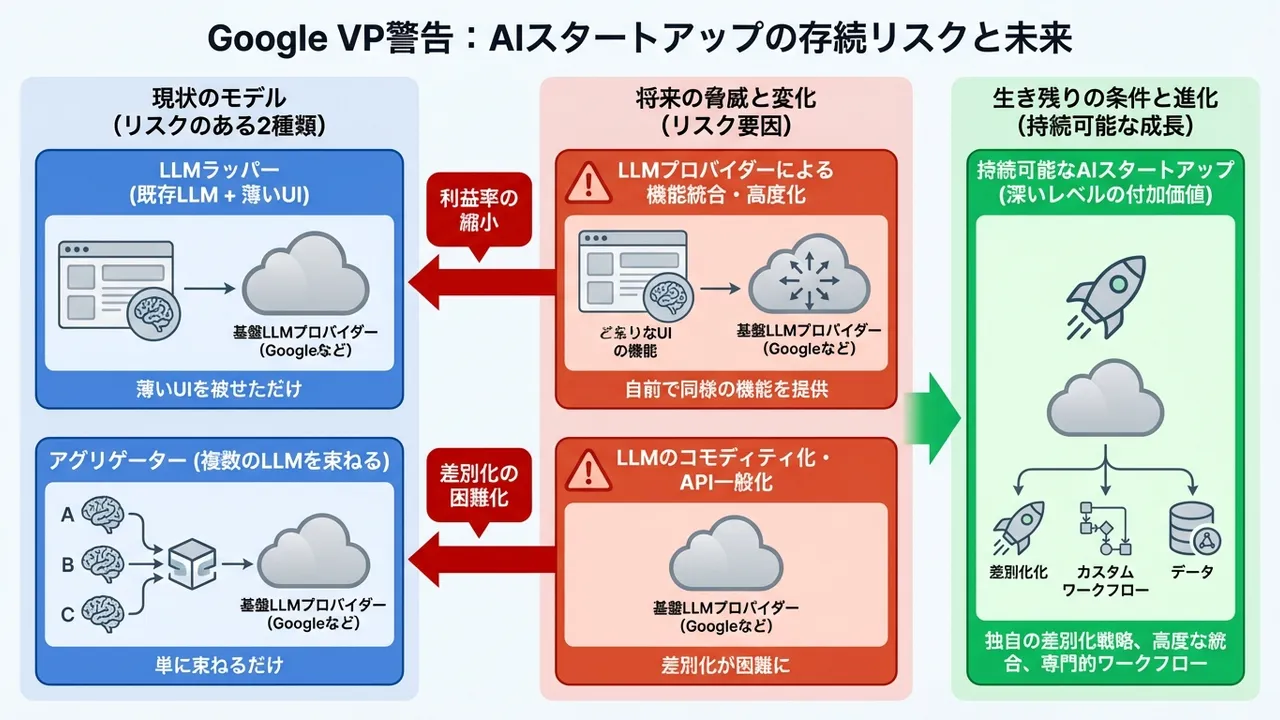

【2】Google VP、AIスタートアップの存続リスクについて警告:LLMラッパーとアグリゲーターに影響

■ 何が変わるか

Googleの副社長が、AIスタートアップの中でも特に「LLMラッパー(既存のLLMに薄いUIを被せただけのサービス)」と「アグリゲーター(複数のLLMを単に束ねるだけのサービス)」の2種類のビジネスモデルが、将来的に存続が危うくなる可能性があると警告しました。これは、基盤となるLLMプロバイダー自身が同様の機能やより高度な機能を提供し始めること、またはLLMのコモディティ化によって差別化が困難になることが背景にあります。単なる「ラッパー」や「アグリゲーター」では、深層的な価値提供や技術的優位性を確立するのが難しいという見解を示唆しています。

■ なぜ重要か

この警告は、AI業界のビジネスモデルの成熟と進化を示唆しています。LLMがますます高性能化し、APIとして手軽に利用できるようになるにつれて、その上に構築されるアプリケーションは、単なるAPIの呼び出し以上の付加価値を提供することが求められるようになります。スタートアップが持続可能な成長を遂げるためには、特定の業界知識との融合、独自のデータセットによるファインチューニング、あるいは革新的なユーザーエクスペリエンスの提供など、より深いレベルでの差別化戦略が不可欠であることを示しています。

■ あなたへの影響

AIスタートアップに所属しているエンジニアや、将来的にAI関連の事業を立ち上げようと考えている方にとって、この視点は極めて重要です。単に既存のLLMを利用するだけでなく、顧客の真の課題を解決するための独自のドメイン知識や技術的工夫を凝らしたソリューション開発に注力する必要があることを示唆しています。プラットフォームとしてのLLMが進化する中で、その上にいかに「厚い層」の価値を構築できるかが、成功の鍵となります。

■ アクション

現在のAIプロジェクトやビジネスモデルが、単なるLLMラッパーやアグリゲーターに該当しないか再評価しましょう。もし該当する場合、独自のデータ、専門知識、または革新的なインタラクションを通じて、どのように深層的な価値を提供できるかを検討してください。既存のLLMの進化動向を注視し、それらを活用しつつも、コアとなる競争優位性を確立するための戦略を練り直すことが推奨されます。

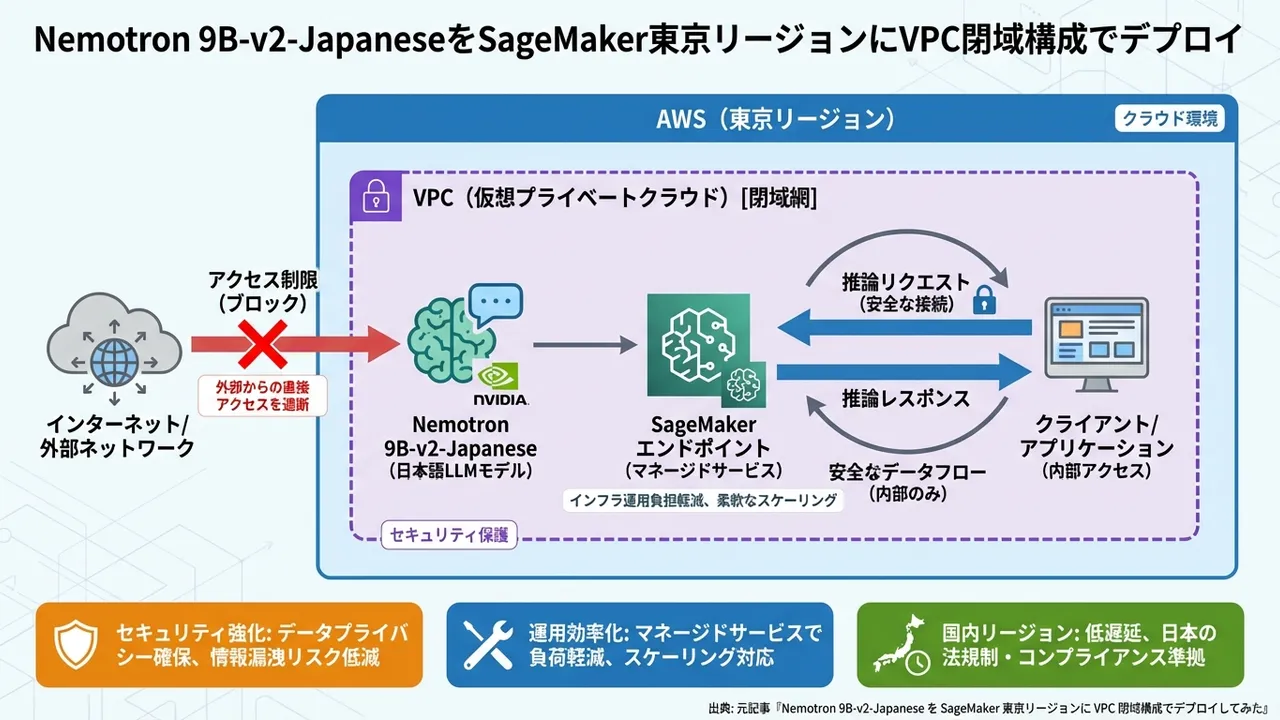

【3】Nemotron 9B-v2-JapaneseをSageMaker東京リージョンにVPC閉域構成でデプロイ

■ 何が変わるか

NVIDIAの日本語対応大規模言語モデル「Nemotron 9B-v2-Japanese」を、AWS SageMakerの東京リージョンに、VPCの閉域網内でデプロイする具体的な手順が公開されました。これにより、外部ネットワークからのアクセスを制限し、セキュリティとデータプライバシーを確保した上で、高性能な日本語LLMをAWS上で利用できるようになります。また、SageMakerのマネージドサービスを活用することで、インフラ運用負担を軽減しつつ、柔軟なスケーリングが可能となります。この実装は、金融機関や医療機関など、特に厳格なセキュリティ要件を持つ企業にとって大きなメリットをもたらします。

■ なぜ重要か

企業がAIモデルを本番環境で運用する際、セキュリティとコンプライアンスは最重要課題の一つです。VPC閉域構成でのデプロイは、機密性の高いデータを扱うAIアプリケーションにおいて、情報漏洩のリスクを大幅に低減します。また、日本語特化モデルを国内のリージョンで利用できることは、レイテンシの改善だけでなく、日本の法規制や文化に即したAIサービスを構築する上で不可欠です。SageMakerの活用は、モデルのデプロイから運用、スケーリングまでを一元的に管理できるため、開発・運用コストの最適化にも繋がります。

■ あなたへの影響

MLエンジニアやインフラエンジニアにとって、このデプロイ方法は、セキュアなAI基盤構築のための実践的な知識となります。特に、顧客データや社内機密情報を扱うAIプロジェクトでは、VPC内でのモデルデプロイが必須となるケースが多いため、この手順を習得することは、より多くのプロジェクトに対応できるようになることを意味します。SageMakerの機能を深く理解し、閉域網環境でのAIモデル運用ノウハウを身につけることは、自身の市場価値を高めるでしょう。

■ アクション

記事のデプロイガイドを参考に、Nemotron 9B-v2-JapaneseをAWS SageMaker上に実際に構築してみましょう。この際、VPC設定、セキュリティグループ、IAMロールといったAWSの基本的なセキュリティ・ネットワーク設定を再確認し、閉域網での通信が正しく行われることを検証してください。可能であれば、自社の機密データの一部(もちろん匿名化されたもの)を用いて、モデルの応答精度や推論速度を評価し、実運用への適用可能性を探ることをお勧めします。

■ 元記事 🔗 Nemotron 9B-v2-JapaneseをSageMaker東京リージョンにVPC閉域構成でデプロイ

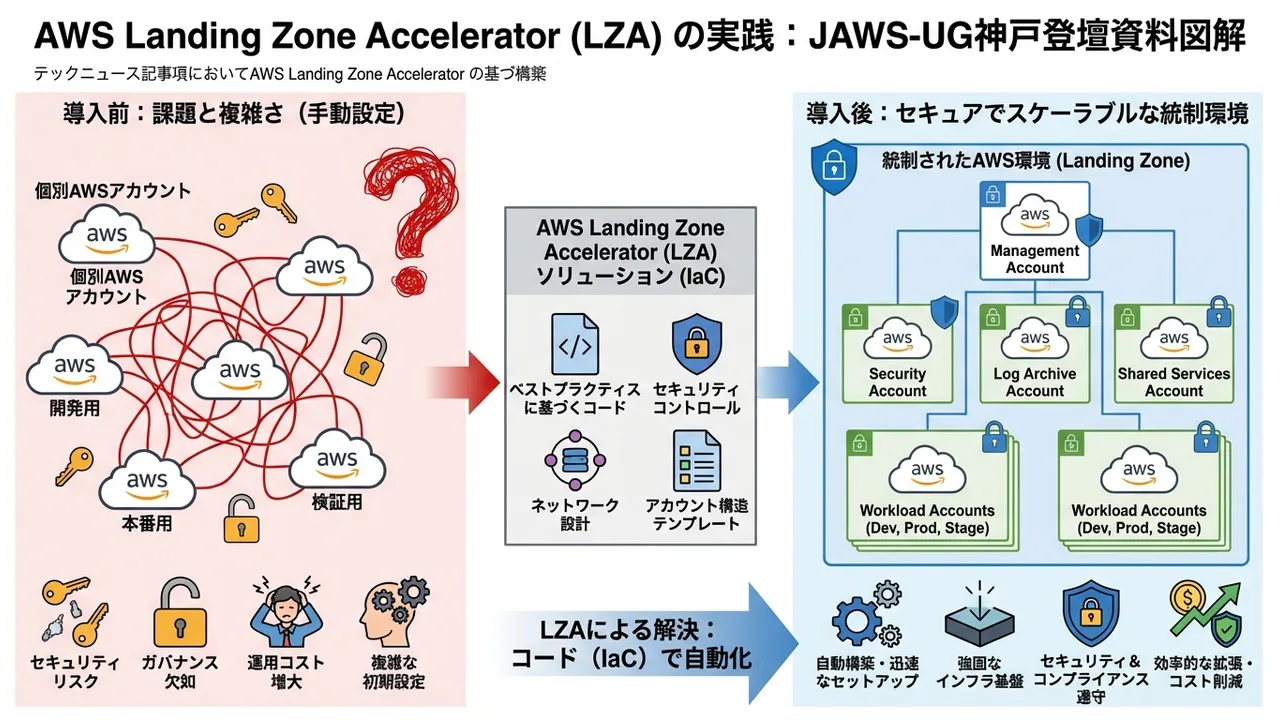

【4】JAWS-UG神戸での登壇資料:AWS Landing Zone Accelerator (LZA) の実践

■ 何が変わるか

AWS Landing Zone Accelerator (LZA) は、複数アカウントを持つAWS環境をセキュアかつスケーラブルに、そしてガバナンスを効かせながら構築するためのソリューションです。提供された資料では、LZAの導入から運用までの実践的なアプローチが解説されており、ベストプラクティスに基づいたアカウント構造、セキュリティコントロール、ネットワーク設計などが具体的に示されています。これにより、手動での設定に比べて、より迅速かつ確実に、大規模なAWS環境の初期セットアップを行うことが可能になります。

■ なぜ重要か

多くの企業がAWSのマルチアカウント戦略を採用する中で、初期設定の複雑さやガバナンスの維持は大きな課題です。LZAは、AWSが推奨する統制の取れた環境をコード(IaC)として提供するため、セキュリティやコンプライアンス要件を満たしながら、効率的にクラウド環境を構築・拡張できます。これにより、個々のアカウントが独立して設定されることによるセキュリティリスクや運用コストの増大を防ぎ、全体として統制の取れた安定したインフラ基盤を確立することが可能になります。

■ あなたへの影響

クラウドインフラ設計者やSRE、セキュリティエンジニアにとって、LZAはマルチアカウント環境の標準化と自動化を進める上で不可欠なツールです。特に、新規プロジェクトの立ち上げや既存環境の改善において、LZAの導入はセキュリティ体制の強化と運用効率の大幅な向上をもたらします。資料を通じて、LZAのコンポーネント、設定、そして実際のデプロイプロセスを理解することは、企業のクラウド戦略をリードする上で強力な武器となるでしょう。

■ アクション

まず、公開された資料を熟読し、LZAが提供する機能とそれが解決する課題を深く理解してください。次に、AWS OrganizationsとControl Towerの基本的な知識を確認し、LZAがそれらとどのように連携するかを把握しましょう。可能であれば、テスト環境でLZAのクイックスタートを試すか、TerraformなどのIaCツールとLZAの連携方法を検証し、自身のプロジェクトへの適用可能性を探ってみることを推奨します。

■ 元記事 🔗 JAWS-UG神戸での登壇資料:AWS Landing Zone Accelerator (LZA) の実践 (https://dev.classmethod.jp/articles/jaws-ug-kobe-lza-on-aws/)

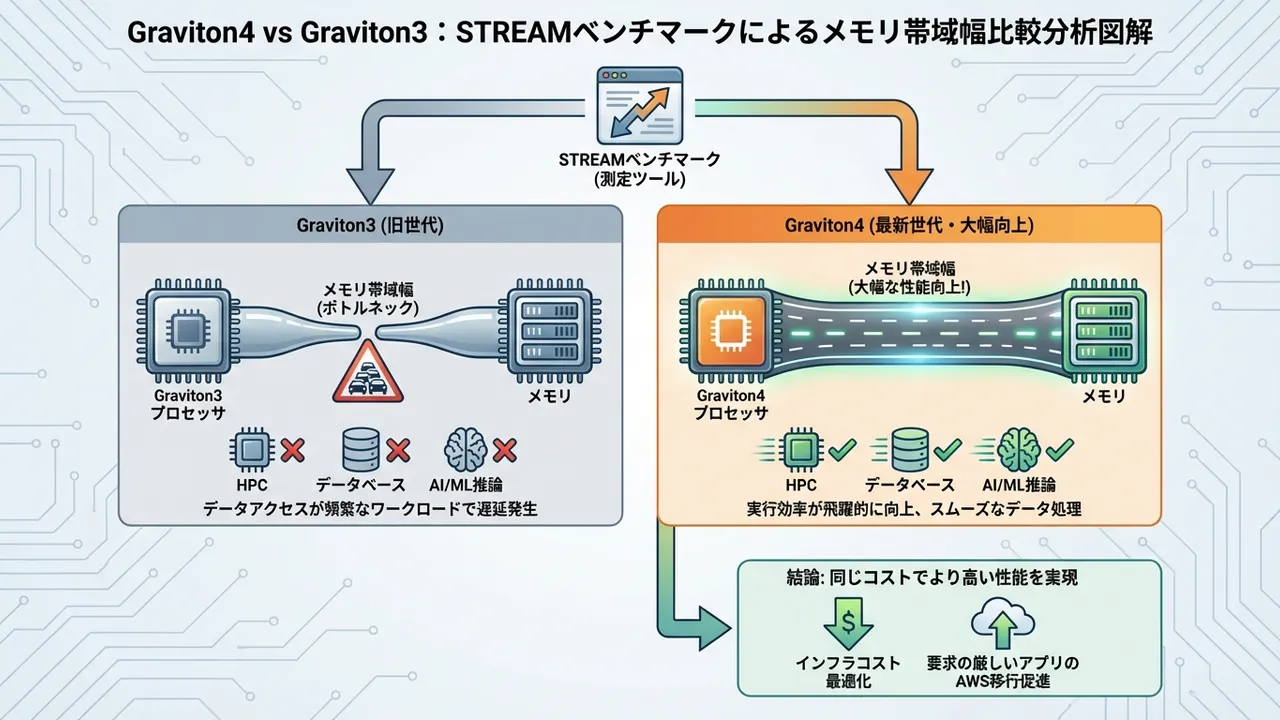

【5】Graviton4 vs Graviton3:STREAMベンチマークによるメモリ帯域幅比較分析

■ 何が変わるか

最新のAWS Graviton4プロセッサとGraviton3プロセッサのメモリ帯域幅を、STREAMベンチマークを用いて詳細に比較分析した記事が公開されました。この分析では、Graviton4がGraviton3と比較して、メモリ帯域幅において大幅な性能向上を達成していることが明らかになっています。特に、データ集約型アプリケーションやHPC(High Performance Computing)ワークロードにおいて、このメモリ帯域幅の改善が直接的なパフォーマンス向上に繋がる可能性があります。具体的な数値とグラフで示された結果は、今後のインスタンス選定における重要な指標となります。

■ なぜ重要か

プロセッサの計算能力だけでなく、メモリ帯域幅は多くのアプリケーション、特にデータベース、キャッシュ、分析、AI/ML推論といったデータアクセスが頻繁に行われるワークロードのボトルネックとなりがちです。Graviton4のメモリ帯域幅の強化は、これらのワークロードの実行効率を飛躍的に向上させる可能性を秘めており、同じコストでより高い性能を引き出せることを意味します。これにより、インフラコストの最適化や、より要求の厳しいアプリケーションのAWSへの移行が促進されるでしょう。

■ あなたへの影響

バックエンドエンジニア、データエンジニア、パフォーマンスチューニングを担当するSREにとって、Graviton4の登場とこのベンチマーク結果は、今後のインフラ選定戦略に大きな影響を与えます。現在Graviton3を利用している、あるいはx86ベースのインスタンスからの移行を検討している場合、Graviton4への切り替えによって、アプリケーションの性能向上やコスト削減を実現できる可能性があります。特にメモリに敏感なアプリケーションを運用している場合は、Graviton4への移行を積極的に検討する価値があります。

■ アクション

現在AWS上で稼働している、あるいは今後デプロイ予定のアプリケーションで、メモリ帯域幅がボトルネックになっている可能性のあるワークロードを特定しましょう。Graviton4インスタンスタイプが利用可能になった際に、実際のアプリケーションでベンチマークテストを実施し、Graviton3やx86インスタンスとの性能差を検証してください。これにより、Graviton4への移行による具体的なメリットを評価し、コストパフォーマンスの最適化を図ることが可能になります。

内訳:

注目記事

AI新機能への反応:サイバーセキュリティ株とClaude

Bloombergの記事によると、Anthropicが発表したClaudeの新しい機能が、サイバーセキュリティ業界の株式市場に影響を与えています。AI技術の進化、特にClaudeのような高度な言語モデルの機能拡張は、情報セキュリティ分野におけるリスクや機会の認識を変化させ、関連企業の株価に波及効果をもたらしています。この記事は、AIの進歩がどのように直接的に経済や特定の産業セクターに影響を与えるかを示す事例として注目されます。

AnthropicのClaude新機能発表が、AIの進化を背景にサイバーセキュリティ株市場に影響を与え、AIと経済の相互作用を浮き彫りにしました。

2026-02-22

Deno Sandboxでの「rm -rf /」実行実験:その挙動と安全性

本記事では、Denoのサンドボックス環境を利用して、危険なコマンドである「rm -rf /」を実行した際の挙動を検証しています。Denoのサンドボックス機能は、スクリプトの実行を制限し、システムへの意図しない影響を防ぐための仕組みです。この記事では、サンドボックス内でこのコマンドを実行した場合に、本来のシステムにどのような影響があるのか、またはないのかを具体的に示しています。これにより、Denoのセキュリティ機能やサンドボックスの有効性について理解を深めることができます。

Denoのサンドボックス環境で「rm -rf /」を実行した実験を通じて、その強力な隔離能力とDenoのセキュリティ設計の有効性が実証されました。

2026-02-22

Hono v4.12.1リリース:クライアントAPIのバグ修正

Hono v4.12.1のリリースノートによると、クライアントAPIにおける`ApplyGlobalResponse`のエクスポートに関するバグが修正されました。この修正は、@sushichan044氏によってプルリクエスト#4743で提供されています。詳細な変更履歴は、v4.12.0からv4.12.1までの範囲で確認できます。このリリースは、Honoフレームワークの安定性を向上させるための軽微なアップデートです。

Hono v4.12.1でクライアントAPIの`ApplyGlobalResponse`のエクスポートに関するバグが修正され、フレームワークの安定性が向上しました。

2026-02-22

記事一覧

18件

絞り込み

カテゴリー

タグ

Anthropic Claude Sonnet 4.6発表:新モデルの特徴、料金、活用事例

株式会社SHIFT AIの記事では、Anthropicが発表した最新AIモデル「Claude Sonnet 4.6」について詳細に解説しています。このモデルは、性能向上、コスト効率、および多岐にわたる活用事例が特徴です。記事では、Sonnet 4.6が持つ具体的な機能、料金体系、そしてビジネスや研究開発における実際の応用例を紹介しています。AI技術の最前線に立つClaude Sonnet 4.6の登場は、自然言語処理分野におけるさらなる進化と、その実用的な展開への期待を高めます。

Anthropicが最新AIモデル「Claude Sonnet 4.6」を発表し、その性能向上、料金体系、そして広範な活用事例が、AI技術のさらなる進化と実用化を加速させることを示唆しています。

2026-02-22

AI新機能への反応:サイバーセキュリティ株とClaude

Bloombergの記事によると、Anthropicが発表したClaudeの新しい機能が、サイバーセキュリティ業界の株式市場に影響を与えています。AI技術の進化、特にClaudeのような高度な言語モデルの機能拡張は、情報セキュリティ分野におけるリスクや機会の認識を変化させ、関連企業の株価に波及効果をもたらしています。この記事は、AIの進歩がどのように直接的に経済や特定の産業セクターに影響を与えるかを示す事例として注目されます。

AnthropicのClaude新機能発表が、AIの進化を背景にサイバーセキュリティ株市場に影響を与え、AIと経済の相互作用を浮き彫りにしました。

2026-02-22

Graviton4 vs Graviton3:STREAMベンチマークによるメモリ帯域幅比較分析

本記事は、Amazon EC2の最新CPUであるGraviton4と、その前世代であるGraviton3のパフォーマンスをSTREAMベンチマークを用いて比較分析しています。特に、1vCPUあたりのメモリ帯域幅に焦点を当て、Graviton4が期待される性能向上を示すのか、それとも特定の条件下ではGraviton3を下回るのかを詳細に検証しています。テスト結果に基づき、両CPUアーキテクチャのメモリ帯域幅性能の違いを明らかにすることで、ワークロードに応じた最適なインスタンス選択のための示唆を提供します。

Graviton4は1vCPU構成において、STREAMベンチマークによるメモリ帯域幅テストでGraviton3より遅い場合があるという意外な結果を示し、CPU選択の重要性を浮き彫りにしました。

2026-02-22

メンバーズCUR活用:SP情報レポートをSlackへ自動通知する実践ガイド

この記事では、メンバーズCUR(Customer Usage Report)を活用して、SP(Service Provider)に関する各種情報(インベントリ、使用率、カバー率、按分)をSlackへ自動的にレポート通知する具体的な方法を解説しています。日々の運用で収集されるこれらのデータを、効率的に関係者へ共有するための自動化ワークフローを構築します。これにより、チーム内の情報共有が円滑になり、迅速な意思決定を支援します。本稿は、運用効率化を目指すチームにとって実践的なノウハウを提供します。

メンバーズCURとSlack連携により、SPの重要指標レポートを自動化し、チーム内の情報共有と意思決定プロセスを大幅に効率化します。

2026-02-22

Deno Sandboxでの「rm -rf /」実行実験:その挙動と安全性

本記事では、Denoのサンドボックス環境を利用して、危険なコマンドである「rm -rf /」を実行した際の挙動を検証しています。Denoのサンドボックス機能は、スクリプトの実行を制限し、システムへの意図しない影響を防ぐための仕組みです。この記事では、サンドボックス内でこのコマンドを実行した場合に、本来のシステムにどのような影響があるのか、またはないのかを具体的に示しています。これにより、Denoのセキュリティ機能やサンドボックスの有効性について理解を深めることができます。

Denoのサンドボックス環境で「rm -rf /」を実行した実験を通じて、その強力な隔離能力とDenoのセキュリティ設計の有効性が実証されました。

2026-02-22

Terraformを用いたVPC Peering環境の構築ガイド

この記事は、Terraformを使用してAmazon Web Services (AWS) 上にVPC Peering環境を構築する手順を解説しています。VPC Peeringは、異なるVPC間でのプライベートなネットワーク接続を可能にするサービスであり、Terraformを用いることで、この設定をコードとして管理し、再現性高くデプロイできます。記事では、具体的なTerraformコード例を示しながら、ネットワーク構成、セキュリティグループ、ルーティングテーブルの設定方法などを網羅的に説明しています。この手法は、インフラストラクチャの迅速かつ正確な構築に貢献します。

Terraformを活用することで、VPC Peering環境の構築をコード化し、迅速かつ再現性高くインフラストラクチャを管理・デプロイすることが可能になります。

2026-02-22

Obsidian Web ClipperとClaude Codeを活用した技術記事の自動整理術

本記事では、Obsidian Web ClipperとClaude Codeを連携させ、日々収集する技術記事を効率的に整理する方法について解説しています。Web上の記事をObsidianにクリップし、Claude Codeを用いて内容の要約やタグ付けを自動化することで、情報管理の手間を大幅に削減します。これにより、専門家はより深く技術内容の理解や活用に集中できるようになります。この組み合わせは、大量の技術情報を扱う研究者や開発者にとって強力なツールとなり得ます。

Obsidian Web ClipperとClaude Codeの連携により、技術記事の収集・整理プロセスを自動化し、情報管理の効率を劇的に向上させます。

2026-02-22

Hono v4.12.1リリース:クライアントAPIのバグ修正

Hono v4.12.1のリリースノートによると、クライアントAPIにおける`ApplyGlobalResponse`のエクスポートに関するバグが修正されました。この修正は、@sushichan044氏によってプルリクエスト#4743で提供されています。詳細な変更履歴は、v4.12.0からv4.12.1までの範囲で確認できます。このリリースは、Honoフレームワークの安定性を向上させるための軽微なアップデートです。

Hono v4.12.1でクライアントAPIの`ApplyGlobalResponse`のエクスポートに関するバグが修正され、フレームワークの安定性が向上しました。

2026-02-22

Nemotron 9B-v2-JapaneseをSageMaker東京リージョンにVPC閉域構成でデプロイ

本記事では、日本語に特化した大規模言語モデル「Nemotron 9B-v2-Japanese」を、Amazon SageMakerの東京リージョンにおいて、VPC(Virtual Private Cloud)による閉域ネットワーク構成でデプロイした事例を紹介します。これにより、インターネットから隔離されたセキュアな環境でモデルを運用する手順と、その際の技術的な考慮事項が示されています。セキュアなAIモデル運用に関心のある技術者にとって参考となる内容です。

Nemotron 9B-v2-Japaneseモデルを、SageMaker東京リージョンでVPC閉域構成という高度にセキュアな環境にデプロイする具体的な手順とノウハウを共有。

2026-02-22

Entra IDとAWS IAM Identity Center連携におけるSAML証明書の更新手順

本記事では、Microsoft Entra ID (旧Azure AD) と AWS IAM Identity Center (旧AWS SSO) を連携させている環境で、SAML証明書を更新する具体的な手順を解説しています。IDプロバイダーとサービスプロバイダー間の信頼関係を維持するために不可欠な証明書更新プロセスを、図解やコマンド例を交えて丁寧に説明しており、管理者が安全かつスムーズに作業を行うための実践的なガイドとなっています。

Entra IDとAWS IAM Identity Center連携環境において、SAML証明書の更新作業を安全かつスムーズに実行するための詳細な手順と注意点を解説。

2026-02-22

TechCrunch Disrupt 2026:チケット価格値上げまであと7日、早期割引は2月27日まで

TechCrunch Disrupt 2026への参加を検討している方へ、チケット価格の値上げが迫っていることを知らせるアナウンスです。現在適用されている最も割引率の高いチケット価格(個人パスは最大$680オフ、グループパスは最大30%オフ)は、2月27日までとなります。このイベントは、10,000人以上の創業者、テックオペレーター、ベンチャーキャピタリストが集まる、業界注目のカンファレンスです。

TechCrunch Disrupt 2026の早期割引チケットの販売が2月27日に終了するため、参加予定者は速やかな登録が必要。

2026-02-22

Classmethod Showcase(ガバナンス編)登壇資料:AWSマルチアカウント戦略の始め方

本記事は、Classmethod Showcaseのガバナンス編にて行われた登壇の資料を共有するものです。テーマは「今日からはじめるAWSマルチアカウント戦略」であり、AWS環境における複数アカウントの管理・運用を効果的に行うための戦略やベストプラクティスについて解説しています。組織の成長やセキュリティ要件に対応するための、AWSマルチアカウント戦略の導入と実践方法が学べます。

AWSマルチアカウント戦略の基本から実践までを解説し、組織のガバナンス強化と運用効率化を実現するための具体的なステップを紹介。

2026-02-22

OpenAI、カナダの銃撃事件容疑者のChatGPT利用について警察への通報を検討

OpenAIは、カナダで発生した銃撃事件の容疑者がChatGPTを利用していた件について、そのチャット内容が利用規約違反を監視するツールによって検出された後、警察への通報を検討していたことが明らかになりました。この事例は、AIツールの悪用防止策と、それらが社会安全に与える影響に関するOpenAIの内部での議論と対応を示唆しています。AIの倫理的利用と安全対策の重要性が浮き彫りになっています。

OpenAIが、銃撃事件容疑者のChatGPT利用における不適切コンテンツを検知し、警察への通報を検討した事例は、AIの悪用防止と倫理的対応の重要性を示す。

2026-02-22

JAWS-UG神戸での登壇資料:AWS Landing Zone Accelerator (LZA) の実践

本記事は、JAWS-UG神戸での登壇内容をまとめた資料です。テーマは「Landing Zone Accelerator (LZA) on AWS を触ってみる」であり、AWSの環境構築を効率化・標準化するLZAの機能や利用方法について解説しています。参加者がAWSのベストプラクティスに基づいたアカウント管理基盤を迅速に構築するための実践的な情報が提供されています。

AWS Landing Zone Accelerator (LZA) を用いることで、ベストプラクティスに基づいたマルチアカウント環境を迅速かつ容易に構築できる実践的な手法を紹介。

2026-02-22

Google VP、AIスタートアップの存続リスクについて警告:LLMラッパーとアグリゲーターに影響

Googleのバイスプレジデントは、生成AIの進化に伴い、特定のタイプのAIスタートアップが厳しい状況に直面する可能性があると警告しています。具体的には、既存のLLM(大規模言語モデル)をラップするサービスや、AIサービスを集約するアグリゲーターは、利益率の低下と差別化の困難さから、長期的な存続が危ぶまれると指摘しています。この分析は、AIスタートアップのビジネスモデルの持続可能性に一石を投じるものです。

Google VPが、LLMラッパーとAIアグリゲーターという2種類のAIスタートアップは、競争激化と収益性の低下により、存続が困難になるリスクが高いと警告している。

2026-02-22

マイクロソフト新ゲーミングCEO、AIコンテンツの「無秩序な氾濫」に警鐘

マイクロソフトの新たなゲーミング部門CEOは、業界内に「際限のないAIのゴミ」を氾濫させないという決意を表明しました。これは、AI技術の急速な進化と普及がゲーム業界に与える影響、特にコンテンツの品質と独自性に対する懸念を示唆しています。同社がAIをどのように活用しつつも、ゲーム体験の質を維持しようとしているのか、その戦略に注目が集まります。

マイクロソフトの新ゲーミングCEOが、AI生成コンテンツの品質管理に注力し、ゲームエコシステムにおける「AIのゴミ」の氾濫を防ぐ方針を明言した。

2026-02-22

JAWS DAYS 2026登壇テンプレートをKiro CLIとMarpで再現する試み

本記事では、JAWS DAYS 2026の公式PPTテンプレートを、AIを活用してMarpで再現するプロセスを紹介します。Kiro CLIを用いてPythonでデザイン要素を抽出し、MarpのMarkdown構文に変換する手順が詳述されています。さらに、スライドの視認性を向上させるために「座布団」というCSSテクニックが紹介されており、AIとのペアプログラミングによるスライド作成の効率化と高度化が示されています。

AIとKiro CLI、Marpを連携させることで、既存PPTテンプレートのデザインを効率的に抽出し、再利用可能なスライド資料を半自動で生成できる。

2026-02-22

サム・アルトマン氏、人間も多くのエネルギーを消費することを強調

OpenAIのCEOであるサム・アルトマン氏は、AIのトレーニングに要するエネルギー消費量だけでなく、人間が生きて活動するために消費するエネルギー量も膨大であることを指摘しています。AIのエネルギー消費を議論する際に、人間のエネルギー消費量との比較や、持続可能なエネルギー利用の重要性を考慮すべきだと示唆しています。この視点は、AI技術の普及に伴うエネルギー問題への新たなアプローチを促すものです。

AIのエネルギー消費問題について、人間のエネルギー消費量との比較という新たな視点を提示し、持続可能性への議論を深める。

2026-02-22

すべての記事を表示しました