本日のニュース総括(35件)

本日のニュース総括(35件)

📊 今日の総括

今日のテックニュースは、AI業界の基盤と方向性に関する重要な動きが際立っています。特に、AnthropicがAIデータセンターの電力コストを全額負担するという持続可能性へのコミットメントは、AIインフラの経済性と環境負荷に対する新たなアプローチを提示しています。一方で、OpenAIの安全開発チーム解散は、AIガバナンスと倫理的開発の優先順位に関する議論を深めるでしょう。また、Amazon ConnectへのOpenAIモデル統合や、Bedrock AgentCoreにおけるセマンティックキャッシュ実装の進展は、AI技術の実用化と効率化がAWSエコシステム内で加速していることを示しており、エンジニアにとって実務に直結する重要な進展が多数見られます。

🔍 ピックアップ

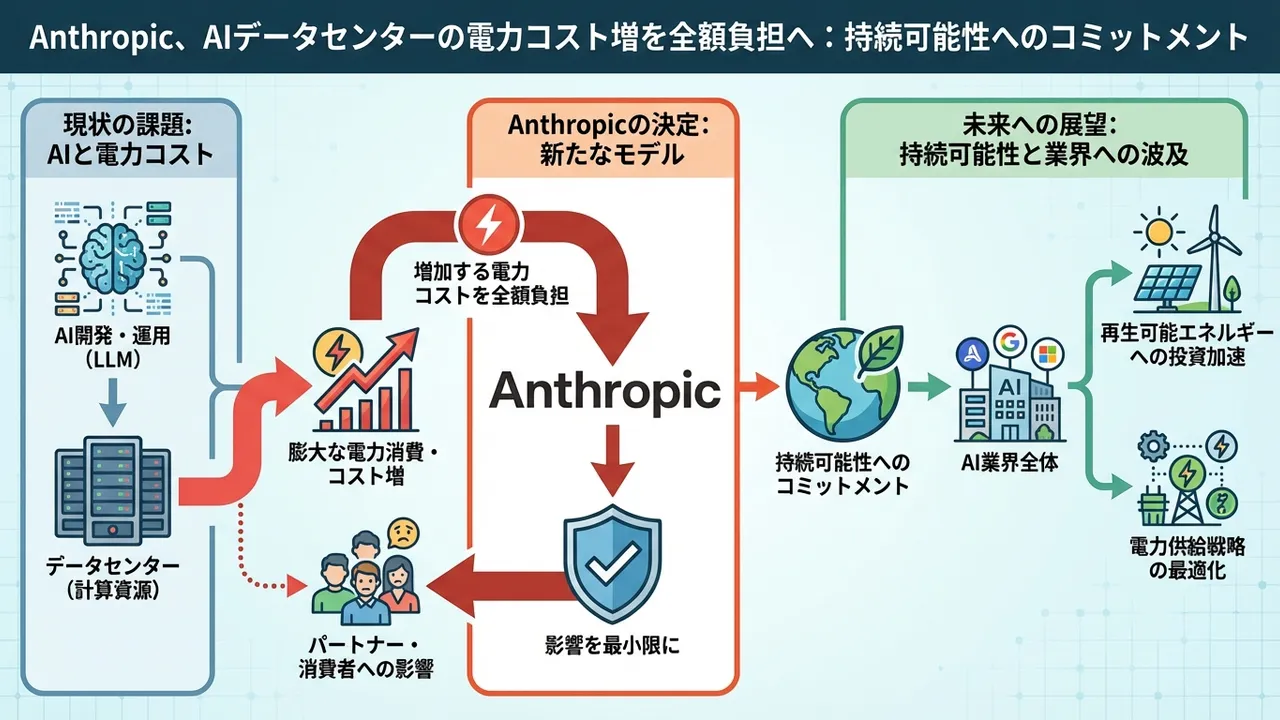

【1】AnthropicのAIデータセンター電力コスト負担と持続可能性へのコミットメント

■ 何が変わるか Anthropicは、大規模AIモデルの運用に不可欠なデータセンターの電力コスト上昇分を全額自社で負担する方針を明らかにしました。これは、AI開発に伴う膨大な電力消費が環境に与える影響や、運営コストの増大という業界全体の課題に対し、企業が積極的に持続可能性を追求する姿勢を示すものです。特に、電力料金の変動リスクを自社で吸収することで、パートナー企業や消費者へのサービスコストの安定化を図り、より予測可能なAIサービスの提供を目指します。この取り組みは、AIインフラの設計、電力供給戦略、そして再生可能エネルギーへの投資に関して、AI業界全体に新たな基準を提示する可能性があります。

■ なぜ重要か 大規模言語モデル(LLM)の学習と推論には莫大な計算資源と電力消費が伴い、これがAIサービスのコスト構造と持続可能性における最大の課題の一つとなっています。Anthropicのこの戦略は、AIの環境負荷低減とコスト管理において、業界に先行して新たなビジネスモデルを提示するものです。他社が同様のコミットメントを追随すれば、AIインフラの選択基準や、持続可能なAI開発のためのグローバルな取り組みが加速される契機となり得ます。長期的な視点で見ると、これはAI業界全体の競争環境や規制動向にも影響を与える可能性があります。

■ あなたへの影響 AIを活用したサービスやアプリケーションを開発・運用するエンジニアにとって、基盤となるAIモデル提供者の持続可能性への取り組みは、長期的なサービス安定性やコスト効率に直接影響します。Anthropicのモデルを基盤とする場合、電力コストの変動がサービス価格に直接転嫁されるリスクが低減され、より予測可能なコストで運用できる可能性があります。また、これは環境配慮型AIソリューションの設計や、企業のCSR(企業の社会的責任)戦略に合致するAI技術の選択においても重要な判断材料となるでしょう。エンジニアは、サステナブルなAIインフラ選択の重要性を再認識する必要があります。

■ アクション Anthropicの公式発表や詳細なレポートを確認し、同社の電力調達戦略や持続可能性への具体的なアプローチについて深く理解しましょう。自社のAI戦略において、サプライヤーの環境・コスト方針を評価する際の新たな基準として考慮し、長期的な視点でのパートナーシップを検討してください。また、自社のAIアプリケーションの電力効率性向上に向けた設計アプローチについても見直しを進める良い機会です。

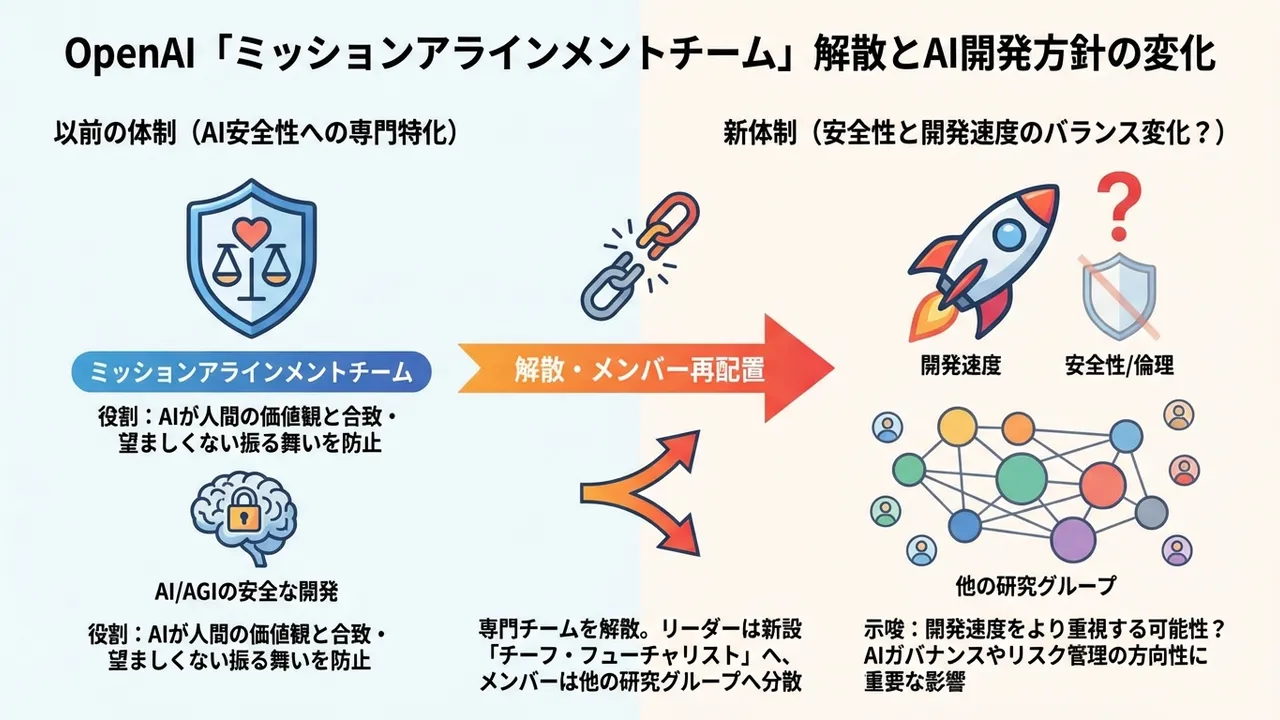

【2】OpenAI「ミッションアラインメントチーム」解散とAI安全開発の行方

■ 何が変わるか AI業界の最前線を走るOpenAIが、AIの安全な開発と長期的な整合性(アラインメント)を担当していた専門チーム「ミッションアラインメントチーム」を解散したと報じられました。このチームは、AIが人間の価値観と合致するように制御し、望ましくない振る舞いを防ぐための研究を専門に行っていました。チームのメンバーは他の研究グループに再配置されるとのことですが、独立した専門チームの解散は、AIの「安全性」と「開発速度」のバランスに対するOpenAIの組織としての優先順位の変化を示唆しています。

■ なぜ重要か OpenAIは、AGI(汎用人工知能)の安全な開発をそのミッションの中核に掲げ、世界をリードしてきました。この専門チームの解散は、そのミッション遂行に対する具体的なアプローチ、特にAIの倫理的側面や社会への影響に関する懸念に対する組織内部の考え方に大きな変化があったことを示唆します。これは、AIの倫理、ガバナンス、リスク管理に関心を持つ研究者や政策立案者、そしてAI技術を採用する企業にとって、今後のAI開発の方向性を考える上で極めて重要な情報であり、AIの安全性確保が後退するのではないかという懸念も生じています。

■ あなたへの影響 AIシステムの倫理的かつ安全な利用は、あらゆるAI開発・運用エンジニアにとって喫緊の課題です。主要なAI開発企業が安全に関する専門チームを解散したというニュースは、AIのガバナンスやリスク評価に対するあなたの組織のアプローチを見直すきっかけとなるかもしれません。特に、OpenAIのモデルやAPIを利用している場合、同社の今後の安全対策や公開ポリシーの動向を常に注視し、自社のアプリケーションにおける潜在的なリスクを評価し続ける必要があります。責任あるAI開発の原則を自らのプロジェクトにどう適用するか、改めて検討が求められます。

■ アクション OpenAIの公式声明や関連する分析記事を詳細に読み込み、今回の決定の背景と意図を深く理解しましょう。AI倫理ガイドラインや責任あるAI開発の原則について、社内での議論を積極的に促進し、自社のAI開発プラクティスに反映させることを検討してください。また、AIの安全性に関する最新の研究動向や、代替となるアライメント技術についても引き続き情報収集を行い、多様な視点からリスク評価を行う準備を進めましょう。

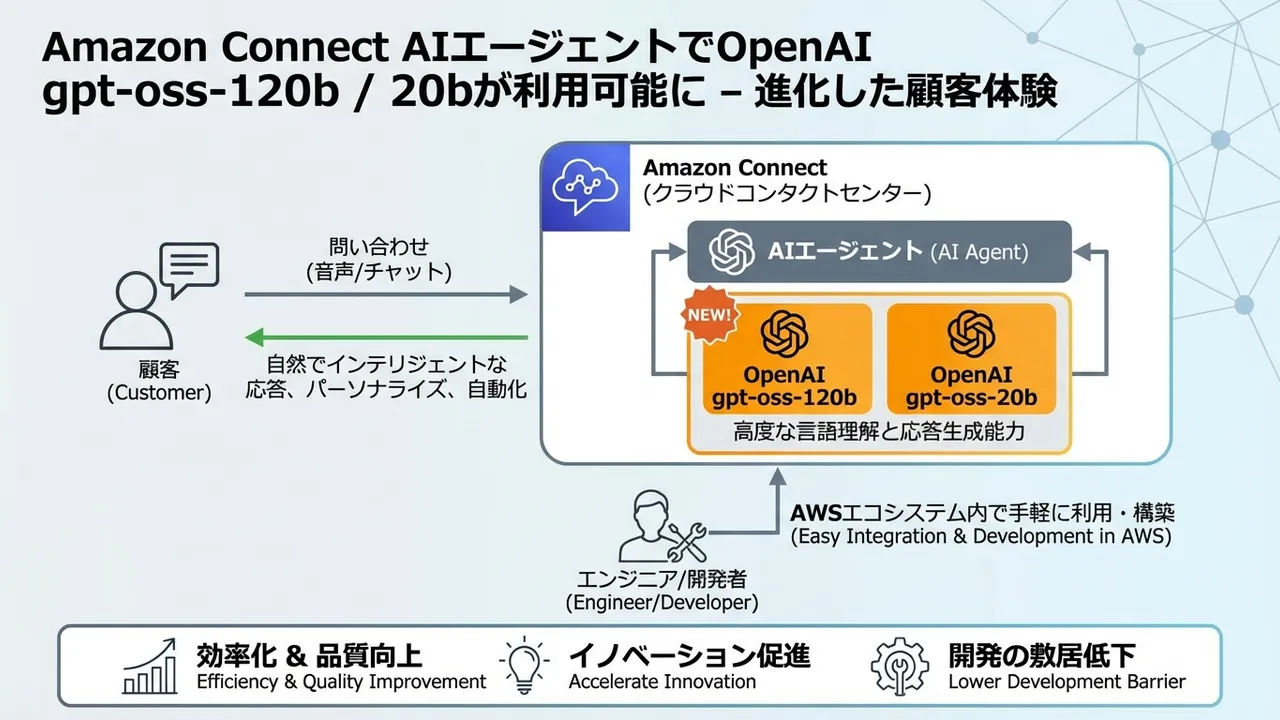

【3】Amazon Connect AIエージェントへのOpenAI gpt-ossモデル統合

■ 何が変わるか Amazon ConnectのAIエージェント機能において、OpenAIの「gpt-oss-120b」および「gpt-oss-20b」モデルが利用可能になりました。これにより、顧客とのインタラクションを処理するAIエージェントが、より高度な言語理解と自然な応答生成能力を獲得します。エンジニアは、Amazon Connectのサービス内でこれらの強力な大規模言語モデル(LLM)を直接活用し、より洗練されたインテリジェントな顧客体験を構築できるようになります。この統合により、コンタクトセンターの自動化レベルと顧客対応品質が飛躍的に向上する可能性を秘めています。

■ なぜ重要か Amazon Connectは、クラウドベースのコンタクトセンターサービスとして世界中で広く利用されており、多くの企業が顧客サポートの基盤としています。そこにOpenAIの先進的なLLMが統合されることは、既存のカスタマーサービスプラットフォームにおけるAI活用を大きく加速させます。これは、顧客応対の自動化率向上、パーソナライズされたサポートの提供、エージェント支援ツールの高度化など、コンタクトセンター業務の効率化と品質向上に直結します。AWSエコシステム内で最先端のAIモデルを手軽に利用できることは、AI開発の敷居を下げ、より広範なビジネス領域でのイノベーションを促進します。

■ あなたへの影響 コンタクトセンターソリューションや顧客サポートシステムを開発・運用するバックエンドエンジニアやAIエンジニアにとって、この発表は直接的かつ大きな影響があります。従来のルールベースや限定的なAIモデルでは実現が難しかった、複雑な問い合わせ対応や動的な情報提供を、Amazon ConnectとOpenAIの統合によって格段に高度に実現できるようになります。既存のAmazon Connectインスタンスを持つ企業は、少ない工数でAIエージェントの機能を大幅に強化できるため、顧客満足度向上と運用コスト削減の両面でメリットが期待でき、競争優位性を確立するチャンスとなります。

■ アクション Amazon Connectの管理コンソールや最新のドキュメントを確認し、gpt-ossモデルの利用方法、設定オプション、料金体系を詳細に把握しましょう。まずは小規模なパイロットプロジェクトや特定のユースケースでPoC(概念実証)を実施し、OpenAIモデル統合による顧客体験向上と運用効率化の効果を評価してください。既存のAIエージェントの会話フローやナレッジベースを最適化し、LLMの能力を最大限に引き出すための設計を検討し、新しい機能を積極的に活用しましょう。

■ 元記事 🔗 Amazon Connect AIエージェントでOpenAIの gpt-oss-120b と gpt-oss-20bが利用できるようになりました

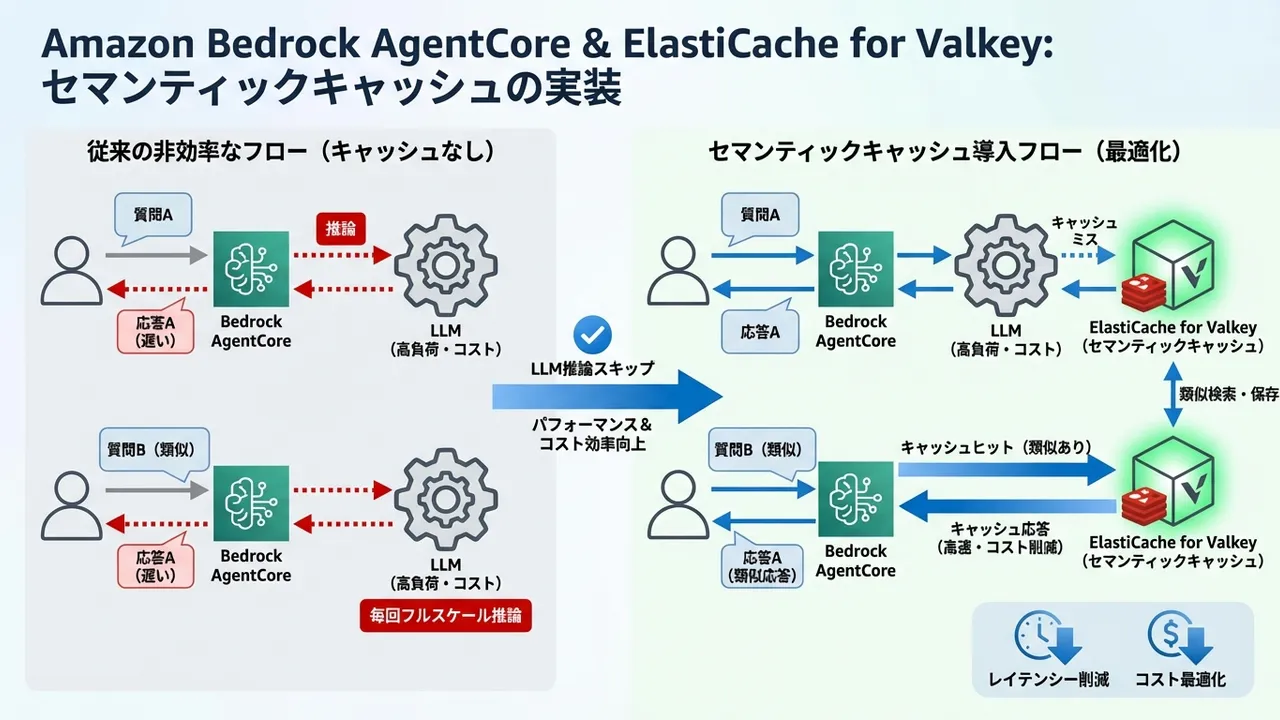

【4】Amazon Bedrock AgentCoreとElastiCache for Valkeyを用いたセマンティックキャッシュ実装

■ 何が変わるか Amazon Bedrock AgentCoreとElastiCache for Valkey(Redis互換の高速なインメモリデータストア)を組み合わせることで、大規模言語モデル(LLM)ベースのAIエージェントにおける「セマンティックキャッシュ」を実装する方法が詳細に解説されました。このアプローチにより、以前に問い合わせた内容に意味的に類似する質問に対しては、LLMの推論をスキップしてキャッシュされた応答を直接返すことが可能になります。これは、AIエージェントの応答レイテンシーを大幅に削減し、LLMのAPI呼び出しにかかるコストを効果的に最適化する画期的な手法です。

■ なぜ重要か LLMは非常に強力なツールですが、推論には時間とコストがかかるという課題があります。特に、頻繁に発生する類似の質問や繰り返し行われる問い合わせに対して毎回フルスケールでLLMを呼び出すことは、システム全体の効率を著しく低下させます。セマンティックキャッシュは、RAG(Retrieval-Augmented Generation)アーキテクチャやAIエージェントにおいて、パフォーマンスとコスト効率を両立させるための不可欠な最適化パターンです。Valkeyのような高速なインメモリデータストアとBedrock AgentCoreを組み合わせることで、AWS環境でこの複雑な最適化を容易かつ効率的に実現できるようになります。

■ あなたへの影響 AIエージェントやRAGシステムをAWS上で構築・運用しているバックエンドエンジニアやAIエンジニアにとって、この実装パターンは非常に実用的で直接的なメリットをもたらします。高いQPS(Queries Per Second)が求められる本番環境のサービスや、LLMのAPIコストを厳しく管理したい場合に、セマンティックキャッシュは導入必須の最適化手法となるでしょう。既存のAgentCoreベースのアプリケーションにこのパターンを導入することで、ユーザー体験を損なうことなく、運用コストを削減し、システムの応答性とスケーラビリティを大幅に向上させることが可能になります。

■ アクション まず、Amazon Bedrock AgentCoreとElastiCache for Valkeyの基本的な概念と、それらの連携方法に関するドキュメントを詳細に確認しましょう。次に、自身のAIエージェントが処理するワークロードパターンを分析し、セマンティックキャッシュによる効果が最も期待できるユースケースを具体的に特定してください。そして、実際に簡単なプロトタイプを構築し、セマンティックキャッシュ導入前後のレイテンシーとコストを正確に計測して、その導入効果を検証し、本番環境への適用計画を策定しましょう。

■ 元記事 🔗 Amazon Bedrock AgentCoreとElastiCache for Valkeyを用いたセマンティックキャッシュの実装

内訳:

注目記事

Anthropic、AIデータセンターの電力コスト増を全額負担へ:持続可能性へのコミットメント

AI企業Anthropicは、自社のデータセンター運用に伴う電力料金の上昇分を全額負担することを表明しました。これは、AI技術の急速な発展とそれに伴うエネルギー消費の増加に対する業界の責任を示すものです。同社は、環境負荷の低減と持続可能なAI開発への貢献を目指しています。この取り組みは、AI業界全体のサステナビリティに対する意識を高める上で重要な一歩となるでしょう。

AnthropicがAIデータセンターの電力コスト上昇分を全額負担し、持続可能性への強いコミットメントを示す。

2026-02-12

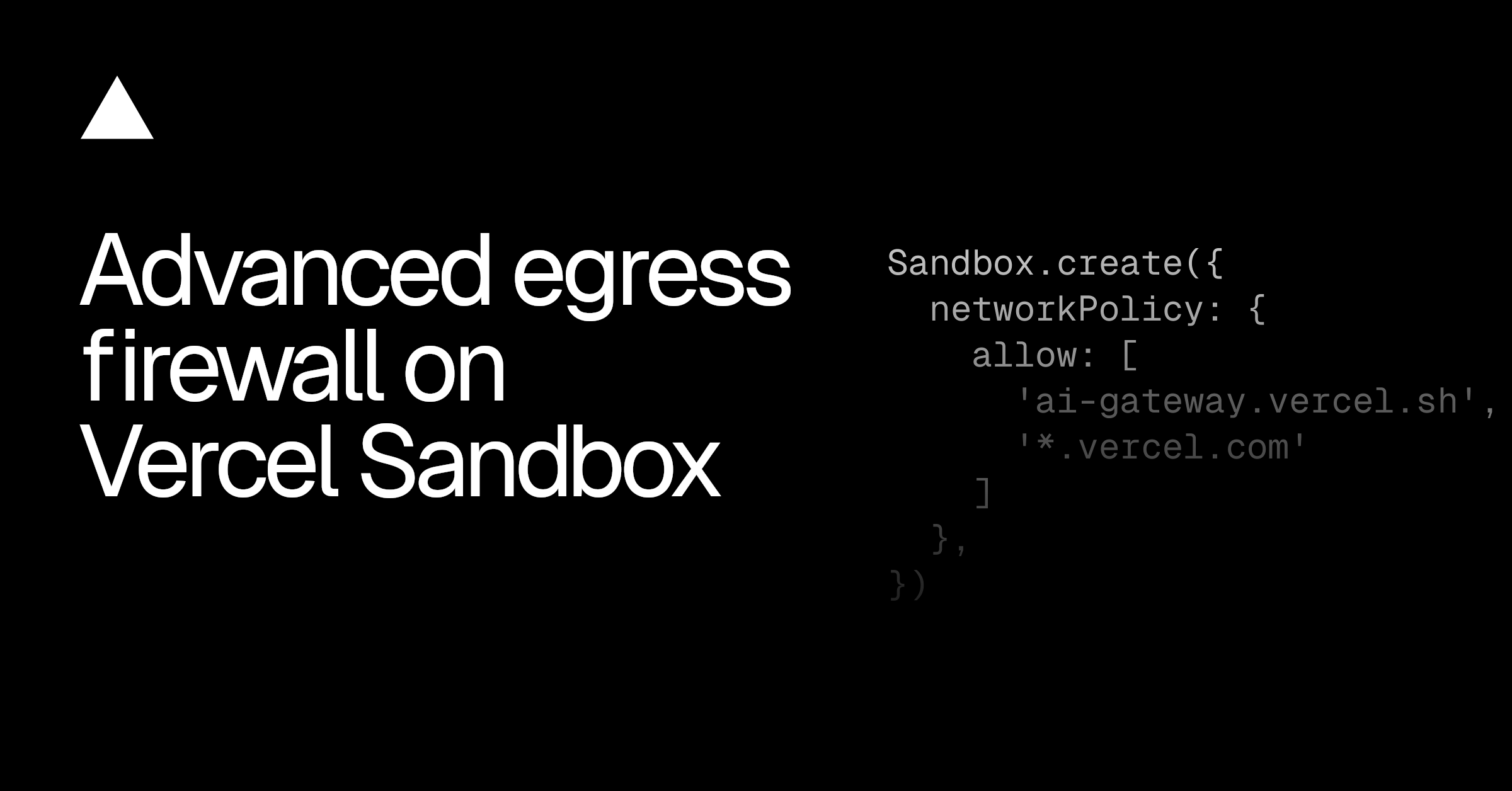

Vercel Sandbox向け高度な送信ファイアウォールフィルタリング機能の導入

Vercel Sandboxは、Server Name Indication (SNI) フィルタリングとCIDRブロックによる高度な送信ネットワークポリシー適用機能を追加しました。これにより、サンドボックスがアクセスできるホストを細かく制御できるようになります。TLSハンドシェイク時にポリシーが照合され、不正な宛先へのデータ送信前に拒否されます。デフォルトでは無制限のインターネットアクセスが可能ですが、この機能により、信頼できないコードやAI生成コードを実行する際に、必要なサービスのみにネットワークを制限し、データ漏洩や意図しないAPIコールを防ぐことが可能になります。

Vercel SandboxがSNIフィルタリングとCIDRブロックによる高度な送信ファイアウォール機能を追加し、サンドボックスのネットワークアクセス制御を強化したこと。

2026-02-12

Vercel AI GatewayでGLM-5モデルが利用可能に、AIエージェント機能が向上

Vercel AI Gatewayに、Z.AIの最新モデルGLM-5が追加されました。GLM-5は、GLM-4.7と比較して、複数の思考モード、長距離計画・記憶能力の向上、複雑なマルチステップエージェントタスクの処理能力が強化されています。特に、エージェントコーディング、自律的なツール利用、契約書や財務報告書のような文書からの構造化データ抽出に優れています。AI Gatewayは、単一APIで複数のモデルにアクセスでき、利用状況・コスト追跡、リトライ・フェイルオーバー設定などの機能を提供し、プロバイダー以上の稼働時間と信頼性を実現します。

Vercel AI GatewayがZ.AIの最新モデルGLM-5に対応し、AIエージェントの思考能力、計画能力、ツール利用能力が大幅に向上したこと。

2026-02-12

記事一覧

35件

絞り込み

カテゴリー

タグ

AI時代の著作権:Anthropic社の「影の書庫」データ流用訴訟が提起する問題

Yahoo!ニュースで報じられているこの記事も、Anthropic社が「影の書庫」データセットを不正に利用したとして訴えられている件に焦点を当てています。AIモデルのトレーニングにおけるデータ収集と著作権保護の間の緊張関係が、この訴訟を通じて顕著になったことを解説しています。AI技術の急速な進歩に伴い、既存の著作権法や倫理規範がどのように適用されるべきか、その課題について読者に問いかけています。

Anthropic社の「影の書庫」データ流用訴訟は、AI開発におけるデータ著作権の法的・倫理的課題を浮き彫りにしています。

2026-02-12

AI時代の著作権問題:Anthropic社の「影の書庫」データ流用訴訟から学ぶ

Forbes JAPANの記事では、Anthropic社が「影の書庫」と呼ばれるデータセットを無断で利用したとされる訴訟を取り上げ、AI開発における著作権侵害のリスクを浮き彫りにしています。AIモデルの学習データとして利用されるコンテンツの著作権保護が、AI技術の発展と倫理的な利用において喫緊の課題となっていることが指摘されています。AIが生成するコンテンツの権利や、学習データの権利問題が複雑化する現状を解説しています。

Anthropic社の訴訟事例は、AI開発における学習データの著作権問題の複雑さと、その解決の必要性を具体的に示しています。

2026-02-12

画像なし

Harness engineering: leveraging Codex in an agent-first world

2026-02-12

GitHub Actions、ecspresso、CDKを活用したECS Fargateデプロイパイプラインによる高速化事例

本記事では、GitHub Actions、ecspresso、AWS CDKを組み合わせることで、ECS Fargateへのデプロイパイプラインを大幅に高速化した事例を紹介します。従来のデプロイ時間が5分かかっていたものが、この新しいパイプラインによって3分に短縮された具体的なプロセスが解説されています。特に、ecspressoによるECSタスク定義の管理やGitHub Actionsでの自動化、CDKによるインフラ構築の効率化がデプロイ速度向上に寄与した点が強調されています。

GitHub Actions、ecspresso、CDKの連携により、ECS Fargateデプロイ時間を5分から3分へと大幅に短縮しました。

2026-02-12

FlutterアプリからSNSへ簡単にコンテンツを共有する方法:実装ガイド

本記事は、Flutterアプリケーションから各種SNS(LINE, Twitter, Facebookなど)へのコンテンツ共有機能を実装するための具体的な手順を解説します。`share_plus`パッケージを利用することで、プラットフォーム固有の実装を意識することなく、統一されたインターフェースでシェア機能を実装できることが紹介されています。テキストやURLの共有はもちろん、画像などのファイル共有についてもコード例を交えて解説しており、開発者がSNS連携機能を効率的に導入するための実践的なガイドとなっています。

Flutterで`share_plus`パッケージを使用することで、プラットフォームを問わず容易にSNSシェア機能を実装できます。

2026-02-12

Krita 6向けPII検出プラグインをAmazon Rekognitionで高速化・高精度化

本記事では、画像編集ソフトウェアKrita 6向けのPII(個人識別情報)検出プラグインにAmazon Rekognition DetectTextを導入し、そのパフォーマンスと精度を向上させた事例を紹介しています。従来のEasyOCR版では約30秒かかっていた処理が、Amazon Rekognitionの活用により約9秒に短縮されました。さらに、検出漏れの削減にも成功しています。これにより、クリエイターはより迅速かつ正確に、個人情報が含まれる可能性のある画像を管理できるようになり、プライバシー保護と作業効率の両立が可能になります。

Krita 6のPII検出プラグインにAmazon Rekognition DetectTextを適用することで、処理速度を約3.3倍に向上させ、検出精度も改善したこと。

2026-02-12

Vercel Flagsがパブリックベータ版に移行、プラットフォーム統合型の機能フラグ管理を提供

Vercel Flagsがパブリックベータ版として提供開始されました。これはVercelプラットフォームに統合された機能フラグプロバイダーであり、Vercelダッシュボード上でターゲティングルール、ユーザーセグメント、環境制御を含む機能フラグの作成・管理が可能です。SDKはNext.jsやSvelteKitアプリケーションとネイティブに統合され、OpenFeature標準にも対応しています。これにより、開発者はアプリケーションの特定機能を段階的にロールアウトしたり、A/Bテストを実施したりすることが容易になります。価格は100万フラグリクエストあたり30ドルです。

Vercel Flagsがパブリックベータとなり、Vercelプラットフォーム上で機能フラグの作成、管理、ターゲティングを容易に行えるようになったこと。

2026-02-12

Vercel Sandbox向け高度な送信ファイアウォールフィルタリング機能の導入

Vercel Sandboxは、Server Name Indication (SNI) フィルタリングとCIDRブロックによる高度な送信ネットワークポリシー適用機能を追加しました。これにより、サンドボックスがアクセスできるホストを細かく制御できるようになります。TLSハンドシェイク時にポリシーが照合され、不正な宛先へのデータ送信前に拒否されます。デフォルトでは無制限のインターネットアクセスが可能ですが、この機能により、信頼できないコードやAI生成コードを実行する際に、必要なサービスのみにネットワークを制限し、データ漏洩や意図しないAPIコールを防ぐことが可能になります。

Vercel SandboxがSNIフィルタリングとCIDRブロックによる高度な送信ファイアウォール機能を追加し、サンドボックスのネットワークアクセス制御を強化したこと。

2026-02-12

Vercel AI GatewayでGLM-5モデルが利用可能に、AIエージェント機能が向上

Vercel AI Gatewayに、Z.AIの最新モデルGLM-5が追加されました。GLM-5は、GLM-4.7と比較して、複数の思考モード、長距離計画・記憶能力の向上、複雑なマルチステップエージェントタスクの処理能力が強化されています。特に、エージェントコーディング、自律的なツール利用、契約書や財務報告書のような文書からの構造化データ抽出に優れています。AI Gatewayは、単一APIで複数のモデルにアクセスでき、利用状況・コスト追跡、リトライ・フェイルオーバー設定などの機能を提供し、プロバイダー以上の稼働時間と信頼性を実現します。

Vercel AI GatewayがZ.AIの最新モデルGLM-5に対応し、AIエージェントの思考能力、計画能力、ツール利用能力が大幅に向上したこと。

2026-02-12

ランサムウェア対策としてのpnpm導入のススメ:クラメソさっぽろIT勉強会での発表

本記事は、クラメソさっぽろIT勉強会で発表された「ランサムウェア対策としてのpnpm導入のススメ」というテーマについてまとめたものです。pnpmはNode.jsのパッケージマネージャーであり、その効率性やセキュリティ面での利点から、ランサムウェア対策として有効である可能性が示唆されています。発表では、pnpmがどのように依存関係を管理し、それがセキュリティリスクの低減にどう繋がるのかが解説されたと考えられます。開発環境におけるセキュリティ強化に関心のある技術者にとって、参考になる内容となっています。

Node.jsパッケージマネージャーpnpmが、その依存関係管理の仕組みを通じてランサムウェア対策として有効である可能性。

2026-02-12

ECS Express Modeの制限回避:ARM64、Fargate Spot、ECS Execの活用

この記事は、Amazon ECS (Elastic Container Service) のExpress ModeにおけるARM64、Fargate Spot、ECS Execの未対応制限を回避する方法について解説しています。Express Modeはデプロイを高速化しますが、特定のインスタンスタイプや機能が利用できない場合があります。筆者は、CloudFormationとAWS CLIを組み合わせた2段階デプロイプロセスを提案し、これらの制限を克服する具体的な手順を示しています。これにより、ARM64インスタンスやFargate Spot、ECS Execといった有用な機能をExpress Mode環境でも活用できるようになり、コスト最適化や運用効率の向上が期待できます。

ECS Express Modeの制限を回避し、ARM64、Fargate Spot、ECS Execといった機能を活用するための2段階デプロイプロセス。

2026-02-12

Amazon Bedrock AgentCoreとElastiCache for Valkeyを用いたセマンティックキャッシュの実装

本稿では、Amazon Bedrock AgentCoreとAmazon ElastiCache for Valkeyを連携させ、セマンティックキャッシュを実装する手法を解説しています。セマンティックキャッシュは、AIモデルの応答をキャッシュすることで、推論速度の向上とコスト削減に貢献します。特に、Valkey(Redis互換のインメモリデータストア)を利用することで、高速なデータ取得が可能になります。記事では、Bedrock AgentCoreが生成する意味的なクエリをValkeyに保存・検索し、応答を高速化する具体的な実装手順とアーキテクチャについて説明しています。これにより、LLMアプリケーションのパフォーマンスと効率が向上します。

Amazon Bedrock AgentCoreとAmazon ElastiCache for Valkeyを組み合わせることで、AI応答の高速化とコスト削減を実現するセマンティックキャッシュの実装方法。

2026-02-12

AWS IAM Identity CenterにおけるKMSカスタマーマネージドキー暗号化データの読み取り権限付与

本記事は、AWS IAM Identity CenterでKMSカスタマーマネージドキー(CMK)を使用して暗号化されたリソースへの読み取り権限を付与する方法について解説しています。IAM Identity Centerは、複数のAWSアカウントやアプリケーションへのアクセスを一元管理するサービスです。CMKで暗号化されたデータへのアクセスには、適切なIAMポリシーの設定が不可欠です。記事では、具体的なポリシー設定例を示しながら、CMKのデコード権限をIAM Identity Centerに付与する手順を詳細に解説しており、セキュリティを維持しつつ必要なアクセスを許可するための実践的なガイドとなっています。

AWS IAM Identity CenterでKMS CMKにより暗号化されたデータに対する読み取り権限を付与するための具体的なIAMポリシー設定方法。

2026-02-12

Microsoft Foundry、AnthropicのClaude Opus 4.6を統合し、企業向けAI機能を拡張

Microsoft Foundryは、Anthropicの最先端AIモデルであるClaude Opus 4.6を自社のプラットフォームに統合しました。この連携により、企業はClaude Opus 4.6が持つ高度な自然言語理解能力、推論能力、および長文処理能力を活用できるようになります。これにより、Microsoft Foundryは、顧客向けのAIサービスを大幅に拡張し、より複雑なビジネス課題の解決を支援することが可能となります。具体的には、コンテンツ生成、データ分析、顧客対応などの分野でのAI活用が強化される見込みです。

Microsoft FoundryがAnthropicのClaude Opus 4.6を統合し、企業向けAI機能が大幅に拡張されたこと。

2026-02-12

Threadsの新機能「Dear Algo」でAIによるフィードパーソナライゼーションを実現

Meta傘下のThreadsは、AIを活用した新機能「Dear Algo」を導入しました。これにより、ユーザーは一時的に表示したくないコンテンツをフィードから除外し、より好みの投稿を優先表示させることが可能になります。この機能は、アルゴリズムへの直接的なフィードバックを通じて、ユーザー体験の向上を目指すものです。ユーザーは「もっと見たい」「あまり見たくない」といった意図をAIに伝えることで、パーソナライズされたフィードを構築できるようになります。これにより、Threadsの利用満足度が向上することが期待されます。

ThreadsがAIを活用した「Dear Algo」機能で、ユーザーが直接フィードの表示内容をパーソナライズできるようになった点。

2026-02-12

衛星軌道上のAIデータセンター経済性の厳しさ:地上設置型との比較

1GW(ギガワット)級の衛星軌道上データセンターを構築するには、約424億ドル(約5兆円超)もの巨額のコストがかかり、これは地上設置型のデータセンターの約3倍に相当します。この驚異的なコストは、衛星技術、打ち上げコスト、宇宙空間での運用・保守の困難さなど、宇宙空間でのインフラ構築に伴う経済的な課題の大きさを浮き彫りにしています。軌道上AIの実現には、これらの経済的なハードルを克服するための技術革新とコスト削減が不可欠です。

衛星軌道上のAIデータセンター構築には、地上設置型の約3倍という巨額のコストがかかり、経済的な厳しさが指摘されています。

2026-02-12

AWS CLI 2.33.20 リリース

AWS Command Line Interface (CLI) のバージョン2.33.20がリリースされました。このリリースは、安定版のリリースであることを示しています。具体的な変更点についての詳細は提供されていませんが、通常、CLIツールの機能拡張、パフォーマンス改善、またはバグ修正が含まれていると考えられます。AWS CLIのユーザーは、最新の安定版を利用することで、より良い開発体験を得られる可能性があります。

AWS CLIのバージョン2.33.20がリリースされ、安定版のアップデートが提供されました。

2026-02-12

AWS CLI 1.44.37 リリース

AWS Command Line Interface (CLI) のバージョン1.44.37がリリースされました。このリリースは、安定版のリリースであることを示しています。具体的な変更内容については、リリースノートなどの追加情報がないため不明ですが、一般的にはCLIツールの機能改善やバグ修正が含まれる可能性があります。AWS CLIユーザーは、最新バージョンの利用を検討することが推奨されます。

AWS CLIのバージョン1.44.37がリリースされ、安定版のアップデートが提供されました。

2026-02-12

xAI、創業メンバー含むシニアエンジニアの退職相次ぐ:論争の中での不安定さ浮き彫り

イーロン・マスク氏率いるxAIでは、過去1週間で少なくとも9人のエンジニア、うち2人は共同創業者を含むシニアエンジニアが退職を発表しました。これは、同社が直面する論争と相まって、xAIの安定性に対する疑問を浮き彫りにしています。これらの退職は、外部からの引き抜きではなく、内部的な問題によるものであるとマスク氏は示唆していますが、AI企業における人材流出と組織体制への懸念が高まっています。

xAIで共同創業者を含むシニアエンジニアの退職が相次ぎ、同社の安定性と論争に対する懸念が高まっています。

2026-02-12

Who will own your company’s AI layer? Glean’s CEO explains

2026-02-12

Glean’s fight to own the AI layer inside every company

2026-02-12

Uber Eats、AIアシスタントを導入:テキストや画像で食料品カート作成を支援

Uber Eatsは、ユーザーがテキストや画像プロンプトに基づいて自動的に商品をカートに追加できる新AI機能「Cart Assistant」をローンチしました。この機能は、食料品の買い物をより迅速かつ容易にすることを目的としています。AIを活用することで、ユーザーは手間をかけずに希望する商品をカートに追加できるようになります。これにより、Uber Eatsの利便性がさらに向上することが期待されます。

Uber Eatsが、テキストや画像入力で食料品カート作成を支援するAIアシスタント「Cart Assistant」を導入しました。

2026-02-12

AppleのSiri刷新、再び遅延か:一部機能はiOS 27まで持ち越しとの報道

当初iOS 26.4アップデートでのローンチが期待されていたAppleのSiri刷新について、報道によると再び遅延が発生する見込みです。一部の新機能は5月のiOSアップデート、あるいは9月のiOS 27リリースまで延期される可能性が指摘されています。この遅延は、Siriの機能強化に向けたAppleの取り組みに影響を与えているものと見られます。ユーザーが期待する大幅な改善の実現には、さらなる時間を要するようです。

AppleのSiri刷新が再び遅延し、一部の新機能はiOS 27まで持ち越される可能性が報じられています。

2026-02-12

Claudeの市場影響とAI研究者の警告:世界が危機に直面している可能性

AIモデルClaudeの登場が株式市場に混乱をもたらす中、Anthropicの研究者たちは「世界が危機に瀕している」との深刻な警告を発しました。この警告は、AI技術の急速な進化とその社会経済への影響に関する懸念を浮き彫りにしています。AIが市場に与える影響の大きさと、それに伴う潜在的なリスクについて、研究者たちは警鐘を鳴らしています。この状況は、AIの発展と社会との調和について、より一層の議論と対策を求めています。

Anthropicの研究者が、Claudeの市場への影響とAIの急速な進化がもたらす「世界的な危機」の可能性について警告しています。

2026-02-12

Anthropic、AIデータセンターのコスト負担を軽減し、消費者を保護する計画を発表

AI開発企業Anthropicは、AIデータセンターの運用コスト増大が消費者に及ぼす影響を軽減するための計画を発表しました。この計画は、AI技術の発展に伴うインフラコストの増加が、サービス利用料の上昇という形で消費者に負担をかけないようにするためのものです。同社は、持続可能なAIエコシステムの構築を目指し、コスト効率の高い運用方法を模索しています。これにより、AIの恩恵をより多くの人々が享受できる環境の整備が期待されます。

AnthropicがAIデータセンターのコスト増大から消費者を保護する計画を発表し、持続可能なAIエコシステム構築を目指しています。

2026-02-12

OpenAI、AIの安全な開発を担った「ミッションアラインメントチーム」を解散

OpenAIは、安全で信頼性の高いAI開発を専門としていた「ミッションアラインメントチーム」を解散したことを発表しました。チームリーダーはチーフ・フューチャリストに異動し、他のメンバーは社内の各部署に再配置されるとのことです。この決定は、AIの倫理的・安全な開発における同社の戦略変更を示唆するものであり、AIの長期的な影響に関する議論に新たな局面をもたらす可能性があります。

OpenAIがAIの安全・倫理的開発を担った「ミッションアラインメントチーム」を解散し、組織再編に着手。

2026-02-12

Anthropic「Claude」無料版、スキル等4機能追加で利便性向上

Anthropicは、AIチャットボット「Claude」の無料版に、新たに4つの機能を追加したことを発表しました。これらの機能拡張には、外部サービス連携を可能にする「スキル」機能などが含まれています。これにより、ユーザーはClaudeを使ってより多様なタスクを実行できるようになり、AIアシスタントとしての利便性が大幅に向上します。無料版の機能強化は、より多くのユーザーにClaudeの高度な能力を体験してもらう機会を提供します。

AnthropicがClaude無料版に「スキル」を含む4つの新機能を追加し、AIアシスタントとしての汎用性と利便性を大幅に向上。

2026-02-12

AI推論スタートアップModal Labs、25億ドルの評価額で資金調達交渉中

AI推論(inference)に特化したスタートアップModal Labsが、25億ドル(約3,700億円)の企業評価額での資金調達交渉を進めていることが、複数の関係者からの情報として明らかになりました。General Catalystがラウンドを主導する可能性があり、AIインフラ分野における同社の成長性と将来性が高く評価されていることを示唆しています。Modal Labsは、AIモデルの効率的な実行を可能にする技術で注目を集めています。

AI推論スタートアップModal Labsが、25億ドルの高評価額で大型資金調達の交渉を進め、AIインフラ分野での存在感を拡大。

2026-02-12

Anthropicの「Claude」、Windows版「Claude Cowork」でAI作業丸投げが可能に

AIアシスタント「Claude」を提供するAnthropicは、Windows向けの新機能「Claude Cowork」を発表しました。これにより、ユーザーは日常的な作業やタスクをAIに指示し、その実行を「丸投げ」することが可能になります。この機能は、AIとの協働をよりシームレスにし、生産性向上を支援することを目的としています。Claudeの無料版で利用できるこの新機能は、AIの活用範囲をさらに広げるものです。

AnthropicのClaudeがWindows版「Claude Cowork」でAIへの作業「丸投げ」を可能にし、ユーザーの生産性を向上。

2026-02-12

Amazon Cognito:無効化されたユーザーへのアクセストークン発行有無に関する検証

本記事は、Amazon Cognitoユーザープールにおいて、アカウントが無効化されたユーザーに対してアクセストークンが発行されるか否かという疑問に焦点を当て、その挙動を検証・解説しています。ユーザー管理におけるセキュリティや認証フローの理解を深める上で重要なテーマです。記事では、具体的なシナリオにおけるテスト結果を示し、無効化されたユーザーへのトークン発行の有無とその影響について明確な回答を提供しています。

Amazon Cognitoで無効化されたユーザーアカウントへのアクセストークン発行有無を明確に解説し、セキュリティ管理の理解を深める。

2026-02-12

xAI、全社集会で「惑星間」の野望を初公開

Elon Musk氏率いるxAIは、初めて一般公開された全社集会(All-Hands)で、その野心的な将来計画を明らかにしました。45分間のプレゼンテーションでは、AI技術の最先端を追求し、地球を超えた「惑星間」レベルでのAI活用を目指すビジョンが示されました。この公開は、同社の透明性と、AIの未来に対する大胆なアプローチを示すものとして注目されています。具体的な技術ロードマップや目標についても触れられており、今後の展開が期待されます。

xAIが初の全社集会で、地球規模を超えた「惑星間」AIの壮大なビジョンと野望を初公表。

2026-02-12

Amazon Connect AIエージェントでOpenAIの gpt-oss-120b と gpt-oss-20bが利用できるようになりました

2026-02-12

Anthropic、データセンターの電力料金上昇分を全額負担する方針を発表

AI開発企業Anthropicは、データセンターの電力料金の上昇分を全額負担する方針であることを公表しました。この決定は、AIインフラの拡大に伴うエネルギー消費とコスト増加に対する同社の責任ある姿勢を示しています。持続可能なAI開発を推進するため、環境への配慮と経済的負担のバランスを取る戦略の一環と考えられます。この動きは、AI業界における環境負荷低減の議論をさらに深める可能性があります。

AnthropicがAIデータセンターの電力コスト増を全額負担することで、環境負荷と持続可能性への責任を強調。

2026-02-12

Anthropic、AIデータセンターの電力コスト増を全額負担へ:持続可能性へのコミットメント

AI企業Anthropicは、自社のデータセンター運用に伴う電力料金の上昇分を全額負担することを表明しました。これは、AI技術の急速な発展とそれに伴うエネルギー消費の増加に対する業界の責任を示すものです。同社は、環境負荷の低減と持続可能なAI開発への貢献を目指しています。この取り組みは、AI業界全体のサステナビリティに対する意識を高める上で重要な一歩となるでしょう。

AnthropicがAIデータセンターの電力コスト上昇分を全額負担し、持続可能性への強いコミットメントを示す。

2026-02-12

Amazon Bedrock AgentCoreを迅速に構築:FASTフルスタックテンプレートの実践レビュー

本記事では、Amazon Bedrock AgentCoreを用いたフルスタックアプリケーション開発を加速する「FAST」テンプレートを実際に試したレビューを掲載しています。FASTテンプレートは、迅速なプロトタイピングと開発効率の向上を目的としており、Bedrock AgentCoreの主要機能を容易に統合できるように設計されています。記事では、テンプレートのセットアップ方法、主要な機能、および開発者にとってのメリットについて具体的に解説しています。

Amazon Bedrock AgentCoreを迅速にフルスタックアプリケーションに組み込めるFASTテンプレートの有効性を実証。

2026-02-12